如果你也在 怎样代写优化方法optimization MATH857这个学科遇到相关的难题,请随时右上角联系我们的24/7代写客服。优化方法optimization尽管 “优化 “一词与 “最优 “同根同源,但在优化过程中产生真正的最优系统的情况却很少。一般来说,一个系统不是在绝对条件下被优化,而只是在给定的质量指标方面被优化,这可能与其他可能的指标形成对比。因此,优化后的系统通常只在一个应用中或对一个受众来说是最优的。人们可能会减少一个程序执行某些任务所需的时间,但代价是使其消耗更多的内存。在一个内存空间非常宝贵的应用中,人们可能会故意选择一个较慢的算法,以减少内存的使用。

优化方法optimization通常情况下,没有一种 “放之四海而皆准 “的设计能在所有情况下都能很好地工作,因此工程师们会进行权衡,以优化最感兴趣的属性。此外,要使一个软件完全达到最佳状态–不能有任何进一步的改进–所需的努力几乎总是超过了所产生的利益的合理性;所以优化的过程可能在达到完全最佳的解决方案之前就已经停止了。幸运的是,通常情况下,最大的改进是在这个过程的早期。

my-assignmentexpert™优化方法optimization代写,免费提交作业要求, 满意后付款,成绩80\%以下全额退款,安全省心无顾虑。专业硕 博写手团队,所有订单可靠准时,保证 100% 原创。my-assignmentexpert™, 最高质量的优化方法optimization作业代写,服务覆盖北美、欧洲、澳洲等 国家。 在代写价格方面,考虑到同学们的经济条件,在保障代写质量的前提下,我们为客户提供最合理的价格。 由于统计Statistics作业种类很多,同时其中的大部分作业在字数上都没有具体要求,因此优化方法optimization作业代写的价格不固定。通常在经济学专家查看完作业要求之后会给出报价。作业难度和截止日期对价格也有很大的影响。

想知道您作业确定的价格吗? 免费下单以相关学科的专家能了解具体的要求之后在1-3个小时就提出价格。专家的 报价比上列的价格能便宜好几倍。

my-assignmentexpert™ 为您的留学生涯保驾护航 在网课代修方面已经树立了自己的口碑, 保证靠谱, 高质且原创的网课代写服务。我们的专家在优化方法optimization代写方面经验极为丰富,各种优化方法optimization相关的作业也就用不着 说。

我们提供的优化方法optimization MATH857及其相关学科的代写,服务范围广, 其中包括但不限于:

网课代修|优化方法代写optimization代写|Randomized Methods

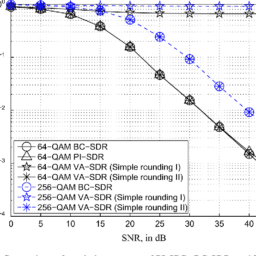

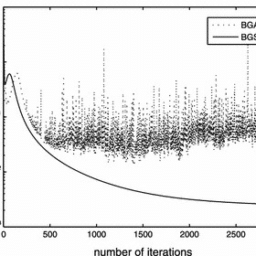

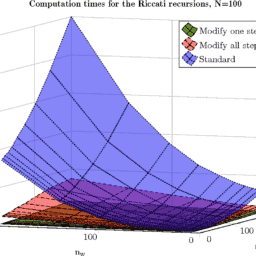

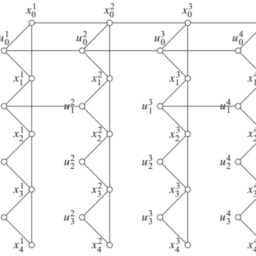

A fixed-point to the previously described operator splitting operators can be found by iterating the operator itself. For very large-scale problems, evaluating the operator might be computationally too expensive. One approach that has become increasingly popular for solving larger problems is to instead iterate a computationally less expensive stochastic approximation of the operator. These algorithms obey different dynamics than the nominal, but almost sure convergence towards a fixed-point of the underlying operator is typically guaranteed. The stochastic approximation may be to randomly select blocks of coordinates that are updated in every iteration, an approach that was popularized by Nesterov . For separable problem structures, such updates are often computationally much less demanding than full operator updates and therefore applicable to larger problems. In Block-Coordinate Primal-Dual Method for Nonsmooth Minimization Over Linear Constraints, Luke and Malitsky propose and analyze a stochastic block-coordinate version of the primal-dual method. They analyze problems with separable cost subject to the decision variable solving a least squares problem. This is a generalization of a linearly constrained separable problem to handle inconsistent linear constraints. They show that the problem template covers linear programming, composite minimization, distributed optimization using the product space formulation, and inverse problems and provide almost sure convergence of the method. In Stochastic Forward Douglas-Rachford Splitting Method for Monotone Inclusions, Cevher, Vũ, and Yurtsever propose and analyze a stochastic version of the forward Douglas-Rachford algorithm . The stochasticity lies in the evaluation of the cocoercive term. Almost sure convergence is shown based on the assumptions that the stochastic approximation is unbiased and its variance sequence is summable. They also propose a novel stochastic primal-dual method using the same problem template as Latafat and Patrinos, but where neither formulation is a special case of the other.

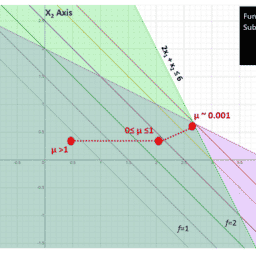

In Mirror Descent and Convex Optimization Problems With Non-Smooth Inequality Constraints, Bayandina, Dvurechensky, Gasnikov, Stonyakin, and Titov analyze deterministic and stochastic variants of the mirror descent method. The mirror descent method is a nonlinear projected subgradient method [2]. It is not a special case of the before mentioned operator splitting methods and therefore cannot rely on their convergence analyses. In the stochastic setting, the authors of this contribution provide results on the number of iterations needed to, with a prespecified probability, reach a certain accuracy of the objective value and constraint violation. The assumption on the stochasticity is that the stochastic gradients are unbiased and bounded almost surely.

网课代修|优化方法代写optimization代写|Consensus Optimization

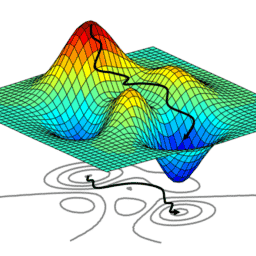

Stochastic approximations can naturally be computed in optimization problems of the form (1.1) if $f(x)=\frac{1}{n} \sum_{i=1}^{n} f_{i}(x)$ and $n$ is large. Such problems are refereed to as empirical risk minimization problems or consensus problems and are very common, e.g., in machine learning. A stochastic approximation of the gradient of $f$ can be obtained by randomly selecting a set of indices and compute the sum of gradients of the corresponding functions. This results in an unbiased gradient approximation that is computationally much less expensive than a full gradient evaluation and serves as the basis in incremental aggregated gradient methods, see, e.g., for a survey. In Frank-Wolfe Style Algorithms for Large Scale Optimization, Ding and Udell show that the Frank-Wolfe method, which minimizes convex differentiable functions over compact sets, converges also when the true gradient is replaced by a stochastic approximation of this form. They also present, and show convergence for, a Frank-Wolfe variation for problems where it is too costly to store the full decision variable. This may happen for large-scale optimization problems with matrix variables. They use a storage saving matrix sketching procedure to approximate the true decision variable. The underlying assumption for the sketching procedure to be beneficial is the existence of some structure of the matrix at the solution, in this case low rank.

优化方法代写

网课代修|优化方法代写OPTIMIZATION代写|RANDOMIZED METHODS

可以通过迭代算子本身来找到前面描述的算子拆分算子的不动点。对于非常大规模的问题,评估算子可能在计算上过于昂贵。对于解决更大的问题,一种越来越流行的方法是迭代算子的计算成本较低的随机逼近。这些算法遵循与标称不同的动态,但通常可以保证几乎可以肯定地收敛到底层算子的固定点。随机近似可能是随机选择在每次迭代中更新的坐标块,这是 Nesterov 推广的一种方法。对于可分离的问题结构,这种更新在计算上的要求通常比完整的算子更新要低得多,因此适用于更大的问题。在 Block-Coordinate Primal-Dual Method for Nonsmooth Minimization Over Linear Constraints 中,Luke 和 Malitsky 提出并分析了 primal-dual 方法的随机块坐标版本7. 他们根据解决最小二乘问题的决策变量分析具有可分离成本的问题。这是处理不一致线性约束的线性约束可分问题的推广。他们表明问题模板涵盖了线性规划、复合最小化、使用乘积空间公式的分布式优化和逆问题,并提供了该方法几乎肯定的收敛性。在 Stochastic Forward Douglas-Rachford Splitting Method for Monotone Inclusions 中,Cevher、Vũ 和 Yurtsever 提出并分析了前向 Douglas-Rachford 算法的随机版本9. 随机性在于对强制项的评估。基于随机近似是无偏的并且其方差序列是可求和的假设,几乎可以肯定收敛。他们还提出了一种新颖的随机原始对偶方法,使用与 Latafat 和 Patrinos 相同的问题模板,但两者都不是另一个公式的特例。

在 Mirror Descent and Convex Optimization Problems With Non-Smooth Inequality Constraints 中,Bayandin、Dvurechensky、Gasnikov、Stonyakin 和 Titov 分析了镜像下降法的确定性和随机变体。镜像下降法是一种非线性投影次梯度法2. 它不是前面提到的算子分裂方法的特例,因此不能依赖于它们的收敛性分析。在随机设置中,该贡献的作者提供了以预先指定的概率达到目标值和约束违反的一定精度所需的迭代次数的结果。对随机性的假设是随机梯度几乎肯定是无偏且有界的。

网课代修|优化方法代写OPTIMIZATION代写|CONSENSUS OPTIMIZATION

随机近似可以自然地在形式的优化问题中计算1.1如果F(X)=1n∑一世=1nF一世(X)和n很大。此类问题被称为经验风险最小化问题或共识问题,并且在例如机器学习中非常常见。梯度的随机近似F可以通过随机选择一组索引并计算相应函数的梯度总和来获得。这导致了无偏梯度近似,其在计算上比完全梯度评估便宜得多,并且用作增量聚合梯度方法的基础,例如,用于调查。在 Frank-Wolfe Style Algorithms for Large Scale Optimization 中,Ding 和 Udell 表明,当真实梯度被这种形式的随机逼近代替时,Frank-Wolfe 方法可以在紧凑集上最小化凸可微函数,也可以收敛。他们还针对存储完整决策变量的成本太高的问题提出并展示了 Frank-Wolfe 变体的收敛性。这可能发生在矩阵变量的大规模优化问题上。他们使用存储节省矩阵绘制程序来近似真实的决策变量。草图过程有益的基本假设是在解决方案中存在矩阵的某些结构,在这种情况下是低秩的。

网课代修|优化方法代写optimization代写 请认准UprivateTA™. UprivateTA™为您的留学生涯保驾护航。

微观经济学代写

微观经济学是主流经济学的一个分支,研究个人和企业在做出有关稀缺资源分配的决策时的行为以及这些个人和企业之间的相互作用。my-assignmentexpert™ 为您的留学生涯保驾护航 在数学Mathematics作业代写方面已经树立了自己的口碑, 保证靠谱, 高质且原创的数学Mathematics代写服务。我们的专家在图论代写Graph Theory代写方面经验极为丰富,各种图论代写Graph Theory相关的作业也就用不着 说。

线性代数代写

线性代数是数学的一个分支,涉及线性方程,如:线性图,如:以及它们在向量空间和通过矩阵的表示。线性代数是几乎所有数学领域的核心。

博弈论代写

现代博弈论始于约翰-冯-诺伊曼(John von Neumann)提出的两人零和博弈中的混合策略均衡的观点及其证明。冯-诺依曼的原始证明使用了关于连续映射到紧凑凸集的布劳威尔定点定理,这成为博弈论和数学经济学的标准方法。在他的论文之后,1944年,他与奥斯卡-莫根斯特恩(Oskar Morgenstern)共同撰写了《游戏和经济行为理论》一书,该书考虑了几个参与者的合作游戏。这本书的第二版提供了预期效用的公理理论,使数理统计学家和经济学家能够处理不确定性下的决策。

微积分代写

微积分,最初被称为无穷小微积分或 “无穷小的微积分”,是对连续变化的数学研究,就像几何学是对形状的研究,而代数是对算术运算的概括研究一样。

它有两个主要分支,微分和积分;微分涉及瞬时变化率和曲线的斜率,而积分涉及数量的累积,以及曲线下或曲线之间的面积。这两个分支通过微积分的基本定理相互联系,它们利用了无限序列和无限级数收敛到一个明确定义的极限的基本概念 。

计量经济学代写

什么是计量经济学?

计量经济学是统计学和数学模型的定量应用,使用数据来发展理论或测试经济学中的现有假设,并根据历史数据预测未来趋势。它对现实世界的数据进行统计试验,然后将结果与被测试的理论进行比较和对比。

根据你是对测试现有理论感兴趣,还是对利用现有数据在这些观察的基础上提出新的假设感兴趣,计量经济学可以细分为两大类:理论和应用。那些经常从事这种实践的人通常被称为计量经济学家。

Matlab代写

MATLAB 是一种用于技术计算的高性能语言。它将计算、可视化和编程集成在一个易于使用的环境中,其中问题和解决方案以熟悉的数学符号表示。典型用途包括:数学和计算算法开发建模、仿真和原型制作数据分析、探索和可视化科学和工程图形应用程序开发,包括图形用户界面构建MATLAB 是一个交互式系统,其基本数据元素是一个不需要维度的数组。这使您可以解决许多技术计算问题,尤其是那些具有矩阵和向量公式的问题,而只需用 C 或 Fortran 等标量非交互式语言编写程序所需的时间的一小部分。MATLAB 名称代表矩阵实验室。MATLAB 最初的编写目的是提供对由 LINPACK 和 EISPACK 项目开发的矩阵软件的轻松访问,这两个项目共同代表了矩阵计算软件的最新技术。MATLAB 经过多年的发展,得到了许多用户的投入。在大学环境中,它是数学、工程和科学入门和高级课程的标准教学工具。在工业领域,MATLAB 是高效研究、开发和分析的首选工具。MATLAB 具有一系列称为工具箱的特定于应用程序的解决方案。对于大多数 MATLAB 用户来说非常重要,工具箱允许您学习和应用专业技术。工具箱是 MATLAB 函数(M 文件)的综合集合,可扩展 MATLAB 环境以解决特定类别的问题。可用工具箱的领域包括信号处理、控制系统、神经网络、模糊逻辑、小波、仿真等。