如果你也在 怎样代写神经网络Neural Networks CSC413/2516这个学科遇到相关的难题,请随时右上角联系我们的24/7代写客服。神经网络Neural Networks理论既有助于更好地确定大脑中的神经元如何运作,也为创造人工智能的努力提供了基础。反映了人脑的行为,使计算机程序能够识别模式并解决人工智能、机器学习和深度学习领域的常见问题。

神经网络Neural Networks也被称为人工神经网络(ANN)或模拟神经网络(SNN),是机器学习的一个子集,是深度学习算法的核心。它们的名称和结构受到人脑的启发,模仿了生物神经元相互之间的信号方式。

my-assignmentexpert™ 神经网络Neural Networks作业代写,免费提交作业要求, 满意后付款,成绩80\%以下全额退款,安全省心无顾虑。专业硕 博写手团队,所有订单可靠准时,保证 100% 原创。my-assignmentexpert™, 最高质量的神经网络Neural Networks作业代写,服务覆盖北美、欧洲、澳洲等 国家。 在代写价格方面,考虑到同学们的经济条件,在保障代写质量的前提下,我们为客户提供最合理的价格。 由于统计Statistics作业种类很多,同时其中的大部分作业在字数上都没有具体要求,因此神经网络Neural Networks作业代写的价格不固定。通常在经济学专家查看完作业要求之后会给出报价。作业难度和截止日期对价格也有很大的影响。

想知道您作业确定的价格吗? 免费下单以相关学科的专家能了解具体的要求之后在1-3个小时就提出价格。专家的 报价比上列的价格能便宜好几倍。

my-assignmentexpert™ 为您的留学生涯保驾护航 在机器学习Machine Learning作业代写方面已经树立了自己的口碑, 保证靠谱, 高质且原创的机器学习Machine Learning代写服务。我们的专家在神经网络Neural Networks代写方面经验极为丰富,各种神经网络Neural Networks相关的作业也就用不着 说。

我们提供的神经网络Neural Networks CSC413/2516及其相关学科的代写,服务范围广, 其中包括但不限于:

机器学习代写|神经网络代写Neural Networks代考|Swish

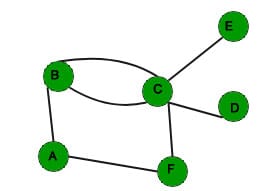

- Graph: A graph is composed of a node set and an edge set, where nodes represent entities and edges represent the relationship between entities. The nodes and edges form the topology structure of the graph. Besides the graph structure, nodes, edges, and/or the whole graph can be associated with rich information represented as node/edge/graph features (also known as attributes or contents).

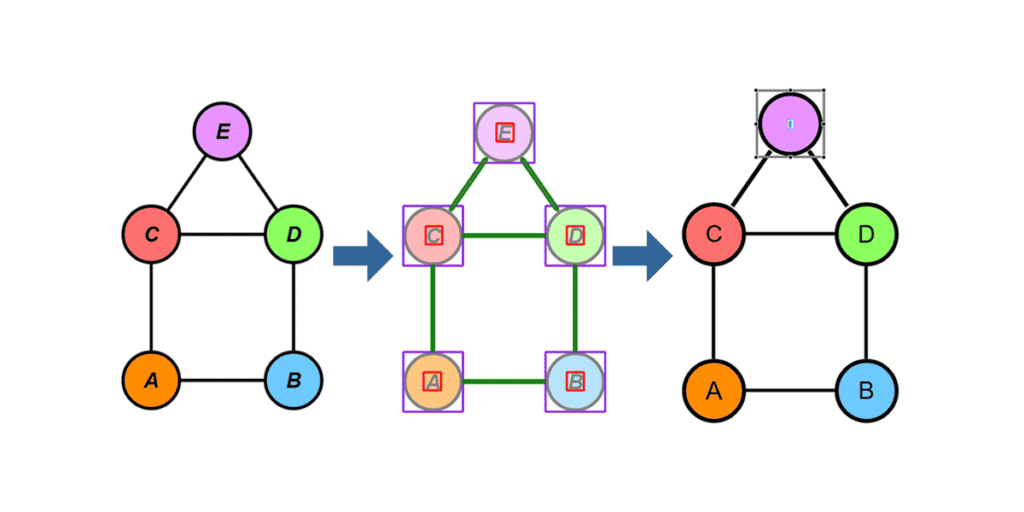

- Subgraph: A subgraph is a graph whose set of nodes and set of edges are all subsets of the original graph.

- Centrality: A centrality is a measurement of the importance of nodes in the graph. The basic assumption of centrality is that a node is thought to be important if many other important nodes also connect to it. Common centrality measurements include the degree centrality, the eigenvector centrality, the betweenness centrality, and the closeness centrality.

- Neighborhood: The neighborhood of a node generally refers to other nodes that are close to it. For example, the k-order neighborhood of a node, also called the k-step neighborhood, denotes a set of other nodes in which the shortest path distance between these nodes and the central node is no larger than $\mathrm{k}$.

- Community Structure: A community refers to a group of nodes that are densely connected internally and less densely connected externally.

- Graph Sampling: Graph sampling is a technique to pick a subset of nodes and/ or edges from the original graph. Graph sampling can be applied to train machine learning models on large-scale graphs while preventing severe scalability issues.

- Heterogeneous Graphs: Graphs are called heterogeneous if the nodes and/or edges of the graph are from different types. A typical example of heteronomous graphs is knowledge graphs where the edges are composed of different types.

- Hypergraphs: Hypergraphs are generalizations of graphs in which an edge can join any number of nodes.

- Random Graph: Random graph generally aims to model the probability distributions over graphs that the observed graphs are generated from. The most basic and well-studied random graph model, known as the Erdos-Renyi model, assumes that the node set is fixed and each edge is identically and independently generated.

- Dynamic Graph: Dynamic graph refers to when at least one component of the graph data changes over time, e.g., adding or deleting nodes, adding or deleting edges, changing edges weights or changing node attributes, etc. If graphs are not dynamic, we refer to them as static graphs.

机器学习代写|神经网络代写Neural Networks代考|Inverted skip connections

- Spectral Graph Theory: Spectral graph theory analyzes matrices associated with the graph such as its adjacency matrix or Laplacian matrix using tools of linear algebra such as studying the eigenvalues and eigenvectors of the matrix.

- Graph Signal Processing: Graph Signal Processing (GSP) aims to develop tools for processing signals defined on graphs. A graph signal refers to a finite collection of data samples with one sample at each node in the graph.

- Node-level Tasks: Node-level tasks refer to machine learning tasks associated with individual nodes in the graph. Typical examples of node-level tasks include node classification and node regression.

- Edge-level Tasks: Edge-level tasks refer to machine learning tasks associated with a pair of nodes in the graph. A typical example of an edge-level task in link prediction.

- Graph-level Tasks: Graph-level tasks refer to machine learning tasks associated with the whole graph. Typical examples of graph-level tasks include graph classification and graph property prediction.

- Transductive and Inductive Learning: Transductive learning refers to that the targeted instances such as nodes or edges are observed at the training time (though the labels of the targeted instances remain unknown) and inductive learning aims to learn the model which is generalizable to unobserved instances.

神经网络代写

机器学习代写|神经网络代写NEURAL NETWORKS代考|SWISH

- 图:图由节点集和边集组成,其中节点代表实体,边代表实体之间的关系。节点和边构成了图的拓扑结构。除了图结构之外,节点、边和/或整个图可以与表示为节点/边/图特征的丰富信息相关联一个ls○ķn○在n一个s一个吨吨r一世b在吨和s○rC○n吨和n吨s.

- 子图:子图是一个图,其节点集和边集都是原始图的子集。

- 中心性:中心性是图中节点重要性的度量。中心性的基本假设是,如果许多其他重要节点也连接到该节点,则该节点被认为是重要的。常见的中心性度量包括度中心性、特征向量中心性、介数中心性和接近中心性。

- 邻域:一个节点的邻域一般是指与其相近的其他节点。例如,节点的 k 阶邻域,也称为 k 步邻域,表示一组其他节点,其中这些节点与中心节点之间的最短路径距离不大于ķ.

- 社区结构:社区是指内部连接密集,外部连接不密集的一组节点。

- 图采样:图采样是一种从原始图中选择节点和/或边子集的技术。图采样可用于在大规模图上训练机器学习模型,同时防止严重的可扩展性问题。

- 异构图:如果图的节点和/或边来自不同类型,则称为异构图。他律图的一个典型例子是知识图,其中边由不同的类型组成。

- 超图:超图是图的概括,其中一条边可以连接任意数量的节点。

- 随机图:随机图通常旨在对生成观察图的图上的概率分布进行建模。最基本且经过充分研究的随机图模型,称为 Erdos-Renyi 模型,假设节点集是固定的,并且每条边都是相同且独立生成的。

- 动态图:动态图是指当图数据的至少一个组成部分随时间发生变化时,例如添加或删除节点、添加或删除边、改变边的权重或改变节点属性等。如果图不是动态的,我们指给他们作为静态图。

机器学习代写|神经网络代写NEURAL NETWORKS代考|INVERTED SKIP CONNECTIONS

- 谱图理论:谱图理论使用线性代数工具分析与图相关的矩阵,例如其邻接矩阵或拉普拉斯矩阵,例如研究矩阵的特征值和特征向量。

- 图形信号处理:图形信号处理G小号磷旨在开发用于处理图上定义的信号的工具。图信号是指数据样本的有限集合,图中每个节点都有一个样本。

- 节点级任务:节点级任务是指与图中各个节点关联的机器学习任务。节点级任务的典型示例包括节点分类和节点回归。

- 边缘级任务:边缘级任务是指与图中的一对节点相关联的机器学习任务。链接预测中边缘级任务的典型示例。

- 图级任务:图级任务是指与整个图关联的机器学习任务。图级任务的典型示例包括图分类和图属性预测。

- 转导和归纳学习:转导学习是指在训练时观察节点或边等目标实例吨H○在GH吨H和l一个b和ls○F吨H和吨一个rG和吨和d一世ns吨一个nC和sr和米一个一世n在nķn○在n归纳学习旨在学习可推广到未观察到的实例的模型。

机器学习代写|神经网络代写Neural Networks代考 请认准UprivateTA™. UprivateTA™为您的留学生涯保驾护航。

微观经济学代写

微观经济学是主流经济学的一个分支,研究个人和企业在做出有关稀缺资源分配的决策时的行为以及这些个人和企业之间的相互作用。my-assignmentexpert™ 为您的留学生涯保驾护航 在数学Mathematics作业代写方面已经树立了自己的口碑, 保证靠谱, 高质且原创的数学Mathematics代写服务。我们的专家在图论代写Graph Theory代写方面经验极为丰富,各种图论代写Graph Theory相关的作业也就用不着 说。

线性代数代写

线性代数是数学的一个分支,涉及线性方程,如:线性图,如:以及它们在向量空间和通过矩阵的表示。线性代数是几乎所有数学领域的核心。

博弈论代写

现代博弈论始于约翰-冯-诺伊曼(John von Neumann)提出的两人零和博弈中的混合策略均衡的观点及其证明。冯-诺依曼的原始证明使用了关于连续映射到紧凑凸集的布劳威尔定点定理,这成为博弈论和数学经济学的标准方法。在他的论文之后,1944年,他与奥斯卡-莫根斯特恩(Oskar Morgenstern)共同撰写了《游戏和经济行为理论》一书,该书考虑了几个参与者的合作游戏。这本书的第二版提供了预期效用的公理理论,使数理统计学家和经济学家能够处理不确定性下的决策。

微积分代写

微积分,最初被称为无穷小微积分或 “无穷小的微积分”,是对连续变化的数学研究,就像几何学是对形状的研究,而代数是对算术运算的概括研究一样。

它有两个主要分支,微分和积分;微分涉及瞬时变化率和曲线的斜率,而积分涉及数量的累积,以及曲线下或曲线之间的面积。这两个分支通过微积分的基本定理相互联系,它们利用了无限序列和无限级数收敛到一个明确定义的极限的基本概念 。

计量经济学代写

什么是计量经济学?

计量经济学是统计学和数学模型的定量应用,使用数据来发展理论或测试经济学中的现有假设,并根据历史数据预测未来趋势。它对现实世界的数据进行统计试验,然后将结果与被测试的理论进行比较和对比。

根据你是对测试现有理论感兴趣,还是对利用现有数据在这些观察的基础上提出新的假设感兴趣,计量经济学可以细分为两大类:理论和应用。那些经常从事这种实践的人通常被称为计量经济学家。

MATLAB代写

MATLAB 是一种用于技术计算的高性能语言。它将计算、可视化和编程集成在一个易于使用的环境中,其中问题和解决方案以熟悉的数学符号表示。典型用途包括:数学和计算算法开发建模、仿真和原型制作数据分析、探索和可视化科学和工程图形应用程序开发,包括图形用户界面构建MATLAB 是一个交互式系统,其基本数据元素是一个不需要维度的数组。这使您可以解决许多技术计算问题,尤其是那些具有矩阵和向量公式的问题,而只需用 C 或 Fortran 等标量非交互式语言编写程序所需的时间的一小部分。MATLAB 名称代表矩阵实验室。MATLAB 最初的编写目的是提供对由 LINPACK 和 EISPACK 项目开发的矩阵软件的轻松访问,这两个项目共同代表了矩阵计算软件的最新技术。MATLAB 经过多年的发展,得到了许多用户的投入。在大学环境中,它是数学、工程和科学入门和高级课程的标准教学工具。在工业领域,MATLAB 是高效研究、开发和分析的首选工具。MATLAB 具有一系列称为工具箱的特定于应用程序的解决方案。对于大多数 MATLAB 用户来说非常重要,工具箱允许您学习和应用专业技术。工具箱是 MATLAB 函数(M 文件)的综合集合,可扩展 MATLAB 环境以解决特定类别的问题。可用工具箱的领域包括信号处理、控制系统、神经网络、模糊逻辑、小波、仿真等。