如果你也在 怎样代写机器学习Machine Learning ECEN689这个学科遇到相关的难题,请随时右上角联系我们的24/7代写客服。机器学习Machine Learning是一个致力于理解和建立 “学习 “方法的研究领域,也就是说,利用数据来提高某些任务的性能的方法。机器学习算法基于样本数据(称为训练数据)建立模型,以便在没有明确编程的情况下做出预测或决定。机器学习算法被广泛用于各种应用,如医学、电子邮件过滤、语音识别和计算机视觉,在这些应用中,开发传统算法来执行所需任务是困难的或不可行的。

机器学习Machine Learning程序可以在没有明确编程的情况下执行任务。它涉及到计算机从提供的数据中学习,从而执行某些任务。对于分配给计算机的简单任务,有可能通过编程算法告诉机器如何执行解决手头问题所需的所有步骤;就计算机而言,不需要学习。对于更高级的任务,由人类手动创建所需的算法可能是一个挑战。在实践中,帮助机器开发自己的算法,而不是让人类程序员指定每一个需要的步骤,可能会变得更加有效 。

机器学习Machine Learning代写,免费提交作业要求, 满意后付款,成绩80\%以下全额退款,安全省心无顾虑。专业硕 博写手团队,所有订单可靠准时,保证 100% 原创。 最高质量的机器学习Machine Learning作业代写,服务覆盖北美、欧洲、澳洲等 国家。 在代写价格方面,考虑到同学们的经济条件,在保障代写质量的前提下,我们为客户提供最合理的价格。 由于作业种类很多,同时其中的大部分作业在字数上都没有具体要求,因此机器学习Machine Learning作业代写的价格不固定。通常在专家查看完作业要求之后会给出报价。作业难度和截止日期对价格也有很大的影响。

同学们在留学期间,都对各式各样的作业考试很是头疼,如果你无从下手,不如考虑my-assignmentexpert™!

my-assignmentexpert™提供最专业的一站式服务:Essay代写,Dissertation代写,Assignment代写,Paper代写,Proposal代写,Proposal代写,Literature Review代写,Online Course,Exam代考等等。my-assignmentexpert™专注为留学生提供Essay代写服务,拥有各个专业的博硕教师团队帮您代写,免费修改及辅导,保证成果完成的效率和质量。同时有多家检测平台帐号,包括Turnitin高级账户,检测论文不会留痕,写好后检测修改,放心可靠,经得起任何考验!

想知道您作业确定的价格吗? 免费下单以相关学科的专家能了解具体的要求之后在1-3个小时就提出价格。专家的 报价比上列的价格能便宜好几倍。

我们在计算机Quantum computer代写方面已经树立了自己的口碑, 保证靠谱, 高质且原创的计算机Quantum computer代写服务。我们的专家在机器学习Machine Learning代写方面经验极为丰富,各种机器学习Machine Learning相关的作业也就用不着 说。

计算机代写|机器学习代写Machine Learning代考|Explainability Facts List Dimensions

The facts list of explainability is supposed to evaluate explainable systems across multiple dimensions.

The functional requirement considers algorithms parameters such as

type of problem the explanations apply to

whether the explanations are designed for data, model, or predictions

which technique uses the explanations (i.e., local vs. global)

the relation to the predictive system (i.e., post hoc or intrinsic).

This was covered in Chapter $3 .$

The operation requirements include interaction with the end user, accuracy vs. interpretability trade-offs, and user background knowledge to fully utilize the explainability power.

The usability requirement includes listing the properties of the explanations, making them more human-friendly and natural so that the output is easily understandable.

Some of these properties are what we talked about in Chapter $4 .$

Robustness and security of an explainable approach are the two safety requirements. Safety requirements include robustness and security of an explainability approach. For example, it includes how much information is leaked to the explainability approach of the underlying model. Also, it checks whether the explanation from a single data point is constant across different models by using the same method.

Let’s now discuss each of these requirements in detail.

计算机代写|机器学习代写Machine Learning代考|Functional Requirements

The functional requirements for designing an explainability method closely relate to the taxonomy of the interpretability methods discussed in Chapter 3 . A data scientist can use the list of functional requirements (F1-F9) to identify and deploy the most suitable algorithm for a particular use case. These are discussed in the following sections.

F1: Problem Supervision Level

Explainability approaches may be relevant to supervised problems and apply to unsupervised learning methods and some semi-supervised learning methods.

F2: Problem Type

There are different types of problems in machine learning for which explanations can be designed. For example, we have a classification (binary, multiclass, multilabel, etc.), regression, clustering, recommendation algorithms such as ranking, and collaborative filtering. Once you define and identify a problem based on the methods mentioned or other methods, you can easily identify explainability methods suitable to the requirements.

F3: Explanation Target

Any machine learning pipeline has three major components: data points, models, and predictions.

Explaining the data points does not come under the umbrella of machine learning explanations or interpretability because there are other methods, such as summary statistics, class ratio, and feature correlations. The target of explainability methods is generally the underlying model and its predictions. By understanding the model’s behavior and the predictions, we can easily decide on which explainability method to choose. The explanation of the model is based on its general functionality and conceptual behavior.

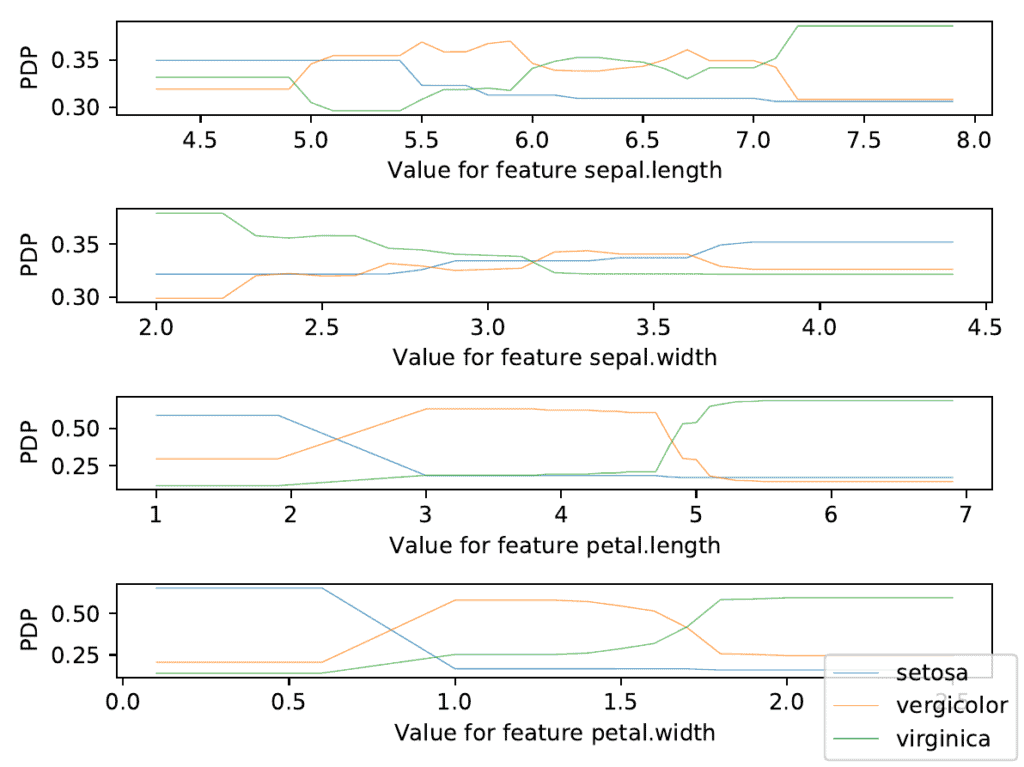

F4: Explanation Breadth/Scope

The scope is one of the major assessment criteria for picking or designing any explainable model. The scope is similar to the taxonomy scope discussed in Chapter 3 . Based on the requirements, you can define the scope as local (any single explanation) or global (the overall data or a group of explanations within the data).

F5: Computational Complexity

Another important assessment criteria are regarding the computational complexity of the modules in the explanation algorithm. The complexity can be measured around metrics such as the time to generate results and the memory required to compute the explanations. This should generally be coupled with the explanation scope mentioned. Designers should consider whether the time and computational resources increase exponentially with an increase in scope from local to global. Various optimization frameworks should be put in place to compute explanations on optimized time and resources.

F6: Applicable Model Class

Model class assessment is very important for designing explainability algorithms. This is also closely related to the scope we discussed in Chapter 3 . Model class means determining whether the methods apply to a specific model or applicable across all models (i.e., model class-specific methods or model-agnostic methods).

F7: Relation to the Predictive System

Two main relations exist between explainable systems and modeling pipelines. The explainable systems can be either post hoc. They are designed to work on top of existing models and utilize the model file or predict the model functions; for example, LIME or SHAP techniques discussed in upcoming chapters. In intrinsic techniques model itself is used for both predicting and explaining (e.g., explaining a linear regression with its feature weights). Examples of post hoc methods are local surrogate explainers.

Another additional relationship can be in the form of a surrogate system that mimics the patterns of a complex model using a simpler model. Surrogates need to be carefully designed to not introduce the same level of complexity as the original model.

机器学习代写

计算机代写|机器学习代写MACHINE LEARNING代 考|EXPLAINABILITY FACTS LIST DIMENSIONS

可解释侏的事实列表应该跨客个维度评估可解释的拲统。

功能要求考虑算法参数,例如

解释适用的问题类型

解释是为数据、模型还是预测设计的

哪种技术使用了解释i.e., localvs. global

与预测系统的关系i. e., posthocorintrinsic.

这在章节中有所介绍 3 .

操作要求包括与最终用户的交互、准确性与可解释性的权衡,以及充分利用可解释性能力的用户背景知识。

可用性要求包括列出解释的属性,使它们更加人性化和自然,以便输出易于理解。

其中一些属性是我们在本章中讨论的 4 .

可解释方法的稳健性和安全性是两个安全要求。安全要求包括可解释性方法的稳健性和安全性。例如,它包括有多少信息被泄露到底层模型的可解释性方法中。此 外,它使用相同的方法检查来自单个数据点的解释是否在不同模型中是恒定的。

现在让我们详细讨论这些要求。

计算机代写|机器学习代写MACHINE LEARNING代 考|FUNCTIONAL REQUIREMENTS

设计可解释性方法的功能要求与第 3 章中讨论的可解释性方法的分类密切相关。数据科学家可以使用功能需求列表 $F 1-F 9$ 为特定用例识别和部罣最合适的算法。

这些将在以下各节中讨论。

F1:问题监䚡级别

可解释性方法可能与监督问题相关,适用于无监督学习方法和一些半监督学习方法。

F2:问题类型

机器学习中有不同类型的问题可以设计解释。例如,我们有一个分类binary, multiclass, multilabel, etc.、回归、聚类、排名等推荐算法,以及协同过滤。一旦 您根据上述方法或其他方法定义和识别问题,您就可以轻松识别适合需求的可解释性方法。

F3:解释目标

任何机器学习管道都具有三个主要组成部分:数据点、模型和预测。

解释数据点不属于机器学习习解释或可解释性的范瞔,因为还有其他方法,例如汇总统计、类比和特征相关性。可解释性方法的目标通常是基础模型及其预测。通过 了解模型的行为和预测,我们可以轻松决定选择哪种可解释性方法。模型的解释基于其一般功能和概念行为。

F4:解释广度/范围

范围是挑选或设计任何可解释模型的主要评估标准之一。该范围类似于第 3 章中讨论的分类范围。根据要求,您可以将范围定义为本地anysingleexplanation或

全球 theoveralldataoragroupofexplanationswithinthedata.

F5:计算复杂度

另一个重要的评估标准是关于解释算法中模块的计算复杂度。可以围绕诸如生成結果的时间和计算解释所需的内存等指标来衡量复杂性。这通常应该与所提到的解 释范围相结合。设计人员应考虑时间和计算资源是否会随着范围从本地到全局的增加而呈指数增长。应该建立各种优化框架来计算对优化时间和资源的解释。

F6:适用模型类

模型类评估对于设计可解释性算法非常重要。这也与我们在第 3 章中讨论的范围密切相关。模型类意味着确定方法是适用于特定模型还是适用于所有模型

i.e., modelclass – specificmethodsormodel-agnosticmethods.

F7: 与预测系统的

关系可解释系统和建模管道之间存在两个主要关系。可解释的系统可以是事后的。它们旨在在现有模型之上工作并利用模型文件或预测模型功能; 例如,即将到

来的章节中讨论的 LIME 或 SHAP 技术。在内在技术中,模型本身用于预测和解释e.g., explainingalinearregressionwithitsfeatureweights. 事后方法的示例

是本地代理解释器。

另一个附加关系可以是代理系统的形式,它使用更简单的模型来模拟复杂模型的模式。代理需要仔细设计,以免引入与原始模型相同的复杂程度。

Sulpedive Dificulty – VB- Repraled Ternis

计算机代写|机器学习代写Machine Learning代考 请认准UprivateTA™. UprivateTA™为您的留学生涯保驾护航。

微观经济学代写

微观经济学是主流经济学的一个分支,研究个人和企业在做出有关稀缺资源分配的决策时的行为以及这些个人和企业之间的相互作用。my-assignmentexpert™ 为您的留学生涯保驾护航 在数学Mathematics作业代写方面已经树立了自己的口碑, 保证靠谱, 高质且原创的数学Mathematics代写服务。我们的专家在图论代写Graph Theory代写方面经验极为丰富,各种图论代写Graph Theory相关的作业也就用不着 说。

线性代数代写

线性代数是数学的一个分支,涉及线性方程,如:线性图,如:以及它们在向量空间和通过矩阵的表示。线性代数是几乎所有数学领域的核心。

博弈论代写

现代博弈论始于约翰-冯-诺伊曼(John von Neumann)提出的两人零和博弈中的混合策略均衡的观点及其证明。冯-诺依曼的原始证明使用了关于连续映射到紧凑凸集的布劳威尔定点定理,这成为博弈论和数学经济学的标准方法。在他的论文之后,1944年,他与奥斯卡-莫根斯特恩(Oskar Morgenstern)共同撰写了《游戏和经济行为理论》一书,该书考虑了几个参与者的合作游戏。这本书的第二版提供了预期效用的公理理论,使数理统计学家和经济学家能够处理不确定性下的决策。

微积分代写

微积分,最初被称为无穷小微积分或 “无穷小的微积分”,是对连续变化的数学研究,就像几何学是对形状的研究,而代数是对算术运算的概括研究一样。

它有两个主要分支,微分和积分;微分涉及瞬时变化率和曲线的斜率,而积分涉及数量的累积,以及曲线下或曲线之间的面积。这两个分支通过微积分的基本定理相互联系,它们利用了无限序列和无限级数收敛到一个明确定义的极限的基本概念 。

计量经济学代写

什么是计量经济学?

计量经济学是统计学和数学模型的定量应用,使用数据来发展理论或测试经济学中的现有假设,并根据历史数据预测未来趋势。它对现实世界的数据进行统计试验,然后将结果与被测试的理论进行比较和对比。

根据你是对测试现有理论感兴趣,还是对利用现有数据在这些观察的基础上提出新的假设感兴趣,计量经济学可以细分为两大类:理论和应用。那些经常从事这种实践的人通常被称为计量经济学家。

Matlab代写

MATLAB 是一种用于技术计算的高性能语言。它将计算、可视化和编程集成在一个易于使用的环境中,其中问题和解决方案以熟悉的数学符号表示。典型用途包括:数学和计算算法开发建模、仿真和原型制作数据分析、探索和可视化科学和工程图形应用程序开发,包括图形用户界面构建MATLAB 是一个交互式系统,其基本数据元素是一个不需要维度的数组。这使您可以解决许多技术计算问题,尤其是那些具有矩阵和向量公式的问题,而只需用 C 或 Fortran 等标量非交互式语言编写程序所需的时间的一小部分。MATLAB 名称代表矩阵实验室。MATLAB 最初的编写目的是提供对由 LINPACK 和 EISPACK 项目开发的矩阵软件的轻松访问,这两个项目共同代表了矩阵计算软件的最新技术。MATLAB 经过多年的发展,得到了许多用户的投入。在大学环境中,它是数学、工程和科学入门和高级课程的标准教学工具。在工业领域,MATLAB 是高效研究、开发和分析的首选工具。MATLAB 具有一系列称为工具箱的特定于应用程序的解决方案。对于大多数 MATLAB 用户来说非常重要,工具箱允许您学习和应用专业技术。工具箱是 MATLAB 函数(M 文件)的综合集合,可扩展 MATLAB 环境以解决特定类别的问题。可用工具箱的领域包括信号处理、控制系统、神经网络、模糊逻辑、小波、仿真等。