如果你也在 怎样代写自然语言处理Natural Language Processing MPCS53113这个学科遇到相关的难题,请随时右上角联系我们的24/7代写客服。自然语言处理Natural Language Processing 起源于20世纪50年代。早在1950年,阿兰-图灵就发表了一篇题为《计算机械与智能》的文章,提出了现在被称为图灵测试的智能标准,尽管在当时这并不是作为一个独立于人工智能的问题来阐述的。拟议的测试包括一项涉及自然语言的自动解释和生成的任务。

自然语言处理Natural Language Processing是语言学、计算机科学和人工智能的一个子领域,涉及计算机和人类语言之间的互动,特别是如何为计算机编程以处理和分析大量的自然语言数据。其目标是使计算机能够 “理解 “文件的内容,包括文件中语言的上下文细微差别。然后,该技术可以准确地提取文件中的信息和见解,并对文件本身进行分类和组织。

自然语言处理Natural Language Processing代写,免费提交作业要求, 满意后付款,成绩80\%以下全额退款,安全省心无顾虑。专业硕 博写手团队,所有订单可靠准时,保证 100% 原创。 最高质量的自然语言处理Natural Language Processing作业代写,服务覆盖北美、欧洲、澳洲等 国家。 在代写价格方面,考虑到同学们的经济条件,在保障代写质量的前提下,我们为客户提供最合理的价格。 由于作业种类很多,同时其中的大部分作业在字数上都没有具体要求,因此自然语言处理Natural Language Processing作业代写的价格不固定。通常在专家查看完作业要求之后会给出报价。作业难度和截止日期对价格也有很大的影响。

同学们在留学期间,都对各式各样的作业考试很是头疼,如果你无从下手,不如考虑my-assignmentexpert™!

my-assignmentexpert™提供最专业的一站式服务:Essay代写,Dissertation代写,Assignment代写,Paper代写,Proposal代写,Proposal代写,Literature Review代写,Online Course,Exam代考等等。my-assignmentexpert™专注为留学生提供Essay代写服务,拥有各个专业的博硕教师团队帮您代写,免费修改及辅导,保证成果完成的效率和质量。同时有多家检测平台帐号,包括Turnitin高级账户,检测论文不会留痕,写好后检测修改,放心可靠,经得起任何考验!

想知道您作业确定的价格吗? 免费下单以相关学科的专家能了解具体的要求之后在1-3个小时就提出价格。专家的 报价比上列的价格能便宜好几倍。

我们在计算机Quantum computer代写方面已经树立了自己的口碑, 保证靠谱, 高质且原创的计算机Quantum computer代写服务。我们的专家在自然语言处理Natural Language Processing代写方面经验极为丰富,各种自然语言处理Natural Language Processing相关的作业也就用不着 说。

CS代写|自然语言处理代写Natural Language Processing代考|Ensuring Validity Using Box Plots

In Section $2.8$ we discussed implicit bias, which occurs when a model picks up on unrelated cues in a data set. This causes the model to make predictions that look accurate but are actually based on incorrect generalizations. This is called over-fitting. The basic idea is that the predictions of the model look accurate on a specific test set; but the model has been selected to fit that test set. In other words, if we had evaluated the model on a different set of examples, the prediction accuracy could be significantly lower.

Over-fitting is especially a problem when we are working with smaller data sets, like those that have been labeled by hand. If we only have a few hundred examples in the test set or if one of the classes is especially rare, then our performance is being evaluated on just a few examples. Let’s say that we hand-label news articles by topic and there is a topic CORRUPTION that has only five examples. We put three examples in the training data and keep two examples in the testing data. This means that our classifier is being evaluated on just two examples of this class.

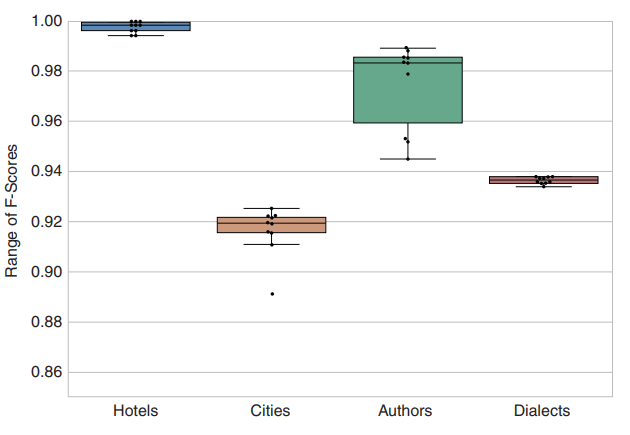

There are two techniques for dealing with this problem: cross-validation and validation sets. For a shallow classifier like logistic regression, which holds all the data in memory at once, we use cross-validation. The basic idea here is that we train and test many times, on different parts of the data. If we repeat our process five times, it is called 5 -fold cross-validation; if we repeat the process ten times, it is called 10-fold cross-validation. In each case, we rotate what data is used for training and what data is used for testing until every sample has been used in the testing set once and only once. Thus, 10 -fold cross-validation uses a $90 / 10$ training/testing split. It is important to realize that cross-validation does not provide a single classifier, because we have actually trained and tested many different classifiers. But it does provide a robust understanding of the classifier’s expected performance.

CS代写|自然语言处理代写Natural Language Processing代考|Unmasking Pseudonymous Authors Using Line Plots

Sometimes we need to visualize more than one model over time. For example, we have seen that we can use a text classifier to identify different authors using function word n-grams. When we work with books written by nineteenthcentury authors, this model performs very well. But how robust is the classifier? How deep are these individual stylistic differences? Let’s say that we have two writers, A and B. Writer A never starts a sentence with And. However, Writer B does so frequently. So, every text by Author A has zero sentences starting with $A$ And but Author $\mathrm{B}$ has hundreds of sentences starting with $A$ and. We might have a classifier with perfect accuracy, but only because this one feature distinguishes between the two writers. We would not consider this model to be very meaningful: There is a lot more to stylistics than just this one feature.

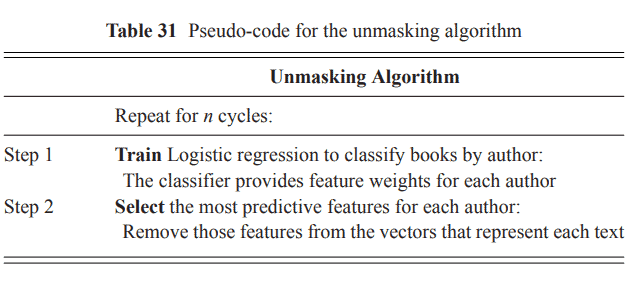

To measure robustness, we use a technique called unmasking (Koppel, Schler, \& Bonchek-Dokow, 2007), shown in Table 31. We train a logistic regression classifier to identify each author in the corpus. That means each feature in our vector, each function word n-gram, is getting a weight between $-1$ and 1 . We can use the feature weights to find out what the most important features are. Unmasking works like this: We train and test the classifier many times. But, each time, we remove the most predictive features, one for each author. By the end of the unmasking process we have many different f-scores, each based on fewer predictive features.

自然语言处理代写

CS代写|自然语言处理代写NATURAL LANGUAGE PROCESSING代考|ENSURING VALIDITY USING BOX PLOTS

在部分2.8我们讨论了隐性偏见,当模型发现数据集中不相关的线索时就会发生这种情况。这会导致模型做出看起来准确但实际上基于错误概括的预测。这称为过拟合。基本思想是模型的预测在特定的测试集上看起来很准确;但是该模型已被选择以适合该测试集。换句话说,如果我们在一组不同的示例上评估模型,预测准确度可能会显着降低。

当我们使用较小的数据集(例如那些手工标记的数据集)时,过度拟合尤其是一个问题。如果我们在测试集中只有几百个示例,或者如果其中一个类特别少,那么我们的性能仅在几个示例上进行评估。假设我们按主题手动标记新闻文章,并且有一个主题 CORRUPTION 只有五个示例。我们在训练数据中放置了三个示例,在测试数据中保留了两个示例。这意味着我们的分类器仅在该类的两个示例上进行评估。

有两种技术可以解决这个问题:交叉验证和验证集。对于像逻辑回归这样的浅层分类器,它一次将所有数据保存在内存中,我们使用交叉验证。这里的基本思想是我们对数据的不同部分进行多次训练和测试。如果我们重复我们的过程五次,则称为 5 折交叉验证;如果我们重复该过程十次,则称为 10 折交叉验证。在每种情况下,我们都会轮换用于训练的数据和用于测试的数据,直到每个样本在测试集中使用一次且仅一次。因此,10 折交叉验证使用90/10训练/测试拆分。重要的是要认识到交叉验证不提供单个分类器,因为我们实际上已经训练和测试了许多不同的分类器。但它确实提供了对分类器预期性能的可靠理解。

CS代写|自然语言处理代写NATURAL LANGUAGE PROCESSING代考|UNMASKING PSEUDONYMOUS AUTHORS USING LINE PLOTS

有时我们需要随着时间的推移可视化多个模型。例如,我们已经看到我们可以使用文本分类器来使用功能词 n-gram 来识别不同的作者。当我们处理 19 世纪作者的著作时,这个模型表现得非常好。但是分类器的鲁棒性如何?这些个人风格差异有多深?假设我们有两个作家,A 和 B。作家 A 从不以 And 开始一个句子。但是,作家 B 经常这样做。因此,作者 A 的每篇文章都以零开头的句子一个但作者乙有数百个以开头的句子一个和。我们可能有一个非常准确的分类器,但这仅仅是因为这一特征可以区分两个作者。我们不会认为这个模型非常有意义:文体学不仅仅是这个功能。

为了测量鲁棒性,我们使用了一种称为 unmasking 的技术ķ○pp和l,小号CHl和r,&乙○nCH和ķ−D○ķ○在,2007,如表 31 所示。我们训练一个逻辑回归分类器来识别语料库中的每个作者。这意味着我们向量中的每个特征,每个功能词 n-gram,都在−1和 1。我们可以使用特征权重来找出最重要的特征是什么。Unmasking 的工作方式如下:我们多次训练和测试分类器。但是,每次,我们都会删除最具预测性的特征,每个作者一个。在揭露过程结束时,我们有许多不同的 f 分数,每个分数都基于较少的预测特征。

CS代写|自然语言处理代写Natural Language Processing代考 请认准UprivateTA™. UprivateTA™为您的留学生涯保驾护航。

微观经济学代写

微观经济学是主流经济学的一个分支,研究个人和企业在做出有关稀缺资源分配的决策时的行为以及这些个人和企业之间的相互作用。my-assignmentexpert™ 为您的留学生涯保驾护航 在数学Mathematics作业代写方面已经树立了自己的口碑, 保证靠谱, 高质且原创的数学Mathematics代写服务。我们的专家在图论代写Graph Theory代写方面经验极为丰富,各种图论代写Graph Theory相关的作业也就用不着 说。

线性代数代写

线性代数是数学的一个分支,涉及线性方程,如:线性图,如:以及它们在向量空间和通过矩阵的表示。线性代数是几乎所有数学领域的核心。

博弈论代写

现代博弈论始于约翰-冯-诺伊曼(John von Neumann)提出的两人零和博弈中的混合策略均衡的观点及其证明。冯-诺依曼的原始证明使用了关于连续映射到紧凑凸集的布劳威尔定点定理,这成为博弈论和数学经济学的标准方法。在他的论文之后,1944年,他与奥斯卡-莫根斯特恩(Oskar Morgenstern)共同撰写了《游戏和经济行为理论》一书,该书考虑了几个参与者的合作游戏。这本书的第二版提供了预期效用的公理理论,使数理统计学家和经济学家能够处理不确定性下的决策。

微积分代写

微积分,最初被称为无穷小微积分或 “无穷小的微积分”,是对连续变化的数学研究,就像几何学是对形状的研究,而代数是对算术运算的概括研究一样。

它有两个主要分支,微分和积分;微分涉及瞬时变化率和曲线的斜率,而积分涉及数量的累积,以及曲线下或曲线之间的面积。这两个分支通过微积分的基本定理相互联系,它们利用了无限序列和无限级数收敛到一个明确定义的极限的基本概念 。

计量经济学代写

什么是计量经济学?

计量经济学是统计学和数学模型的定量应用,使用数据来发展理论或测试经济学中的现有假设,并根据历史数据预测未来趋势。它对现实世界的数据进行统计试验,然后将结果与被测试的理论进行比较和对比。

根据你是对测试现有理论感兴趣,还是对利用现有数据在这些观察的基础上提出新的假设感兴趣,计量经济学可以细分为两大类:理论和应用。那些经常从事这种实践的人通常被称为计量经济学家。

Matlab代写

MATLAB 是一种用于技术计算的高性能语言。它将计算、可视化和编程集成在一个易于使用的环境中,其中问题和解决方案以熟悉的数学符号表示。典型用途包括:数学和计算算法开发建模、仿真和原型制作数据分析、探索和可视化科学和工程图形应用程序开发,包括图形用户界面构建MATLAB 是一个交互式系统,其基本数据元素是一个不需要维度的数组。这使您可以解决许多技术计算问题,尤其是那些具有矩阵和向量公式的问题,而只需用 C 或 Fortran 等标量非交互式语言编写程序所需的时间的一小部分。MATLAB 名称代表矩阵实验室。MATLAB 最初的编写目的是提供对由 LINPACK 和 EISPACK 项目开发的矩阵软件的轻松访问,这两个项目共同代表了矩阵计算软件的最新技术。MATLAB 经过多年的发展,得到了许多用户的投入。在大学环境中,它是数学、工程和科学入门和高级课程的标准教学工具。在工业领域,MATLAB 是高效研究、开发和分析的首选工具。MATLAB 具有一系列称为工具箱的特定于应用程序的解决方案。对于大多数 MATLAB 用户来说非常重要,工具箱允许您学习和应用专业技术。工具箱是 MATLAB 函数(M 文件)的综合集合,可扩展 MATLAB 环境以解决特定类别的问题。可用工具箱的领域包括信号处理、控制系统、神经网络、模糊逻辑、小波、仿真等。