如果你也在 怎样代写深度学习Deep Learning COMP5329这个学科遇到相关的难题,请随时右上角联系我们的24/7代写客服。深度学习Deep Learning(也称为深度结构化学习)是更广泛的机器学习方法系列的一部分,它是基于人工神经网络的表征学习。学习可以是监督的、半监督的或无监督的。人工神经网络(ANNs)的灵感来自于生物系统的信息处理和分布式通信节点。人工神经网络与生物大脑有各种不同之处。具体来说,人工神经网络倾向于静态和符号化,而大多数生物体的生物脑是动态(可塑性)和模拟的。

深度学习Deep Learning架构,如深度神经网络、深度信念网络、深度强化学习、递归神经网络、卷积神经网络和变形金刚,已被应用于包括计算机视觉、语音识别、自然语言处理、机器翻译、生物信息学、药物设计、医学图像分析、气候科学、材料检测和棋盘游戏程序等领域,它们产生的结果与人类专家的表现相当,在某些情况下甚至超过了人类专家。

深度学习Deep Learning代写,免费提交作业要求, 满意后付款,成绩80\%以下全额退款,安全省心无顾虑。专业硕 博写手团队,所有订单可靠准时,保证 100% 原创。 最高质量的机器学习Machine Learning作业代写,服务覆盖北美、欧洲、澳洲等 国家。 在代写价格方面,考虑到同学们的经济条件,在保障代写质量的前提下,我们为客户提供最合理的价格。 由于作业种类很多,同时其中的大部分作业在字数上都没有具体要求,因此机器学习Machine Learning作业代写的价格不固定。通常在专家查看完作业要求之后会给出报价。作业难度和截止日期对价格也有很大的影响。

同学们在留学期间,都对各式各样的作业考试很是头疼,如果你无从下手,不如考虑my-assignmentexpert™!

my-assignmentexpert™提供最专业的一站式服务:Essay代写,Dissertation代写,Assignment代写,Paper代写,Proposal代写,Proposal代写,Literature Review代写,Online Course,Exam代考等等。my-assignmentexpert™专注为留学生提供Essay代写服务,拥有各个专业的博硕教师团队帮您代写,免费修改及辅导,保证成果完成的效率和质量。同时有多家检测平台帐号,包括Turnitin高级账户,检测论文不会留痕,写好后检测修改,放心可靠,经得起任何考验!

想知道您作业确定的价格吗? 免费下单以相关学科的专家能了解具体的要求之后在1-3个小时就提出价格。专家的 报价比上列的价格能便宜好几倍。

我们在计算机Quantum computer代写方面已经树立了自己的口碑, 保证靠谱, 高质且原创的计算机Quantum computer代写服务。我们的专家在深度学习Deep Learning代写方面经验极为丰富,各种深度学习Deep Learning相关的作业也就用不着 说。

计算机代写|深度学习代写Deep Learning代考|Time-Dependency Modelling

In the next stage, the time dependencies between the sequence of framewise features are modelled. So far, the model has only seen a small $150 \mathrm{~ms}$ segment of the speech signal. In this time-dependency stage, the individual feature vectors of the sequence can interact with each other to improve the prediction performance. For example, while an overall quiet or slightly too loud signal may not be perceived as a strong quality degradation, variation of loudness can be perceived as annoying by a speech communication service user. During the time-dependency modelling, the neural network can compare the loudness of the individual segments and update the features accordingly. Consequently, the output of this stage is another sequence of features.

Three different approaches are analysed: LSTM, Transformer, and self-attention neural networks.

Recurrent neural networks are a class of neural networks that allow previous outputs to be used as current inputs. They can use their internal state memory to remember historical sequence information and therefore make decisions considering previous inputs (see Sect. 2.6.2). One advantage of RNNs is that they allow time sequences with different lengths as input. LSTM networks are a type of RNN that are able to remember their inputs over a longer period of time and thus are able to model long-term dependency problems. These kinds of networks are often used to forecast time-series. A more specific variation is the BiLSTM layer that learns bidirectional dependencies between time steps in both directions.

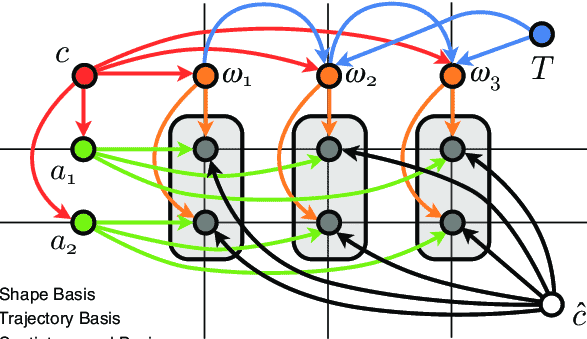

In this work, a single BiLSTM layer with 128 hidden units in each direction is used. As a consequence, for a 10 -second signal $(250 \times 384$ input matrix), the output of the LSTM layer is $250 \times 256$. However, the model in this work can be applied to variable-length signals, and thus, the outputted sequence length depends on the input signal duration. A top-level diagram of the LSTM network for a sequence length of four time steps is presented in Fig. 3.4. It shows the framewise features $x_i$ that are used as input for the $\mathrm{LSTM}^{+}$network in forward direction and the $\mathrm{LSTM}^{-}$network in backward direction. At each time step, the LSTM network receives as input the framewise features of the current time step and the LSTM output of the previous time step. Consequently, at the end of the sequence, the network “saw” all of the individual time steps. The outputs of the forward and backward LSTM networks at each time step are concatenated to yield the updated output feature $\left(y_1, y_2, \ldots\right)$ sequence.

计算机代写|深度学习代写Deep Learning代考|Transformer/Self-Attention

Recently, Transformer networks have shown to outperform LSTM networks in many tasks, especially in Natural Language Processing. The Transformer model consists of an encoder network that processes an input sequence and a decoder network that generates an output sequence. Because the output of a speech quality model is a single value and not a sequence, only the Transformer encoder is applied in this work. The encoder mainly consists of multi-head self-attention layer with a subsequent feedforward layer. This Transformer block is repeated multiple times to create a deep network. The self-attention mechanism allows the input of a time step to attend to other time steps, rendering an interaction between different time steps possible (see also Sect. 2.6.2).

The Transformer block as presented by Vaswani et al. (2017) is shown within the frame on the left-hand side of Fig. 3.5, the multi-head attention mechanism, which is included in the Transformer block, is depicted in the middle, and on the righthand side, the dot-product attention is shown, which in turn is included within the multi-head attention mechanism.

深度学习代写

计算机代写|深度学习代写DEEP LEARNING代考|TIME-DEPENDENCY MODELLING

在下一阶段,对帧特征序列之间的时间依赖性进行建模。到目前为止,该模型只看到了一小部分 $150 \mathrm{~ms}$ 语音信号的片段。在这个时间依赖阶段, 序列的各个特征向量可以相互作用以提高预测性能。例如,虽然整体上安静或稍微太大声的信号可能不会被感知为强烈的质量下降,但语音通信 服务用户可能认为响度的变化是烦人的。在时间依赖性建模期间,神经网络可以比较各个片段的响度并相应地更新特征。因此,这个阶段的输出 是另一个特征序列。

分析了三种不同的方法:LSTM、Transformer 和自注意力神经网络。

递归神经网络是一类允许以前的输出用作当前输入的神经网络。他们可以使用他们的内部状态记忆来记住历史序列信息,因此根据以前的输入做 出决定seeSect. 2.6.2. RNN 的一个优点是它们允许具有不同长度的时间序列作为输入。LSTM 网络是一种 RNN,能够在较长时间内记住其输入,因 此能够对长期依赖问题进行建模。这些类型的网络通常用于预测时间序列。一个更具体的变体是 BiLSTM 层,它学习两个方向上时间步长之间的双 向依赖关系。

在这项工作中,使用了在每个方向上具有 128 个隐藏单元的单个BiLSTM 层。因此,对于 10 秒信号 $(250 \times 384$ 输入矩阵),LSTM层的输出为 $250 \times 256$. 然而,这项工作中的模型可以应用于可变长度信号,因此,输出序列长度取决于输入信号持续时间。图 3.4 给出了序列长度为四个时 间步长的 LSTM 网络的顶层图。它显示了框架特征 $x_i$ 用作输入的LSTM ${ }^{+}$正向网络和LSTM 反 反向网络。在每个时间步,LSTM 网络接收当前时间 步的帧特征和前一个时间步的 LSTM 输出作为输入。因此,在序列结束时,网络“看到”了所有单独的时间步长。前向和后向 LSTM 网络在每个时间 步的输出被连接起来以产生更新的输出特征 $\left(y_1, y_2, \ldots\right)$ 顺序。

计算机代写|深度学习代写DEEP LEARNING代考|TRANSFORMER/SELF-ATTENTION

最近,Transformer 网络在许多任务中表现优于 LSTM 网络,尤其是在自然语言处理方面。Transformer 模型由处理输入序列的编码器网络和生成输 出序列的解码器网络组成。因为语音质量模型的输出是单个值而不是序列,所以在这项工作中只应用了 Transformer 编码器。编码器主要由多头自 注意层和后续的前馈层组成。这个 Transformer 块被重复多次以创建一个深度网络。自注意力机制允许一个时间步的输入关注其他时间步,使得不 同时间步之间的交互成为可能seealsoSect. 2.6.2.

Vaswani 等人提出的 Transformer 块。2017显示在图 3.5 左侧的框架内,中间描述了包含在 Transformer 块中的多头注意机制,右侧显示了点积注 意,这又包含在多头注意机制中。

计算机代写|深度学习代写Deep Learning代考 请认准UprivateTA™. UprivateTA™为您的留学生涯保驾护航。

微观经济学代写

微观经济学是主流经济学的一个分支,研究个人和企业在做出有关稀缺资源分配的决策时的行为以及这些个人和企业之间的相互作用。my-assignmentexpert™ 为您的留学生涯保驾护航 在数学Mathematics作业代写方面已经树立了自己的口碑, 保证靠谱, 高质且原创的数学Mathematics代写服务。我们的专家在图论代写Graph Theory代写方面经验极为丰富,各种图论代写Graph Theory相关的作业也就用不着 说。

线性代数代写

线性代数是数学的一个分支,涉及线性方程,如:线性图,如:以及它们在向量空间和通过矩阵的表示。线性代数是几乎所有数学领域的核心。

博弈论代写

现代博弈论始于约翰-冯-诺伊曼(John von Neumann)提出的两人零和博弈中的混合策略均衡的观点及其证明。冯-诺依曼的原始证明使用了关于连续映射到紧凑凸集的布劳威尔定点定理,这成为博弈论和数学经济学的标准方法。在他的论文之后,1944年,他与奥斯卡-莫根斯特恩(Oskar Morgenstern)共同撰写了《游戏和经济行为理论》一书,该书考虑了几个参与者的合作游戏。这本书的第二版提供了预期效用的公理理论,使数理统计学家和经济学家能够处理不确定性下的决策。

微积分代写

微积分,最初被称为无穷小微积分或 “无穷小的微积分”,是对连续变化的数学研究,就像几何学是对形状的研究,而代数是对算术运算的概括研究一样。

它有两个主要分支,微分和积分;微分涉及瞬时变化率和曲线的斜率,而积分涉及数量的累积,以及曲线下或曲线之间的面积。这两个分支通过微积分的基本定理相互联系,它们利用了无限序列和无限级数收敛到一个明确定义的极限的基本概念 。

计量经济学代写

什么是计量经济学?

计量经济学是统计学和数学模型的定量应用,使用数据来发展理论或测试经济学中的现有假设,并根据历史数据预测未来趋势。它对现实世界的数据进行统计试验,然后将结果与被测试的理论进行比较和对比。

根据你是对测试现有理论感兴趣,还是对利用现有数据在这些观察的基础上提出新的假设感兴趣,计量经济学可以细分为两大类:理论和应用。那些经常从事这种实践的人通常被称为计量经济学家。

Matlab代写

MATLAB 是一种用于技术计算的高性能语言。它将计算、可视化和编程集成在一个易于使用的环境中,其中问题和解决方案以熟悉的数学符号表示。典型用途包括:数学和计算算法开发建模、仿真和原型制作数据分析、探索和可视化科学和工程图形应用程序开发,包括图形用户界面构建MATLAB 是一个交互式系统,其基本数据元素是一个不需要维度的数组。这使您可以解决许多技术计算问题,尤其是那些具有矩阵和向量公式的问题,而只需用 C 或 Fortran 等标量非交互式语言编写程序所需的时间的一小部分。MATLAB 名称代表矩阵实验室。MATLAB 最初的编写目的是提供对由 LINPACK 和 EISPACK 项目开发的矩阵软件的轻松访问,这两个项目共同代表了矩阵计算软件的最新技术。MATLAB 经过多年的发展,得到了许多用户的投入。在大学环境中,它是数学、工程和科学入门和高级课程的标准教学工具。在工业领域,MATLAB 是高效研究、开发和分析的首选工具。MATLAB 具有一系列称为工具箱的特定于应用程序的解决方案。对于大多数 MATLAB 用户来说非常重要,工具箱允许您学习和应用专业技术。工具箱是 MATLAB 函数(M 文件)的综合集合,可扩展 MATLAB 环境以解决特定类别的问题。可用工具箱的领域包括信号处理、控制系统、神经网络、模糊逻辑、小波、仿真等。