如果你也在 怎样代写高级数据分析Advanced Data Analysis 这个学科遇到相关的难题,请随时右上角联系我们的24/7代写客服。高级数据分析Advanced Data Analysis在网络理论的背景下,复杂网络是指具有非微观拓扑特征的图(网络)–这些特征在简单的网络(如格子或随机图)中不会出现,但在代表真实系统的网络中经常出现。复杂网络的研究是一个年轻而活跃的科学研究领域(自2000年以来),主要受到现实世界网络的经验发现的启发,如计算机网络、生物网络、技术网络、大脑网络、气候网络和社会网络。

高级数据分析Advanced Data Analysis大多数社会、生物和技术网络显示出实质性的非微观拓扑特征,其元素之间的连接模式既不是纯粹的规则也不是纯粹的随机。这些特征包括学位分布的重尾、高聚类系数、顶点之间的同态性或异态性、社区结构和层次结构。在有向网络的情况下,这些特征还包括互惠性、三联体重要性概况和其他特征。相比之下,过去研究的许多网络的数学模型,如格子和随机图,并没有显示这些特征。最复杂的结构可以由具有中等数量相互作用的网络实现。这与中等概率获得最大信息含量(熵)的事实相对应。

高级数据分析Advanced Data Analysis代写,免费提交作业要求, 满意后付款,成绩80\%以下全额退款,安全省心无顾虑。专业硕 博写手团队,所有订单可靠准时,保证 100% 原创。最高质量的高级数据分析Advanced Data Analysis作业代写,服务覆盖北美、欧洲、澳洲等 国家。 在代写价格方面,考虑到同学们的经济条件,在保障代写质量的前提下,我们为客户提供最合理的价格。 由于作业种类很多,同时其中的大部分作业在字数上都没有具体要求,因此高级数据分析Advanced Data Analysis作业代写的价格不固定。通常在专家查看完作业要求之后会给出报价。作业难度和截止日期对价格也有很大的影响。

同学们在留学期间,都对各式各样的作业考试很是头疼,如果你无从下手,不如考虑my-assignmentexpert™!

my-assignmentexpert™提供最专业的一站式服务:Essay代写,Dissertation代写,Assignment代写,Paper代写,Proposal代写,Proposal代写,Literature Review代写,Online Course,Exam代考等等。my-assignmentexpert™专注为留学生提供Essay代写服务,拥有各个专业的博硕教师团队帮您代写,免费修改及辅导,保证成果完成的效率和质量。同时有多家检测平台帐号,包括Turnitin高级账户,检测论文不会留痕,写好后检测修改,放心可靠,经得起任何考验!

想知道您作业确定的价格吗? 免费下单以相关学科的专家能了解具体的要求之后在1-3个小时就提出价格。专家的 报价比上列的价格能便宜好几倍。

我们在统计Statistics代写方面已经树立了自己的口碑, 保证靠谱, 高质且原创的统计Statistics代写服务。我们的专家在高级数据分析Advanced Data Analysis代写方面经验极为丰富,各种高级数据分析Advanced Data Analysis相关的作业也就用不着说。

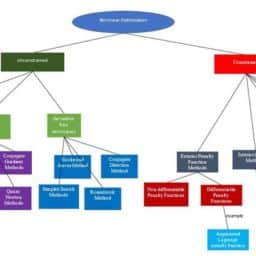

数据科学代写|数据分析代写Data Analysis代考|Data Analysis and Optimization

The typical optimization problem in data analysis is to find a model that agrees with some collected data set but also adheres to some structural constraints that reflect our beliefs about what a good model should be. The data set in a typical analysis problem consists of $m$ objects:

$$

\mathcal{D}:=\left{\left(a_j, y_j\right), j=1,2, \ldots, m\right}

$$

where $a_j$ is a vector (or matrix) of features and $y_j$ is an observation or label. We can assume that the data has been cleaned so that all pairs $\left(a_j, y_j\right), j=$ $1,2, \ldots, m$ have the same size and shape.The data analysis task then consists of discovering a function $\phi$ such that $\phi\left(a_j\right) \approx y_j$ for most $j=1,2, \ldots, m$. The process of discovering the mapping $\phi$ is often called “learning” or “training.”

The function $\phi$ is often defined in terms of a vector or matrix of parameters, which we denote in what follows by $x$ or $X$ and occasionally by other notation. With these parametrizations, the problem of identifying $\phi$ becomes a traditional data-fitting problem: Find the parameters $x$ defining $\phi$ such that $\phi\left(a_j\right \approx y_j, j=1,2, \ldots, m$ in some optimal sense. Once we come up with a definition of the term “optimal” and possibly also with restrictions on the values that we allow to parameters to take, we have an optimization problem. Frequently, these optimization formulations have objective functions of the finite sum type

$$

\mathcal{L}{\mathcal{D}}(x):=\frac{1}{m} \sum{j=1}^m \ell\left(a_j, y_j ; x\right) .

$$

The function $\ell(a, y ; x)$ here represents a “loss” incurred for not properly aligning our prediction $\phi(a)$ with $y$. Thus, the objective $\mathcal{L}_{\mathcal{D}}(x)$ measures the average loss accrued over the entire data set when the parameter vector is equal to $x$.

Once an appropriate value of $x$ (and thus $\phi$ ) has been learned from the data, we can use it to make predictions about other items of data not in the set $\mathcal{D}$ (1.1). Given an unseen item of data $\hat{a}$ of the same type as $a_j, j=1,2, \ldots, m$, we predict the label $\hat{y}$ associated with $\hat{a}$ to be $\phi(\hat{a})$. The mapping $\phi$ may also expose other structures and properties in the data set. For example, it may reveal that only a small fraction of the features in $a_j$ are needed to reliably predict the label $y_j$. (This is known as feature selection.) When the parameter $x$ is a matrix, it could reveal a low-dimensional subspace that contains most of the vectors $a_j$, or it could reveal a matrix with particular structure (low-rank, sparse) such that observations of $X$ prompted by the feature vectors $a_j$ yield results close to $y_j$.

数据科学代写|数据分析代写Data Analysis代考|Least Squares

Probably the oldest and best known data analysis problem is linear least squares. Here, the data points $\left(a_j, y_j\right)$ lie in $\mathbb{R}^n \times \mathbb{R}$, and we solve

$$

\min x \frac{1}{2 m} \sum{j=1}^m\left(a_j^T x \quad y_j\right)^2=\frac{1}{2 m}|A x \quad y|_2^2,

$$

where $A$ the matrix whose rows are $a_j^T, j=1,2, \ldots, m$ and $y=$ $\left(y_1, y_2, \ldots, y_m\right)^T$. In the preceding terminology, the function $\phi$ is defined by $\phi(a):=a^T x$. We can introduce a nonzero intercept by adding an extra parameter $\beta \in \mathbb{R}$ and defining $\phi(a):=a^T x+\beta$. This formulation can be motivated statistically, as a maximum-likelihood estimate of $x$ when the observations $y_j$ are exact but for independent identically distributed (i.i.d.) Gaussian noise. We can add a variety of penalty functions to this basic least squares problem to impose desirable structure on $x$ and, hence, on $\phi$. For example, ridge regression adds a squared $\ell_2$-norm penalty, resulting in

$$

\min _x \frac{1}{2 m}|A x \quad y|_2^2+\lambda|x|_2^2, \quad \text { for some parameter } \lambda>0 .

$$

The solution $x$ of this regularized formulation has less sensitivity to perturbations in the data $\left(a_j, y_j\right)$. The LASSO formulation

$$

\min _x \frac{1}{2 m}|A x \quad y|_2^2+\lambda|x|_1

$$

tends to yield solutions $x$ that are sparse – that is, containing relatively few nonzero components (Tibshirani, 1996). This formulation performs feature selection: The locations of the nonzero components in $x$ reveal those components of $a_j$ that are instrumental in determining the observation $y_j$. Besides its statistical appeal – predictors that depend on few features are potentially simpler and more comprehensible than those depending on many features – feature selection has practical appeal in making predictions about future data. Rather than gathering all components of a new data vector $\hat{a}$, we need to find only the “selected” features because only these are needed to make a prediction.

The LASSO formulation (1.5) is an important prototype for many problems in data analysis in that it involves a regularization term $\lambda|x|_1$ that is nonsmooth and convex but has relatively simple structure that can potentially be exploited by algorithms.

高级数据分析代写

数据科学代写|数据分析代写DATA ANALYSIS代考|DATA ANALYSIS AND OPTIMIZATION

数据分析中的典型优化问题是找到一个模型,该模型与一些收集的数据集一致,但也遵守一些结构约束,这些约束反映了我们对好的模型应该是 什么的信念。典型分析问题中的数据集包括 $m$ 对象:

$\backslash$ mathcal ${D}:=\backslash$ left $\left{\backslash\right.$ left(a_j, $\left.y_{-} j \backslash r i g h t\right), j=1,2, \backslash$ ddots, m $\backslash$ right $}$

在哪里 $a_j$ 是一个向量ormatrix特征和 $y_j$ 是一个观察或标签。我们可以假设数据已被清理,以便所有对 $\left(a_j, y_j\right), j=1,2, \ldots, m$ 具有相同的大小和 形状。数据分析任务包括发现一个函数 $\phi$ 这样 $\phi\left(a_j\right) \approx y_j$ 对于大多数 $j=1,2, \ldots, m$. 映射发现过程 $\phi$ 通常称为“学习”或“训练”。

功能 $\phi$ 通常根据参数的向量或矩阵来定义,我们将其表示为 $x$ 或者 $X$ 偶尔用其他符号。通过这些参数化,识别问题 $\phi$ 成为传统的数据拟合问题:找 到参数 $x$ 定义 $\phi$ 这样 \phi|left(a_j|right \approxy_j, $j=1,2, \backslash$ ldots, $m$ 在某种最佳意义上。一旦我们提出了术语“最优”的定义,并且可能还限制了我们允许参 数采用的值,我们就有了优化问题。通常,这些优化公式具有有限和类型的目标函数

$$

\mathcal{L D}(x):=\frac{1}{m} \sum j=1^m \ell\left(a_j, y_j ; x\right)

$$

功能 $\ell(a, y ; x)$ 这里表示因末正确调整我们的预测而产生的“损失” $\phi(a)$ 和 $y$. 因此,目标 $\mathcal{L}_{\mathcal{D}}(x)$ 当参数向量等于时,测量整个数据集的平均损失 $x$.

一旦适当的价值 $x$ andthus $\phi$ \$已经从数据中学习到,我们可以用它来预测不在集合中的其他数据项 $\mathcal{D} 1.1$. 给定一个看不见的数据项 $\hat{a}$ 与相同类型 $a_j, j=1,2, \ldots, m$ ,我们预测标签 $\hat{y}$ 有关联 $\hat{a}$ 成为 $\phi(\hat{a})$. 映射 $\phi$ 也可能公开数据集中的其他结构和属性。例如,它可能会揭示只有一小部分特征 $a_j$ 需要可靠地预测标签 $y_j$. Thisisknownasfeatureselection. 当参数 $x$ 是一个矩阵,它可以揭示一个包含大部分向量的低维子空间 $a_j$ ,或者它可以 揭示具有特定结构的矩阵low $-r a n k$, sparse 这样的观察 $X$ 由特征向量提示 $a_j$ 产生接近的结果 $y_j$.

数据科学代写|数据分析代写DATA ANALYSIS代考|LEAST SQUARES

可能最古老和最著名的数据分析问题是线性最小二乘法。在这里,数据点 $\left(a_j, y_j\right)$ 位于 $\mathbb{R}^n \times \mathbb{R}$ ,我们解决

$$

\min x \frac{1}{2 m} \sum j=1^m\left(\begin{array}{ll}

a_j^T x & y_j

\end{array}\right)^2=\frac{1}{2 m}|A x \quad y|_2^2

$$

在哪里 $A$ 其行是的矩阵 $a_j^T, j=1,2, \ldots, m$ 和 $y=\left(y_1, y_2, \ldots, y_m\right)^T$. 在前面的术语中,函数 $\phi$ 由定义 $\phi(a):=a^T x$. 我们可以通过添加一个额外的 参数来引入一个非零截距 $\beta \in \mathbb{R}$ 并定义 $\phi(a):=a^T x+\beta$. 这个公式可以在统计上被激发,作为最大似然估计 $x$ 当观䕓 $y_j$ 是精确的,但对于独立同 分布 $i . i . d$. 高斯噪声。我们可以向这个基本的最小二乘问题添加各种惩䍒函数,以将所需的结构强加给 $x$ 因此,在 $\phi$. 例如,岭回归增加了一个平方 $\ell_2$-范数惩罚,导致

$$

\min _x \frac{1}{2 m}|A x \quad y|_2^2+\lambda|x|_2^2, \quad \text { for some parameter } \lambda>0

$$

解决方案 $x$ 这种正则化公式对数据扰动的敏感性较低 $\left(a_j, y_j\right)$. LASSO 公式

$$

\min _x \frac{1}{2 m}|A x \quad y|_2^2+\lambda|x|_1

$$

倾向于产生解决方案 $x$ 是稀疏的—一也就是说,包含相对较少的非零分量Tibshirani, 1996. 该公式执行特征选择: $x$ 揭示那些组成部分 $a_j$ 有助于确 定观察结果 $y_j$. 除了它的统计吸引力一-依赖于少数特征的预测器可能比依赖于许多特征的预测器更简单、更容易理解 – 特征选择在预测末来数据 方面具有实际吸引力。而不是收集新数据向量的所有组件 $\hat{a}$ ,我们只需要找到“选定”的特征,因为只需要这些就可以进行预测。

LASSO 公式 1.5 是数据分析中许多问题的重要原型,因为它涉及正则化项 $\lambda|x|_1$ 它是非光滑和凸的,但具有相对简单的结构,可以被算法利用。

数据科学代写|高级数据分析代写Advanced Data Analysis代考 请认准UprivateTA™. UprivateTA™为您的留学生涯保驾护航。

微观经济学代写

微观经济学是主流经济学的一个分支,研究个人和企业在做出有关稀缺资源分配的决策时的行为以及这些个人和企业之间的相互作用。my-assignmentexpert™ 为您的留学生涯保驾护航 在数学Mathematics作业代写方面已经树立了自己的口碑, 保证靠谱, 高质且原创的数学Mathematics代写服务。我们的专家在图论代写Graph Theory代写方面经验极为丰富,各种图论代写Graph Theory相关的作业也就用不着 说。

线性代数代写

线性代数是数学的一个分支,涉及线性方程,如:线性图,如:以及它们在向量空间和通过矩阵的表示。线性代数是几乎所有数学领域的核心。

博弈论代写

现代博弈论始于约翰-冯-诺伊曼(John von Neumann)提出的两人零和博弈中的混合策略均衡的观点及其证明。冯-诺依曼的原始证明使用了关于连续映射到紧凑凸集的布劳威尔定点定理,这成为博弈论和数学经济学的标准方法。在他的论文之后,1944年,他与奥斯卡-莫根斯特恩(Oskar Morgenstern)共同撰写了《游戏和经济行为理论》一书,该书考虑了几个参与者的合作游戏。这本书的第二版提供了预期效用的公理理论,使数理统计学家和经济学家能够处理不确定性下的决策。

微积分代写

微积分,最初被称为无穷小微积分或 “无穷小的微积分”,是对连续变化的数学研究,就像几何学是对形状的研究,而代数是对算术运算的概括研究一样。

它有两个主要分支,微分和积分;微分涉及瞬时变化率和曲线的斜率,而积分涉及数量的累积,以及曲线下或曲线之间的面积。这两个分支通过微积分的基本定理相互联系,它们利用了无限序列和无限级数收敛到一个明确定义的极限的基本概念 。

计量经济学代写

什么是计量经济学?

计量经济学是统计学和数学模型的定量应用,使用数据来发展理论或测试经济学中的现有假设,并根据历史数据预测未来趋势。它对现实世界的数据进行统计试验,然后将结果与被测试的理论进行比较和对比。

根据你是对测试现有理论感兴趣,还是对利用现有数据在这些观察的基础上提出新的假设感兴趣,计量经济学可以细分为两大类:理论和应用。那些经常从事这种实践的人通常被称为计量经济学家。

Matlab代写

MATLAB 是一种用于技术计算的高性能语言。它将计算、可视化和编程集成在一个易于使用的环境中,其中问题和解决方案以熟悉的数学符号表示。典型用途包括:数学和计算算法开发建模、仿真和原型制作数据分析、探索和可视化科学和工程图形应用程序开发,包括图形用户界面构建MATLAB 是一个交互式系统,其基本数据元素是一个不需要维度的数组。这使您可以解决许多技术计算问题,尤其是那些具有矩阵和向量公式的问题,而只需用 C 或 Fortran 等标量非交互式语言编写程序所需的时间的一小部分。MATLAB 名称代表矩阵实验室。MATLAB 最初的编写目的是提供对由 LINPACK 和 EISPACK 项目开发的矩阵软件的轻松访问,这两个项目共同代表了矩阵计算软件的最新技术。MATLAB 经过多年的发展,得到了许多用户的投入。在大学环境中,它是数学、工程和科学入门和高级课程的标准教学工具。在工业领域,MATLAB 是高效研究、开发和分析的首选工具。MATLAB 具有一系列称为工具箱的特定于应用程序的解决方案。对于大多数 MATLAB 用户来说非常重要,工具箱允许您学习和应用专业技术。工具箱是 MATLAB 函数(M 文件)的综合集合,可扩展 MATLAB 环境以解决特定类别的问题。可用工具箱的领域包括信号处理、控制系统、神经网络、模糊逻辑、小波、仿真等。