如果你也在 怎样代写自然语言处理Natural Language Processing学科遇到相关的难题,请随时右上角联系我们的24/7代写客服。自然语言处理Natural Language Processing是一个用于机器学习和人工智能的免费和开源的软件库。它可以用于一系列的任务,但特别专注于深度神经网络的训练和推理。

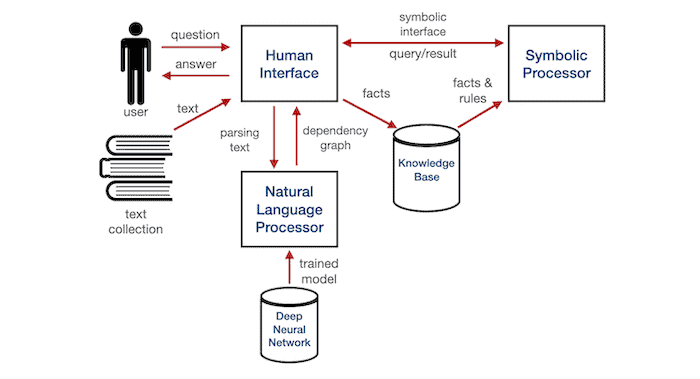

自然语言处理Natural Language Processing是语言学、计算机科学和人工智能的一个子领域,涉及计算机和人类语言之间的互动,特别是如何为计算机编程以处理和分析大量的自然语言数据。其目标是使计算机能够 “理解 “文件的内容,包括文件中语言的上下文细微差别。然后,该技术可以准确地提取文件中的信息和见解,并对文件本身进行分类和组织。

my-assignmentexpert™自然语言处理Natural Language Processing代写,免费提交作业要求, 满意后付款,成绩80\%以下全额退款,安全省心无顾虑。专业硕 博写手团队,所有订单可靠准时,保证 100% 原创。my-assignmentexpert™, 最高质量的自然语言处理Natural Language Processing作业代写,服务覆盖北美、欧洲、澳洲等 国家。 在代写价格方面,考虑到同学们的经济条件,在保障代写质量的前提下,我们为客户提供最合理的价格。 由于统计Statistics作业种类很多,同时其中的大部分作业在字数上都没有具体要求,因此自然语言处理Natural Language Processing作业代写的价格不固定。通常在经济学专家查看完作业要求之后会给出报价。作业难度和截止日期对价格也有很大的影响。

想知道您作业确定的价格吗? 免费下单以相关学科的专家能了解具体的要求之后在1-3个小时就提出价格。专家的 报价比上列的价格能便宜好几倍。

my-assignmentexpert™ 为您的留学生涯保驾护航 在机器学习Machine Learning代写方面已经树立了自己的口碑, 保证靠谱, 高质且原创的机器学习Machine Learning代写服务。我们的专家在自然语言处理NLP代写方面经验极为丰富,各种自然语言处理NLP相关的作业也就用不着 说。

我们提供的自然语言处理NLP及其相关学科的代写,服务范围广, 其中包括但不限于:

机器学习代写|自然语言处理代写NLP代考|LINEAR AND NONLINEAR CLASSIFICATION

A linear model is a parameter vector $w$ that interacts with a data point $\mathbf{x}$ in the following way to produce a class prediction $y$ :

$$

y=b \times 1+w_{0} x_{0}+w_{1} x_{1}+w_{2} x_{2}+\ldots=\mathbf{w x}^{T}

$$

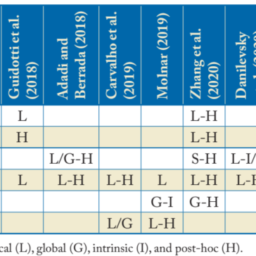

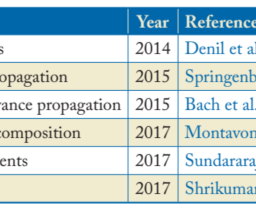

The decision of a linear model is the sign of the inner-product of model parameters and the representation (vectorization) of the data instance. Our learning algorithms will attempt to select w such as to minimize our loss across $D, \ell\left(h\left(\mathbf{x}{i}\right), y{i}\right)$. We will assume a smooth, differentiable loss function, e.g., logistic loss, $-y_{i} \log \left(h\left(\mathbf{x}{i}\right)\right)$. Saliency maps (Fong et al., 2019) are a broad class of explanation methods that analyze how a change in some input $\mathrm{x}$ changes the output $y$. A straightforward way to do this in the case of linear classification models is to take the derivative of the loss function with respect to the input, $d\left(\ell\left(h\left(\mathrm{x}{i}\right), y_{i}\right)\right)$. We discuss saliency maps in more detail in Chapter $3 .$

Nonlinear classification models, like linear ones, come in many different flavors, but the vast majority of recent research in NLP revolves around recurrent models and transformers.

机器学习代写|自然语言处理代写NLP代考|RECURRENT MODELS

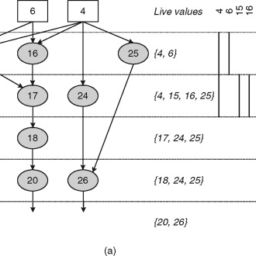

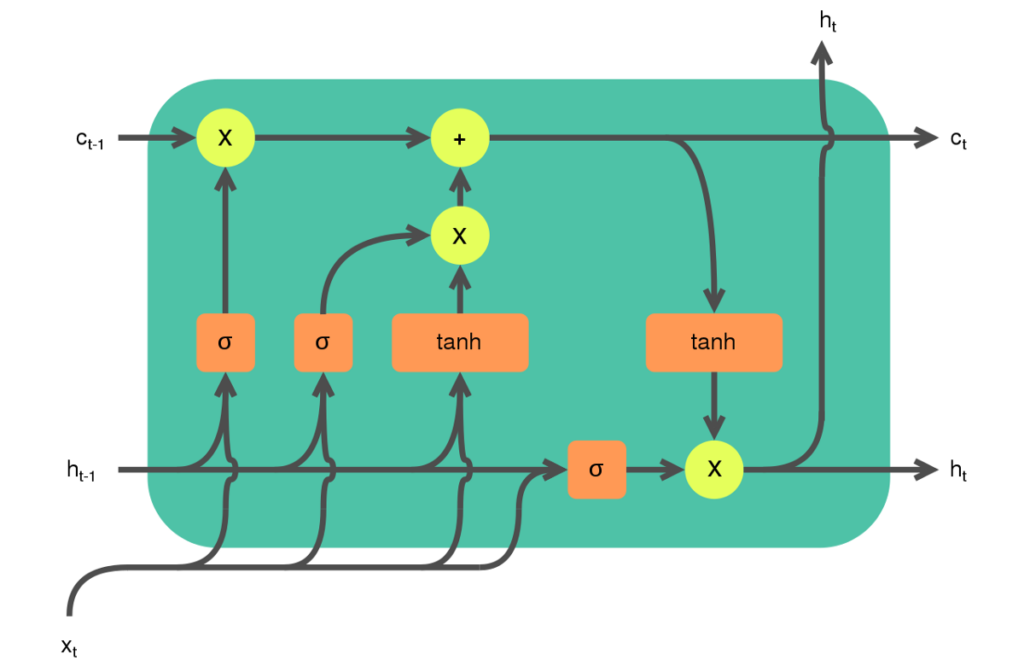

GRUs The key difference between a simple recurrent network and a network with GRUs is that the model parameters (including the embedding layer) are split (or copied) in three independent sets of parameters, $\mathbf{w}, \mathbf{w}^{z}, \mathbf{w}^{r}$. We first compute what is commonly referred to as the update gate vector $z_{t_{i}}$ :

$$

z_{t_{i}}=\sigma_{z}\left(\mathbf{w}{z}^{e} \mathbf{x}{t_{i}}+\mathbf{w}{z} h{t_{i-1}}\right)

$$

Intuitively, the update gate vector controls which weights are updates in the current time step. Next we compute the reset gate vector, which is used to ensure memory flow throughout the sequence:

$$

r_{t_{i}}=\sigma_{r}\left(\mathrm{w}{r}^{e} \mathrm{x}{t_{i}}+\mathrm{w}{r} h{t_{i-1}}\right)

$$

机器学习代写|自然语言处理代写NLP代考|TRANSFORMERS

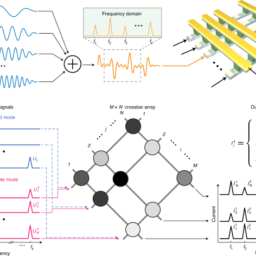

The Transformer architecture Vaswani et al., 2017 constrains a soft alignment self-attention to be learned across discrete states in the input. Just like recurrent networks maintain hidden states to draw on context information, transformers rely on self-attention to capture longdistance dependencies. We obtain self-attention by maintaining several vectors using distinct sets of model parameters, $\mathbf{w}^{q}$ (for query vectors), $\mathbf{w}^{k}$ for key vectors, and $\mathbf{w}^{v}$ (for value vectors). Multiplying the embedding vector ${ }^{1}$ for a particular time step with $\mathrm{w}^{q}$ gives us the query vector for that time step, etc. The self-attention across the input tokens $t_{1} \ldots t_{n}$ associated with a particular time step $t_{i}$ is obtained by computing the dot products of $t_{i}$ ‘s query vector $\mathbf{w}^{q} \mathbf{x}{t{i}}$ with the key vectors of the other words, subsequently passing these values through a softmax operator. We then integrate context information accordingly by multiplying the softmax values into the value vectors of these words. The sum of these weighted value vectors is the self-attention presentation for the time step $t_{i}$. In practice, we typically use multiple sets of query, key, and value vectors, often referred to as attention beads. Attention heads are the object of interpretation in both local and global interpretability methods, e.g., using attention flow Abnar and Zuidema, 2020 or attention head pruning Voita et al., 2019. To produce the final output, the output of the transformer multi-head self-attention architecture is added to its input, normalized and passed through feed-forward layers.

自然语言处理代写

机器学习代写|自然语言处理代写NLP代考|LINEAR AND NONLINEAR CLASSIFICATION

线性模型是参数向量在与数据点交互的X以下列方式产生类别预测是 :

是=b×1+在0X0+在1X1+在2X2+…=在X吨

线性模型的决策是模型参数内积的符号和表示在和C吨○r一世和一个吨一世○n的数据实例。我们的学习算法将尝试选择 w 以最小化我们在 $D 上的损失,$D, \ell\left(h\left(\mathbf{x}{i}\right), y{i}\right)$. We will assume a smooth, differentiable loss function, e.g., logistic loss, $-y_{i} \log \left(h\left(\mathbf{x}{i}\right)\right)$. Saliency maps (Fong et al., 2019) are a broad class of explanation methods that analyze how a change in some input $\mathrm{x}$ changes the output $y$. A straightforward way to do this in the case of linear classification models is to take the derivative of the loss function with respect to the input, $d\left(\ell\left(h\left(\mathrm{x}{i}\right), y_{i}\right)\right)$. We discuss saliency maps in more detail in Chapter $3 .$

非线性分类模型,如线性分类模型,有许多不同的风格,但最近 NLP 的绝大多数研究都围绕循环模型和变换器展开。

机器学习代写|自然语言处理代写NLP代考|RECURRENT MODELS

GRUs 简单循环网络和具有 GRUs 的网络之间的主要区别在于模型参数一世nCl在d一世nG吨H和和米b和dd一世nGl一个是和r被分裂○rC○p一世和d在三组独立的参数中,在,在和,在r. 我们首先计算通常所说的更新门向量和吨一世:

$$

z_{t_{i}}=\sigma_{z}\left(\mathbf{w}{z}^{e} \mathbf{x}{t_{i}}+\mathbf{w}{z} h{t_{i-1}}\right)

$$

Intuitively, the update gate vector controls which weights are updates in the current time step. Next we compute the reset gate vector, which is used to ensure memory flow throughout the sequence:

$$

r_{t_{i}}=\sigma_{r}\left(\mathrm{w}{r}^{e} \mathrm{x}{t_{i}}+\mathrm{w}{r} h{t_{i-1}}\right)

$$

机器学习代写|自然语言处理代写NLP代考|TRANSFORMERS

Transformer 架构 Vaswani 等人,2017 年限制了在输入中的离散状态之间学习的软对齐自注意力。就像循环网络保持隐藏状态以利用上下文信息一样,transformers 依靠自我注意来捕获长距离依赖关系。我们通过使用不同的模型参数集维护几个向量来获得自我关注,在q F○rq在和r是在和C吨○rs, 在ķ对于关键向量,和在在 F○r在一个l在和在和C吨○rs. 乘以嵌入向量1对于特定的时间步长在q为我们提供该时间步长的查询向量等。跨输入标记的自注意力吨1…吨n与特定时间步相关联吨一世通过计算的点积获得吨一世的查询向量$\mathbf{w}^{q}$ (for query vectors), $\mathbf{w}^{k}$ for key vectors, and $\mathbf{w}^{v}$ (for value vectors). Multiplying the embedding vector ${ }^{1}$ for a particular time step with $\mathrm{w}^{q}$ gives us the query vector for that time step, etc. The self-attention across the input tokens $t_{1} \ldots t_{n}$ associated with a particular time step $t_{i}$ is obtained by computing the dot products of $t_{i}$ ‘s query vector $\mathbf{w}^{q} \mathbf{x}{t{i}}$。在实践中,我们通常使用多组查询、键和值向量,通常称为注意力珠。注意力头是局部和全局可解释性方法中解释的对象,例如,使用注意力流 Abnar 和 Zuidema,2020 或注意力头修剪在○一世吨一个和吨一个l.,2019. 为了产生最终输出,Transformer 多头自注意力架构的输出被添加到其输入中,进行归一化并通过前馈层。

机器学习代写|自然语言处理代写NLP代考 请认准UprivateTA™. UprivateTA™为您的留学生涯保驾护航。

微观经济学代写

微观经济学是主流经济学的一个分支,研究个人和企业在做出有关稀缺资源分配的决策时的行为以及这些个人和企业之间的相互作用。my-assignmentexpert™ 为您的留学生涯保驾护航 在数学Mathematics作业代写方面已经树立了自己的口碑, 保证靠谱, 高质且原创的数学Mathematics代写服务。我们的专家在图论代写Graph Theory代写方面经验极为丰富,各种图论代写Graph Theory相关的作业也就用不着 说。

线性代数代写

线性代数是数学的一个分支,涉及线性方程,如:线性图,如:以及它们在向量空间和通过矩阵的表示。线性代数是几乎所有数学领域的核心。

博弈论代写

现代博弈论始于约翰-冯-诺伊曼(John von Neumann)提出的两人零和博弈中的混合策略均衡的观点及其证明。冯-诺依曼的原始证明使用了关于连续映射到紧凑凸集的布劳威尔定点定理,这成为博弈论和数学经济学的标准方法。在他的论文之后,1944年,他与奥斯卡-莫根斯特恩(Oskar Morgenstern)共同撰写了《游戏和经济行为理论》一书,该书考虑了几个参与者的合作游戏。这本书的第二版提供了预期效用的公理理论,使数理统计学家和经济学家能够处理不确定性下的决策。

微积分代写

微积分,最初被称为无穷小微积分或 “无穷小的微积分”,是对连续变化的数学研究,就像几何学是对形状的研究,而代数是对算术运算的概括研究一样。

它有两个主要分支,微分和积分;微分涉及瞬时变化率和曲线的斜率,而积分涉及数量的累积,以及曲线下或曲线之间的面积。这两个分支通过微积分的基本定理相互联系,它们利用了无限序列和无限级数收敛到一个明确定义的极限的基本概念 。

计量经济学代写

什么是计量经济学?

计量经济学是统计学和数学模型的定量应用,使用数据来发展理论或测试经济学中的现有假设,并根据历史数据预测未来趋势。它对现实世界的数据进行统计试验,然后将结果与被测试的理论进行比较和对比。

根据你是对测试现有理论感兴趣,还是对利用现有数据在这些观察的基础上提出新的假设感兴趣,计量经济学可以细分为两大类:理论和应用。那些经常从事这种实践的人通常被称为计量经济学家。

Matlab代写

MATLAB 是一种用于技术计算的高性能语言。它将计算、可视化和编程集成在一个易于使用的环境中,其中问题和解决方案以熟悉的数学符号表示。典型用途包括:数学和计算算法开发建模、仿真和原型制作数据分析、探索和可视化科学和工程图形应用程序开发,包括图形用户界面构建MATLAB 是一个交互式系统,其基本数据元素是一个不需要维度的数组。这使您可以解决许多技术计算问题,尤其是那些具有矩阵和向量公式的问题,而只需用 C 或 Fortran 等标量非交互式语言编写程序所需的时间的一小部分。MATLAB 名称代表矩阵实验室。MATLAB 最初的编写目的是提供对由 LINPACK 和 EISPACK 项目开发的矩阵软件的轻松访问,这两个项目共同代表了矩阵计算软件的最新技术。MATLAB 经过多年的发展,得到了许多用户的投入。在大学环境中,它是数学、工程和科学入门和高级课程的标准教学工具。在工业领域,MATLAB 是高效研究、开发和分析的首选工具。MATLAB 具有一系列称为工具箱的特定于应用程序的解决方案。对于大多数 MATLAB 用户来说非常重要,工具箱允许您学习和应用专业技术。工具箱是 MATLAB 函数(M 文件)的综合集合,可扩展 MATLAB 环境以解决特定类别的问题。可用工具箱的领域包括信号处理、控制系统、神经网络、模糊逻辑、小波、仿真等。