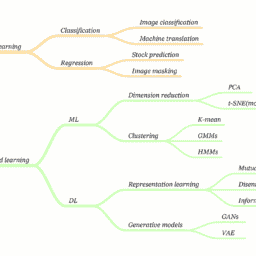

如果你也在 怎样代写机器学习Machine Learning COMP7703这个学科遇到相关的难题,请随时右上角联系我们的24/7代写客服。机器学习Machine Learning是一个致力于理解和建立 “学习 “方法的研究领域,也就是说,利用数据来提高某些任务的性能的方法。机器学习算法基于样本数据(称为训练数据)建立模型,以便在没有明确编程的情况下做出预测或决定。机器学习算法被广泛用于各种应用,如医学、电子邮件过滤、语音识别和计算机视觉,在这些应用中,开发传统算法来执行所需任务是困难的或不可行的。

机器学习Machine Learning程序可以在没有明确编程的情况下执行任务。它涉及到计算机从提供的数据中学习,从而执行某些任务。对于分配给计算机的简单任务,有可能通过编程算法告诉机器如何执行解决手头问题所需的所有步骤;就计算机而言,不需要学习。对于更高级的任务,由人类手动创建所需的算法可能是一个挑战。在实践中,帮助机器开发自己的算法,而不是让人类程序员指定每一个需要的步骤,可能会变得更加有效 。

机器学习Machine Learning代写,免费提交作业要求, 满意后付款,成绩80\%以下全额退款,安全省心无顾虑。专业硕 博写手团队,所有订单可靠准时,保证 100% 原创。 最高质量的机器学习Machine Learning作业代写,服务覆盖北美、欧洲、澳洲等 国家。 在代写价格方面,考虑到同学们的经济条件,在保障代写质量的前提下,我们为客户提供最合理的价格。 由于作业种类很多,同时其中的大部分作业在字数上都没有具体要求,因此机器学习Machine Learning作业代写的价格不固定。通常在专家查看完作业要求之后会给出报价。作业难度和截止日期对价格也有很大的影响。

同学们在留学期间,都对各式各样的作业考试很是头疼,如果你无从下手,不如考虑my-assignmentexpert™!

my-assignmentexpert™提供最专业的一站式服务:Essay代写,Dissertation代写,Assignment代写,Paper代写,Proposal代写,Proposal代写,Literature Review代写,Online Course,Exam代考等等。my-assignmentexpert™专注为留学生提供Essay代写服务,拥有各个专业的博硕教师团队帮您代写,免费修改及辅导,保证成果完成的效率和质量。同时有多家检测平台帐号,包括Turnitin高级账户,检测论文不会留痕,写好后检测修改,放心可靠,经得起任何考验!

想知道您作业确定的价格吗? 免费下单以相关学科的专家能了解具体的要求之后在1-3个小时就提出价格。专家的 报价比上列的价格能便宜好几倍。

我们在计算机Quantum computer代写方面已经树立了自己的口碑, 保证靠谱, 高质且原创的计算机Quantum computer代写服务。我们的专家在机器学习Machine Learning代写方面经验极为丰富,各种机器学习Machine Learning相关的作业也就用不着 说。

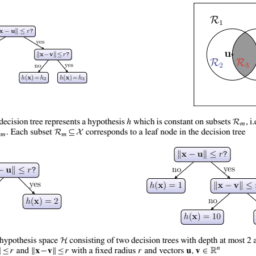

计算机代写|机器学习代写Machine Learning代考|Parametrized Hypothesis spaces

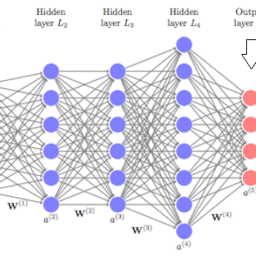

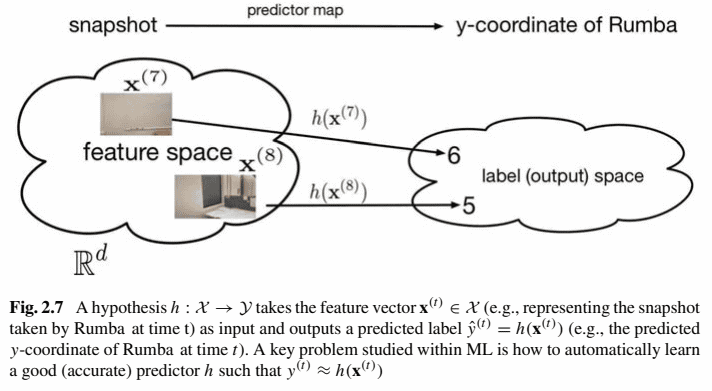

A wide range of current scientific computing environments allow for efficient numerical linear algebra. This hard and software allows to efficiently process data that is provided in the form of numeric arrays such as vectors, matrices or tensors [24]. To take advantage of such computational infrastructure, many ML methods use the hypothesis space

$$

\mathcal{H}^{(n)}:=\left{h^{(\mathbf{w})}: \mathbb{R}^n \rightarrow \mathbb{R}: h^{(\mathbf{w})}(\mathbf{x})=\mathbf{x}^T \mathbf{w} \text { with some weight vector } \mathbf{w} \in \mathbb{R}^n\right} .

$$

The hypothesis space (2.4) is constituted by linear maps (functions)

$$

h^{(\mathbf{w})}(\mathbf{x}): \mathbb{R}^n \rightarrow \mathbb{R}: \mathbf{x} \mapsto \mathbf{w}^T \mathbf{x} .

$$

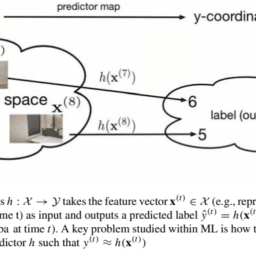

The function $h^{(\mathbf{w})}$ (2.5) maps, in a linear fashion, the feature vector $\mathbf{x} \in \mathbb{R}^n$ to the predicted label (or output) $h^{(\mathbf{w})}(\mathbf{x})=\mathbf{x}^T \mathbf{w} \in \mathbb{R}$. For $n=1$ the feature vector reduces a single feature $x$ and the hypothesis space (2.4) consists of all maps $h^{(w)}(x)=w x$ with some weight $w \in \mathbb{R}$ (see Fig. 2.8).

The elements of the hypothesis space $\mathcal{H}$ in (2.4) are parameterized by the weight vector $\mathbf{w} \in \mathbb{R}^n$. Each map $h^{(\mathbf{w})} \in \mathcal{H}$ is fully specified by the weight vector $\mathbf{w} \in \mathbb{R}^n$. This parametrization of the hypothesis space $\mathcal{H}$ allows to process and manipulate hypothesis maps by vector operations. In particular, instead of searching over the function space $\mathcal{H}$ (its elements are functions!) to find a good hypothesis, we can equivalently search over all possible weight vectors $\mathbf{w} \in \mathbb{R}^n$.

The search space $\mathbb{R}^n$ is still (uncountably) infinite but it has a rich geometric and algebraic structure that allows us to efficiently search over this space. Chapter 5 discusses methods that use the concept of gradients to implement an efficient search for good weights $\mathbf{w} \in \mathbb{R}^n$.

计算机代写|机器学习代写Machine Learning代考|The Size of a Hypothesis Space

The notion of a hypothesis space being too small or being too large can be made precise in different ways. The size of a finite hypothesis space $\mathcal{H}$ can be defined as its cardinality $|\mathcal{H}|$ which is simply the number of its elements. For example, consider datapoints represented by $100 \times 10=1000$ black-and-white pixels and characterized by a binary label $y \in{0,1}$. We can model such datapoints using the feature space $\mathcal{X}={0,1}^{1000}$ and label space $\mathcal{Y}={0,1}$. The largest possible hypothesis space $\mathcal{H}=\mathcal{Y}^{\mathcal{X}}$ consists of all maps from $\mathcal{X}$ to $\mathcal{Y}$. The size or cardinality of this space is $|\mathcal{H}|=2^{2^{1000}}$

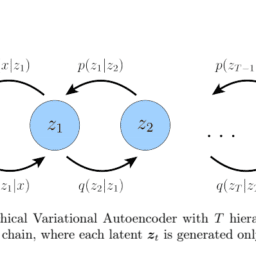

Many ML methods use a hypothesis space which contains infinitely many different predictor maps (see, e.g., (2.4)). For an infinite hypothesis space, we cannot use the number of its elements as a measure for its size. Indeed, for an infinite hypothesis space, the number of elements is not well-defined. Therefore, we measure the size of a hypothesis space $\mathcal{H}$ using its effective dimension $d_{\text {eff }}(\mathcal{H})$.

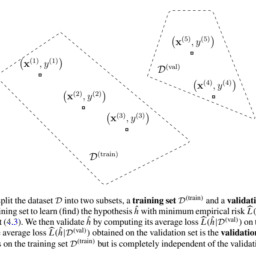

Consider a hypothesis space $\mathcal{H}$ consisting of maps $h: \mathcal{X} \rightarrow \mathcal{Y}$ that read in the features $\mathbf{x} \in \mathcal{X}$ and output an predicted label $\hat{y}=h(\mathbf{x}) \in \mathcal{Y}$. We define the effective dimension $d_{\text {eff }}(\mathcal{H})$ of $\mathcal{H}$ as the maximum number $D \in \mathbb{N}$ such that for any set $\mathcal{D}=$ $\left{\left(\mathbf{x}^{(1)}, y^{(1)}\right), \ldots,\left(\mathbf{x}^{(D)}, y^{(D)}\right)\right}$ of $D$ data points with different features, we can always find a hypothesis $h \in \mathcal{H}$ that perfectly fits the labels, $y^{(i)}=h\left(\mathbf{x}^{(i)}\right)$ for $i=1, \ldots, D$.

The effective dimension of a hypothesis space is closely related to the VapnikChervonenkis (VC) dimension [26]. The Vapnik-Chervonenkis (VC) dimension is maybe the most widely used concept for measuring the size of infinite hypothesis spaces [19, 26-28]. However, the precise definition of the Vapnik-Chervonenkis (VC) dimension are beyond the scope of this book. Moreover, the effective dimension captures most of the relevant properties of the Vapnik-Chervonenkis (VC) dimension for our purposes. For a precise definition of the Vapnik-Chervonenkis (VC) dimension and discussion of its applications in ML we refer to [27].

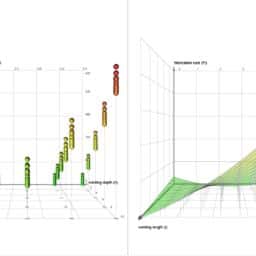

Let us illustrate our concept for the size of a hypothesis space with two examples: linear regression and polynomial regression. Linear regression uses the hypothesis space $\mathcal{H}^{(n)}=\left{h: \mathbb{R}^n \rightarrow \mathbb{R}: h(\mathbf{x})=\mathbf{w}^T \mathbf{x}\right.$ with some vector $\left.\mathbf{w} \in \mathbb{R}^n\right}$

机器学习代写

计算机代写|机器学习代写MACHINE LEARNING代 考|PARAMETRIZED HYPOTHESIS SPACES

当前广泛的科学计算环境允许高效的数值线性代数。这种硬件和软件允许有效地处理以数字数组形式提供的数据,例如向量、矩阵或张量

24

为了利用这种计算基础设施,许多机器学习方法使用假设空间

假设空间 $2.4$ 由线性映射构成 functions

$$

h^{(\mathbf{w})}(\mathbf{x}): \mathbb{R}^n \rightarrow \mathbb{R}: \mathbf{x} \mapsto \mathbf{w}^T \mathbf{x}

$$

功能 $h^{(\mathrm{w})} 2.5$ 以线性方式映射特征向量 $\mathbf{x} \in \mathbb{R}^n$ 到预恻的标签 $o r o u t p u t h^{(\mathbf{w})}(\mathbf{x})=\mathbf{x}^T \mathbf{w} \in \mathbb{R}$. 为了 $n=1$ 特征向量减少单个特征 $x$ 和假设空间 $2.4$ 由所有地图组成 $h^{(w)}(x)=w x$ 有一些重量 $w \in \mathbb{R}$ seeFig. $2.8$.

假设空间的元䋏 $\mathcal{H}$ 在 $2.4$ 由权重向量参数化 $\mathbf{w} \in \mathbb{R}^n$. 每张地图 $h^{(\mathbf{w})} \in \mathcal{H}$ 完全由权重向量指定 $\mathbf{w} \in \mathbb{R}^n$. 假设空间的这种参数化 $\mathcal{H}$ 允许通过向量运算处理和操作假设 图。特别是,而不是搜索函数空间 $\mathcal{H}$ itselementsarefunctions!为了找到一个好的假设,我们可以等效地搜索所有可能的权重向量w $\in \mathbb{R}^n$.

搜索空间 $\mathbb{R}^n$ 还是uncountably无限,但它具有丰富的几何和代数结构,使我们能够有效地搜索这个空间。第 5 章讨论了使用梯度概念来实现对良好权重的有效搜 㪍的方法 $\mathbf{w} \in \mathbb{R}^n$.

计算机代写机器学习代写MACHINE LEARNING代考|THE SIZE OF A HYPOTHESIS SPACE

假设空间太小或太大的概念可以通过不同的方式变得精确。有限假设空间的大小 $\mathcal{H}$ 可以定义为它的其数 $|\mathcal{H}|$ 这只是其元挈的数量。例如,考虑由表示的数据点

$100 \times 10=1000$ 黑白像塐并以二进制标签为特征 $y \in 0,1$. 我们可以使用特征空间对这些数据点进行建模 $\mathcal{X}=0,1^{1000}$ 和标签空间 $\mathcal{Y}=0,1$. 最大可能的假设空间 $\mathcal{H}=\mathcal{Y}^{\mathcal{X}}$ 由所有地图组成 $\mathcal{X}$ 至 $\mathcal{Y}$.这个空间的大小或基数是 $|\mathcal{H}|=2^{2^{10000}}$

许多机器学习方法使用一个假设空间,其中包含无限多不同的预测图 see, e.g. (2.4)。对于无限的假设空间,我们不能使用其元嗉的数量来衡量其大小。实际 上,对于无限的假设空间,元挈的数量并没有明确定义。因此,我们测量假设空间的大小 $\mathcal{H}$ 使用其有效维度 $d_{\text {eff }}(\mathcal{H})$.

26

瓦普尼克-切尔沃尼克斯 $V C$ 维度可能是测量无限假设空间大小的最广泛使用的概念

$19,26-28$

然而,Vapnik-Chervonenkis 的精确定义 $V C$ 维度超出了本书的范围。此外,有效尺寸捕获了 Vapnik-Chervonenkis 的大部分相关属性 $V C$ 尺寸为我们的目的。

Vapnik-Chervonenkis 的精确定义 $V C$ 维度及其在 ML 中的应用的讨论,我们参考

27

师我们用两个例子来说明我们关于假设空间大小的概念:线性回归和多项式回归。线性回归使用假设空间

计算机代写|机器学习代写Machine Learning代考 请认准UprivateTA™. UprivateTA™为您的留学生涯保驾护航。

微观经济学代写

微观经济学是主流经济学的一个分支,研究个人和企业在做出有关稀缺资源分配的决策时的行为以及这些个人和企业之间的相互作用。my-assignmentexpert™ 为您的留学生涯保驾护航 在数学Mathematics作业代写方面已经树立了自己的口碑, 保证靠谱, 高质且原创的数学Mathematics代写服务。我们的专家在图论代写Graph Theory代写方面经验极为丰富,各种图论代写Graph Theory相关的作业也就用不着 说。

线性代数代写

线性代数是数学的一个分支,涉及线性方程,如:线性图,如:以及它们在向量空间和通过矩阵的表示。线性代数是几乎所有数学领域的核心。

博弈论代写

现代博弈论始于约翰-冯-诺伊曼(John von Neumann)提出的两人零和博弈中的混合策略均衡的观点及其证明。冯-诺依曼的原始证明使用了关于连续映射到紧凑凸集的布劳威尔定点定理,这成为博弈论和数学经济学的标准方法。在他的论文之后,1944年,他与奥斯卡-莫根斯特恩(Oskar Morgenstern)共同撰写了《游戏和经济行为理论》一书,该书考虑了几个参与者的合作游戏。这本书的第二版提供了预期效用的公理理论,使数理统计学家和经济学家能够处理不确定性下的决策。

微积分代写

微积分,最初被称为无穷小微积分或 “无穷小的微积分”,是对连续变化的数学研究,就像几何学是对形状的研究,而代数是对算术运算的概括研究一样。

它有两个主要分支,微分和积分;微分涉及瞬时变化率和曲线的斜率,而积分涉及数量的累积,以及曲线下或曲线之间的面积。这两个分支通过微积分的基本定理相互联系,它们利用了无限序列和无限级数收敛到一个明确定义的极限的基本概念 。

计量经济学代写

什么是计量经济学?

计量经济学是统计学和数学模型的定量应用,使用数据来发展理论或测试经济学中的现有假设,并根据历史数据预测未来趋势。它对现实世界的数据进行统计试验,然后将结果与被测试的理论进行比较和对比。

根据你是对测试现有理论感兴趣,还是对利用现有数据在这些观察的基础上提出新的假设感兴趣,计量经济学可以细分为两大类:理论和应用。那些经常从事这种实践的人通常被称为计量经济学家。

Matlab代写

MATLAB 是一种用于技术计算的高性能语言。它将计算、可视化和编程集成在一个易于使用的环境中,其中问题和解决方案以熟悉的数学符号表示。典型用途包括:数学和计算算法开发建模、仿真和原型制作数据分析、探索和可视化科学和工程图形应用程序开发,包括图形用户界面构建MATLAB 是一个交互式系统,其基本数据元素是一个不需要维度的数组。这使您可以解决许多技术计算问题,尤其是那些具有矩阵和向量公式的问题,而只需用 C 或 Fortran 等标量非交互式语言编写程序所需的时间的一小部分。MATLAB 名称代表矩阵实验室。MATLAB 最初的编写目的是提供对由 LINPACK 和 EISPACK 项目开发的矩阵软件的轻松访问,这两个项目共同代表了矩阵计算软件的最新技术。MATLAB 经过多年的发展,得到了许多用户的投入。在大学环境中,它是数学、工程和科学入门和高级课程的标准教学工具。在工业领域,MATLAB 是高效研究、开发和分析的首选工具。MATLAB 具有一系列称为工具箱的特定于应用程序的解决方案。对于大多数 MATLAB 用户来说非常重要,工具箱允许您学习和应用专业技术。工具箱是 MATLAB 函数(M 文件)的综合集合,可扩展 MATLAB 环境以解决特定类别的问题。可用工具箱的领域包括信号处理、控制系统、神经网络、模糊逻辑、小波、仿真等。