如果你也在 怎样代写信息论information theory 这个学科遇到相关的难题,请随时右上角联系我们的24/7代写客服。信息论information theory回答了通信理论中的两个基本问题:什么是最终的数据压缩(答案:熵$H$),什么是通信的最终传输速率(答案:信道容量$C$)。由于这个原因,一些人认为信息论是通信理论的一个子集。我们认为它远不止于此。

信息论information theory在统计物理学(热力学)、计算机科学(柯尔莫哥洛夫复杂性或算法复杂性)、统计推断(奥卡姆剃刀:“最简单的解释是最好的”)以及概率和统计学(最优假设检验和估计的误差指数)方面都做出了根本性的贡献。

my-assignmentexpert™信息论information theory代写,免费提交作业要求, 满意后付款,成绩80\%以下全额退款,安全省心无顾虑。专业硕 博写手团队,所有订单可靠准时,保证 100% 原创。my-assignmentexpert, 最高质量的信息论information theory作业代写,服务覆盖北美、欧洲、澳洲等 国家。 在代写价格方面,考虑到同学们的经济条件,在保障代写质量的前提下,我们为客户提供最合理的价格。 由于统计Statistics作业种类很多,同时其中的大部分作业在字数上都没有具体要求,因此信息论information theory作业代写的价格不固定。通常在经济学专家查看完作业要求之后会给出报价。作业难度和截止日期对价格也有很大的影响。

想知道您作业确定的价格吗? 免费下单以相关学科的专家能了解具体的要求之后在1-3个小时就提出价格。专家的 报价比上列的价格能便宜好几倍。

my-assignmentexpert™ 为您的留学生涯保驾护航 在澳洲代写方面已经树立了自己的口碑, 保证靠谱, 高质且原创的澳洲代写服务。我们的专家在信息论information theory代写方面经验极为丰富,各种信息论information theory相关的作业也就用不着 说。

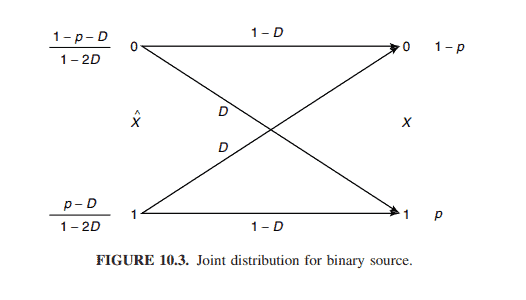

数学代写|信息论代写Information Theory代考|The Case of Two Regions on a Board at Which a Dart Is Thrown

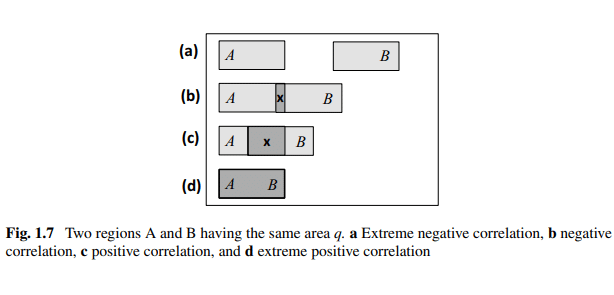

We discuss here an example, for which Venn diagram may be used for representing the various probabilities, but cannot be used to measure the extent of correlation (between two random variables).

We start with a simple case discussed in details in Ben-Naim [3]. We have a board of unit area. On this board, we draw two regions A and B, of equal areas, Fig. 1.7.

We throw a dart on this board. Clearly, since we chose the area of the entire board as unity, the probability of finding the dart (thrown blindly at the board) at any given region is equal to the area of that region. If the area of each rectangle in Fig. 1.7 is $q$ $=0.1$, then the probability of finding the dart at one specific rectangle is:

$$

P(A)=P(B)=q=0.1

$$

Next, we bring the two rectangles closer and closer to each other. We denote by $x$ the overlapping area between A and B. The joint probability of finding the dart in both $\mathrm{A}$ and $\mathrm{B}$ is:

$$

P(A \cdot B)=x

$$

The correlation between the two events A and B is defined by:

$$

g(A, B)=\frac{P(A \cdot B)}{P(A) P(B)}=\frac{x}{q^2}

$$

When $x=0$, the two events are disjoint (A and B have no common point), Fig. 1.7a. This means that the two events are negatively correlated; knowing that A occurred, excludes the occurrence of B. We call this negative correlation since in this case:

$$

\begin{aligned}

P(A \mid B)-P(A) & =\frac{P(A \cdot B)}{P(B)}-P(A) \

& =P(A) g(A, B)-P(A)=P(A)(g(A, B)-1)<0

\end{aligned}

$$

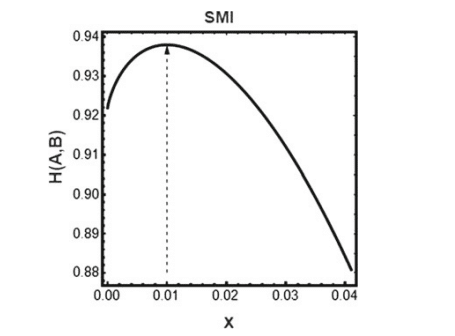

数学代写|信息论代写Information Theory代考|The Frustrating Search for a Measure of Frustration

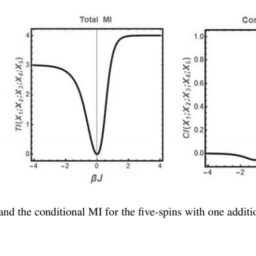

We also discussed the various possibilities of generalizations of the concept of mutual information (MI). We saw that the most natural generalization of the MI is the quantity which we referred to as the total correlation, which for $n$ random variables is defined by:

$$

T I\left(X_1 ; \ldots ; X_n\right)=\sum_{x_1, \ldots, x_n} P\left(x_1, \ldots, x_n\right) \log g\left(x_1, \ldots, x_n\right)

$$

where $g\left(x_1, \ldots, x_n\right)$ is the correlation between the $n$ events $X_1=x_1, X_2=$ $x_2, \ldots X_n=x_n$.

There are other definitions of MI which we referred to as conditional MI. For three random variables, this is defined by:

$$

C I\left(X_1 ; X_2 ; X_3\right)=I\left(X_1 ; X_2\right)-I\left(X_1 ; X_2 \mid X_3\right)

$$

This is a measure of the difference between the pair MI, and the conditional pair MI, given the presence of a third rv. It turns out that this definition can also be written in terms of the SMIs in this system:

$$

\begin{aligned}

C I\left(X_1 ; X_2 ; X_3\right)= & H\left(X_1\right)+H\left(X_2\right)+H\left(X_3\right)-H\left(X_1 ; X_2\right) \

& -H\left(X_1, X_3\right)-H\left(X_2, X_3\right)+H\left(X_1, X_2, X_3\right)

\end{aligned}

$$

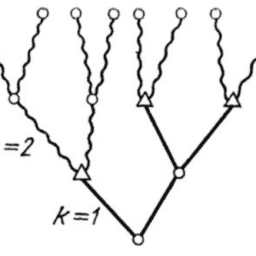

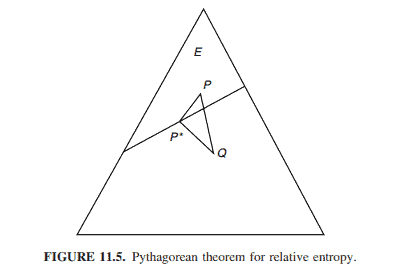

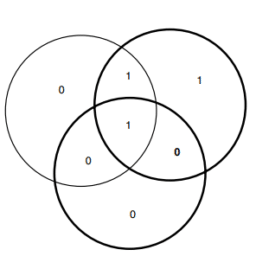

The sum of the terms on the right-hand-side of Eq. (1.29) is reminiscent of the inclusion-exclusion principle in probability (recall that $H\left(X_1\right)$ is the SMI of $\left.X_1\right)$. This fact has led some authors to use Venn diagrams to represent the extent of dependence between three random variables. A typical such a Venn diagram is shown in Fig. 1.10 [the triplet MI is denoted $\mathrm{I}_3$ by Matsuda [14]].

Unfortunately, this is a misleading representation of the MI. As we have seen in the previous section, Venn diagrams cannot be used to represent the extent of dependence between two random variables. It is a fortiori misleading to do so for three or four random variables. In this section, we shall examine a few examples for which there is no relationship between the extent of overlapping between three events (or three random variables) and the extent of dependence. In fact, we shall see examples where the conditional MI between three events could be negative. This certainly cannot be represented by a (positive) overlapping area in a Venn diagram.

The conditional MI has also been interpreted as a measure of frustration [14]. As we have seen in Ben-Naim [1], there are cases where the CI turns out to be negative in a three-spin system. However, this is not always true. We shall present a few examples where CI can be either positive or negative, but it is impossible to relate these values to extent of frustration in the system. We will conclude that the quantity CI cannot, in general, be used as a measure of frustration.

信息论代写

数学代写|信息论代写Information Theory代考|The Case of Two Regions on a Board at Which a Dart Is Thrown

我们在这里讨论一个例子,其中维恩图可用于表示各种概率,但不能用于测量相关性的程度(两个随机变量之间)。

我们从Ben-Naim[3]中详细讨论的一个简单案例开始。我们有一个单位面积的板。在这块黑板上,我们画出面积相等的两个区域A和B,如图1.7。

我们在这块板上扔飞镖。显然,因为我们选择了整个棋盘的面积作为一个单位,所以在任何给定区域找到飞镖(向棋盘盲目投掷)的概率等于该区域的面积。若图1.7中每个矩形的面积为$q$$=0.1$,则在某一特定矩形上找到省道的概率为:

$$

P(A)=P(B)=q=0.1

$$

接下来,我们使两个矩形彼此越来越近。我们用$x$表示A和b的重叠区域,在$\mathrm{A}$和$\mathrm{B}$中找到省道的联合概率为:

$$

P(A \cdot B)=x

$$

A和B两个事件之间的相关性定义为:

$$

g(A, B)=\frac{P(A \cdot B)}{P(A) P(B)}=\frac{x}{q^2}

$$

当$x=0$时,两个事件不相交(A、B无共点),图1.7a。这意味着这两个事件是负相关的;知道A发生了,排除了b的发生,我们称之为负相关,因为在这种情况下:

$$

\begin{aligned}

P(A \mid B)-P(A) & =\frac{P(A \cdot B)}{P(B)}-P(A) \

& =P(A) g(A, B)-P(A)=P(A)(g(A, B)-1)<0

\end{aligned}

$$

数学代写|信息论代写Information Theory代考|The Frustrating Search for a Measure of Frustration

我们还讨论了互信息(MI)概念泛化的各种可能性。我们看到,MI最自然的概括是我们称之为总相关性的量,对于$n$随机变量,其定义为:

$$

T I\left(X_1 ; \ldots ; X_n\right)=\sum_{x_1, \ldots, x_n} P\left(x_1, \ldots, x_n\right) \log g\left(x_1, \ldots, x_n\right)

$$

其中$g\left(x_1, \ldots, x_n\right)$是$n$事件之间的相关性$X_1=x_1, X_2=$$x_2, \ldots X_n=x_n$。

MI还有其他定义,我们称之为条件MI。对于三个随机变量,定义为:

$$

C I\left(X_1 ; X_2 ; X_3\right)=I\left(X_1 ; X_2\right)-I\left(X_1 ; X_2 \mid X_3\right)

$$

这是在给定第三个rv存在的情况下,对MI和条件对MI之间的差异的度量。事实证明,这个定义也可以用这个系统中的smi来表示:

$$

\begin{aligned}

C I\left(X_1 ; X_2 ; X_3\right)= & H\left(X_1\right)+H\left(X_2\right)+H\left(X_3\right)-H\left(X_1 ; X_2\right) \

& -H\left(X_1, X_3\right)-H\left(X_2, X_3\right)+H\left(X_1, X_2, X_3\right)

\end{aligned}

$$

等式(1.29)右侧的项之和让人联想到概率中的包容-排除原则(回想一下$H\left(X_1\right)$是$\left.X_1\right)$的SMI)。这一事实导致一些作者使用维恩图来表示三个随机变量之间的依赖程度。一个典型的维恩图如图1.10所示[三联体MI由Matsuda[14]表示为$\mathrm{I}_3$]。

不幸的是,这是对MI的一种误导性表示。正如我们在前一节中看到的,维恩图不能用于表示两个随机变量之间的依赖程度。对于三个或四个随机变量,这样做是一种更大的误导。在本节中,我们将研究几个例子,其中三个事件(或三个随机变量)之间的重叠程度与依赖程度之间没有关系。事实上,我们将看到三个事件之间的条件MI可能为负的例子。这当然不能用维恩图中的(正)重叠区域来表示。

条件性MI也被解释为挫败感的衡量标准[14]。正如我们在Ben-Naim[1]中看到的那样,在三自旋体系中存在CI为负的情况。然而,这并不总是正确的。我们将提供一些CI可以为正或负的例子,但不可能将这些值与系统中的挫折程度联系起来。我们将得出结论,一般来说,CI不能作为挫败感的度量。

数学代写|信息论代写Information Theory代考 请认准UprivateTA™. UprivateTA™为您的留学生涯保驾护航。

微观经济学代写

微观经济学是主流经济学的一个分支,研究个人和企业在做出有关稀缺资源分配的决策时的行为以及这些个人和企业之间的相互作用。my-assignmentexpert™ 为您的留学生涯保驾护航 在数学Mathematics作业代写方面已经树立了自己的口碑, 保证靠谱, 高质且原创的数学Mathematics代写服务。我们的专家在图论代写Graph Theory代写方面经验极为丰富,各种图论代写Graph Theory相关的作业也就用不着 说。

线性代数代写

线性代数是数学的一个分支,涉及线性方程,如:线性图,如:以及它们在向量空间和通过矩阵的表示。线性代数是几乎所有数学领域的核心。

博弈论代写

现代博弈论始于约翰-冯-诺伊曼(John von Neumann)提出的两人零和博弈中的混合策略均衡的观点及其证明。冯-诺依曼的原始证明使用了关于连续映射到紧凑凸集的布劳威尔定点定理,这成为博弈论和数学经济学的标准方法。在他的论文之后,1944年,他与奥斯卡-莫根斯特恩(Oskar Morgenstern)共同撰写了《游戏和经济行为理论》一书,该书考虑了几个参与者的合作游戏。这本书的第二版提供了预期效用的公理理论,使数理统计学家和经济学家能够处理不确定性下的决策。

微积分代写

微积分,最初被称为无穷小微积分或 “无穷小的微积分”,是对连续变化的数学研究,就像几何学是对形状的研究,而代数是对算术运算的概括研究一样。

它有两个主要分支,微分和积分;微分涉及瞬时变化率和曲线的斜率,而积分涉及数量的累积,以及曲线下或曲线之间的面积。这两个分支通过微积分的基本定理相互联系,它们利用了无限序列和无限级数收敛到一个明确定义的极限的基本概念 。

计量经济学代写

什么是计量经济学?

计量经济学是统计学和数学模型的定量应用,使用数据来发展理论或测试经济学中的现有假设,并根据历史数据预测未来趋势。它对现实世界的数据进行统计试验,然后将结果与被测试的理论进行比较和对比。

根据你是对测试现有理论感兴趣,还是对利用现有数据在这些观察的基础上提出新的假设感兴趣,计量经济学可以细分为两大类:理论和应用。那些经常从事这种实践的人通常被称为计量经济学家。

Matlab代写

MATLAB 是一种用于技术计算的高性能语言。它将计算、可视化和编程集成在一个易于使用的环境中,其中问题和解决方案以熟悉的数学符号表示。典型用途包括:数学和计算算法开发建模、仿真和原型制作数据分析、探索和可视化科学和工程图形应用程序开发,包括图形用户界面构建MATLAB 是一个交互式系统,其基本数据元素是一个不需要维度的数组。这使您可以解决许多技术计算问题,尤其是那些具有矩阵和向量公式的问题,而只需用 C 或 Fortran 等标量非交互式语言编写程序所需的时间的一小部分。MATLAB 名称代表矩阵实验室。MATLAB 最初的编写目的是提供对由 LINPACK 和 EISPACK 项目开发的矩阵软件的轻松访问,这两个项目共同代表了矩阵计算软件的最新技术。MATLAB 经过多年的发展,得到了许多用户的投入。在大学环境中,它是数学、工程和科学入门和高级课程的标准教学工具。在工业领域,MATLAB 是高效研究、开发和分析的首选工具。MATLAB 具有一系列称为工具箱的特定于应用程序的解决方案。对于大多数 MATLAB 用户来说非常重要,工具箱允许您学习和应用专业技术。工具箱是 MATLAB 函数(M 文件)的综合集合,可扩展 MATLAB 环境以解决特定类别的问题。可用工具箱的领域包括信号处理、控制系统、神经网络、模糊逻辑、小波、仿真等。