如果你也在 怎样代写信息论information theory 这个学科遇到相关的难题,请随时右上角联系我们的24/7代写客服。信息论information theory的一个关键衡量标准是熵。熵量化了随机变量的值或随机过程的结果中所涉及的不确定性的数量。例如,确定一个公平的抛硬币的结果(有两个同样可能的结果)比确定一个掷骰子的结果(有六个同样可能的结果)提供的信息要少(熵值较低)。

信息论information theory基本课题的应用包括源编码/数据压缩(如ZIP文件),以及信道编码/错误检测和纠正(如DSL)。它的影响对于旅行者号深空任务的成功、光盘的发明、移动电话的可行性和互联网的发展都至关重要。该理论在其他领域也有应用,包括统计推理、密码学、神经生物学、感知、语言学、分子代码的进化和功能(生物信息学)、热物理、分子动力学、量子计算、黑洞、信息检索、情报收集、剽窃检测、模式识别、异常检测甚至艺术创作。

my-assignmentexpert™信息论information theory代写,免费提交作业要求, 满意后付款,成绩80\%以下全额退款,安全省心无顾虑。专业硕 博写手团队,所有订单可靠准时,保证 100% 原创。my-assignmentexpert, 最高质量的信息论information theory作业代写,服务覆盖北美、欧洲、澳洲等 国家。 在代写价格方面,考虑到同学们的经济条件,在保障代写质量的前提下,我们为客户提供最合理的价格。 由于统计Statistics作业种类很多,同时其中的大部分作业在字数上都没有具体要求,因此信息论information theory作业代写的价格不固定。通常在经济学专家查看完作业要求之后会给出报价。作业难度和截止日期对价格也有很大的影响。

想知道您作业确定的价格吗? 免费下单以相关学科的专家能了解具体的要求之后在1-3个小时就提出价格。专家的 报价比上列的价格能便宜好几倍。

my-assignmentexpert™ 为您的留学生涯保驾护航 在澳洲代写方面已经树立了自己的口碑, 保证靠谱, 高质且原创的澳洲代写服务。我们的专家在信息论information theory代写方面经验极为丰富,各种信息论information theory相关的作业也就用不着 说。

我们提供的信息论information theory及其相关学科的代写,服务范围广, 其中包括但不限于:

数学代写|信息论代写Information Theory代考|Noiseless Binary Channel

Suppose that we have a channel whose the binary input is reproduced exactly at the output (Figure 7.2).

In this case, any transmitted bit is received without error. Hence, one error-free bit can be transmitted per use of the channel, and the capacity is 1 bit. We can also calculate the information capacity $C=\max I(X ; Y)=$ 1 bit, which is achieved by using $p(x)=\left(\frac{1}{2}, \frac{1}{2}\right)$.

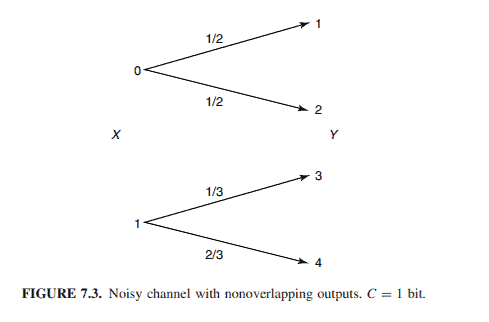

Noisy Channel with Nonoverlapping Outputs

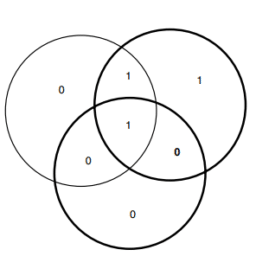

This channel has two possible outputs corresponding to each of the two inputs (Figure 7.3). The channel appears to be noisy, but really is not. Even though the output of the channel is a random consequence of the input, the input can be determined from the output, and hence every transmitted bit can be recovered without error. The capacity of this channel is also 1 bit per transmission. We can also calculate the information capacity $C=\max I(X ; Y)=1$ bit, which is achieved by using $p(x)=\left(\frac{1}{2}, \frac{1}{2}\right)$.

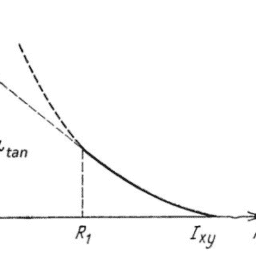

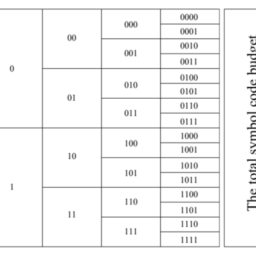

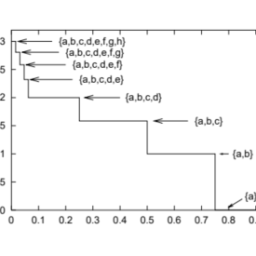

In this case the channel input is either received unchanged at the output with probability $\frac{1}{2}$ or is transformed into the next letter with probability $\frac{1}{2}$ (Figure 7.4). If the input has 26 symbols and we use every alternate input symbol, we can transmit one of 13 symbols without error with each transmission. Hence, the capacity of this channel is $\log 13$ bits per transmission. We can also calculate the information capacity $C=\max I(X ; Y)=\max (H(Y)-H(Y \mid X))=$ $\max H(Y)-1=\log 26-1=\log 13$, achieved by using $p(x)$ distributed uniformly over all the inputs.

数学代写|信息论代写Information Theory代考|Binary Symmetric Channel

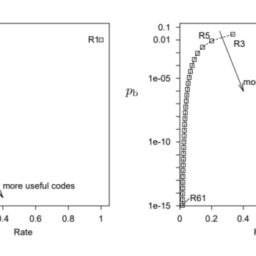

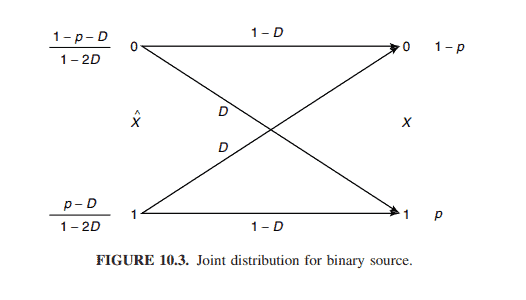

Consider the binary symmetric channel (BSC), which is shown in Fig. 7.5. This is a binary channel in which the input symbols are complemented with probability $p$. This is the simplest model of a channel with errors, yet it captures most of the complexity of the general problem.

When an error occurs, a 0 is received as a 1 , and vice versa. The bits received do not reveal where the errors have occurred. In a sense, all the bits received are unreliable. Later we show that we can still use such a communication channel to send information at a nonzero rate with an arbitrarily small probability of error.

We bound the mutual information by

$$

\begin{aligned}

I(X ; Y) & =H(Y)-H(Y \mid X) \

& =H(Y)-\sum p(x) H(Y \mid X=x) \

& =H(Y)-\sum p(x) H(p) \

& =H(Y)-H(p) \

& \leq 1-H(p),

\end{aligned}

$$

where the last inequality follows because $Y$ is a binary random variable. Equality is achieved when the input distribution is uniform. Hence, the information capacity of a binary symmetric channel with parameter $p$ is

$$

C=1-H(p) \quad \text { bits. }

$$

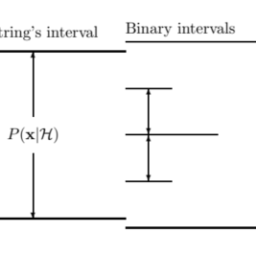

The analog of the binary symmetric channel in which some bits are lost (rather than corrupted) is the binary erasure channel. In this channel, a fraction $\alpha$ of the bits are erased. The receiver knows which bits have been erased. The binary erasure channel has two inputs and three outputs (Figure 7.6).

We calculate the capacity of the binary erasure channel as follows:

$$

\begin{aligned}

C & =\max {p(x)} I(X ; Y) \ & =\max {p(x)}(H(Y)-H(Y \mid X)) \

& =\max _{p(x)} H(Y)-H(\alpha) .

\end{aligned}

$$

The first guess for the maximum of $H(Y)$ would be $\log 3$, but we cannot achieve this by any choice of input distribution $p(x)$. Letting $E$ be the event ${Y=e}$, using the expansion

$$

H(Y)=H(Y, E)=H(E)+H(Y \mid E),

$$

and letting $\operatorname{Pr}(X=1)=\pi$, we have

$$

H(Y)=H((1-\pi)(1-\alpha), \alpha, \pi(1-\alpha))=H(\alpha)+(1-\alpha) H(\pi) .

$$

Hence

$$

\begin{aligned}

C & =\max {p(x)} H(Y)-H(\alpha) \ & =\max \pi(1-\alpha) H(\pi)+H(\alpha)-H(\alpha) \

& =\max _\pi(1-\alpha) H(\pi) \

& =1-\alpha,

\end{aligned}

$$

where capacity is achieved by $\pi=\frac{1}{2}$.

The expression for the capacity has some intuitive meaning: Since a proportion $\alpha$ of the bits are lost in the channel, we can recover (at most) a proportion $1-\alpha$ of the bits. Hence the capacity is at most $1-\alpha$. It is not immediately obvious that it is possible to achieve this rate. This will follow from Shannon’s second theorem.

In many practical channels, the sender receives some feedback from the receiver. If feedback is available for the binary erasure channel, it is very clear what to do: If a bit is lost, retransmit it until it gets through. Since the bits get through with probability $1-\alpha$, the effective rate of transmission is $1-\alpha$. In this way we are easily able to achieve a capacity of $1-\alpha$ with feedback.

信息论代写

数学代写|信息论代写Information Theory代考|Noiseless Binary Channel

假设我们有一个通道,它的二进制输入恰好在输出处再现(图7.2)。

在这种情况下,任何发送的比特都被正确接收。因此,每次使用通道可以传输一个无错误位,容量为1位。我们还可以计算信息容量$C=\max I(X ; Y)=$ 1比特,这是通过$p(x)=\left(\frac{1}{2}, \frac{1}{2}\right)$来实现的。

输出不重叠的噪声通道

该通道有两个可能的输出,对应于两个输入中的每一个(图7.3)。这个频道看起来有噪声,但实际上没有。尽管信道的输出是输入的随机结果,但可以从输出中确定输入,因此每个传输的位都可以准确无误地恢复。该信道的容量也是每次传输1位。我们还可以计算信息容量$C=\max I(X ; Y)=1$位,这是通过$p(x)=\left(\frac{1}{2}, \frac{1}{2}\right)$来实现的。

在这种情况下,通道输入要么以$\frac{1}{2}$的概率不变地在输出处接收,要么以$\frac{1}{2}$的概率转换为下一个字母(图7.4)。如果输入有26个符号,我们使用每个备用输入符号,我们可以在每次传输中传输13个符号中的一个而不会出错。因此,该信道的容量为每次传输$\log 13$位。我们还可以计算信息容量$C=\max I(X ; Y)=\max (H(Y)-H(Y \mid X))=$$\max H(Y)-1=\log 26-1=\log 13$,通过使用$p(x)$均匀分布在所有输入上实现。

数学代写|信息论代写Information Theory代考|Binary Symmetric Channel

考虑二进制对称信道(BSC),如图7.5所示。这是一个二进制通道,其中输入符号与概率$p$互补。这是具有错误的通道的最简单模型,但它捕获了一般问题的大部分复杂性。

当发生错误时,0被接收为1,反之亦然。接收到的比特并不能显示错误发生的位置。从某种意义上说,所有接收到的比特都是不可靠的。后来我们证明了我们仍然可以使用这样的通信信道以任意小的错误概率以非零速率发送信息。

我们约束互信息

$$

\begin{aligned}

I(X ; Y) & =H(Y)-H(Y \mid X) \

& =H(Y)-\sum p(x) H(Y \mid X=x) \

& =H(Y)-\sum p(x) H(p) \

& =H(Y)-H(p) \

& \leq 1-H(p),

\end{aligned}

$$

最后一个不等式因为$Y$是一个二元随机变量。当输入分布均匀时,就达到相等。因此,参数为$p$的二进制对称信道的信息容量为

$$

C=1-H(p) \quad \text { bits. }

$$

二进制对称信道的一些比特丢失(而不是损坏)的模拟是二进制擦除信道。在这个信道中,一部分$\alpha$位被擦除。接收器知道哪些比特被擦除。二进制擦除通道有两个输入和三个输出(图7.6)。

我们计算二进制擦除通道的容量如下:

$$

\begin{aligned}

C & =\max {p(x)} I(X ; Y) \ & =\max {p(x)}(H(Y)-H(Y \mid X)) \

& =\max {p(x)} H(Y)-H(\alpha) . \end{aligned} $$ 对于$H(Y)$的最大值的第一个猜测是$\log 3$,但是我们不能通过任何输入分布$p(x)$的选择来实现这一点。让$E$为事件${Y=e}$,使用扩展 $$ H(Y)=H(Y, E)=H(E)+H(Y \mid E), $$ 让$\operatorname{Pr}(X=1)=\pi$ $$ H(Y)=H((1-\pi)(1-\alpha), \alpha, \pi(1-\alpha))=H(\alpha)+(1-\alpha) H(\pi) . $$ 因此 $$ \begin{aligned} C & =\max {p(x)} H(Y)-H(\alpha) \ & =\max \pi(1-\alpha) H(\pi)+H(\alpha)-H(\alpha) \ & =\max \pi(1-\alpha) H(\pi) \

& =1-\alpha,

\end{aligned}

$$

其中容量通过$\pi=\frac{1}{2}$实现。

容量的表达式有一些直观的含义:由于通道中丢失了比例$\alpha$的比特,我们可以(最多)恢复比例$1-\alpha$的比特。因此容量最多为$1-\alpha$。目前还不清楚是否有可能实现这一速度。这是从香农的第二个定理推导出来的。

在许多实际的通道中,发送者从接收者那里接收一些反馈。如果对二进制擦除通道有反馈,该怎么做就很清楚了:如果丢失了一个比特,就重新传输它,直到它通过为止。由于比特通过的概率为$1-\alpha$,因此有效传输速率为$1-\alpha$。通过这种方式,我们很容易获得$1-\alpha$的反馈能力。

数学代写|信息论代写Information Theory代考 请认准UprivateTA™. UprivateTA™为您的留学生涯保驾护航。

微观经济学代写

微观经济学是主流经济学的一个分支,研究个人和企业在做出有关稀缺资源分配的决策时的行为以及这些个人和企业之间的相互作用。my-assignmentexpert™ 为您的留学生涯保驾护航 在数学Mathematics作业代写方面已经树立了自己的口碑, 保证靠谱, 高质且原创的数学Mathematics代写服务。我们的专家在图论代写Graph Theory代写方面经验极为丰富,各种图论代写Graph Theory相关的作业也就用不着 说。

线性代数代写

线性代数是数学的一个分支,涉及线性方程,如:线性图,如:以及它们在向量空间和通过矩阵的表示。线性代数是几乎所有数学领域的核心。

博弈论代写

现代博弈论始于约翰-冯-诺伊曼(John von Neumann)提出的两人零和博弈中的混合策略均衡的观点及其证明。冯-诺依曼的原始证明使用了关于连续映射到紧凑凸集的布劳威尔定点定理,这成为博弈论和数学经济学的标准方法。在他的论文之后,1944年,他与奥斯卡-莫根斯特恩(Oskar Morgenstern)共同撰写了《游戏和经济行为理论》一书,该书考虑了几个参与者的合作游戏。这本书的第二版提供了预期效用的公理理论,使数理统计学家和经济学家能够处理不确定性下的决策。

微积分代写

微积分,最初被称为无穷小微积分或 “无穷小的微积分”,是对连续变化的数学研究,就像几何学是对形状的研究,而代数是对算术运算的概括研究一样。

它有两个主要分支,微分和积分;微分涉及瞬时变化率和曲线的斜率,而积分涉及数量的累积,以及曲线下或曲线之间的面积。这两个分支通过微积分的基本定理相互联系,它们利用了无限序列和无限级数收敛到一个明确定义的极限的基本概念 。

计量经济学代写

什么是计量经济学?

计量经济学是统计学和数学模型的定量应用,使用数据来发展理论或测试经济学中的现有假设,并根据历史数据预测未来趋势。它对现实世界的数据进行统计试验,然后将结果与被测试的理论进行比较和对比。

根据你是对测试现有理论感兴趣,还是对利用现有数据在这些观察的基础上提出新的假设感兴趣,计量经济学可以细分为两大类:理论和应用。那些经常从事这种实践的人通常被称为计量经济学家。

Matlab代写

MATLAB 是一种用于技术计算的高性能语言。它将计算、可视化和编程集成在一个易于使用的环境中,其中问题和解决方案以熟悉的数学符号表示。典型用途包括:数学和计算算法开发建模、仿真和原型制作数据分析、探索和可视化科学和工程图形应用程序开发,包括图形用户界面构建MATLAB 是一个交互式系统,其基本数据元素是一个不需要维度的数组。这使您可以解决许多技术计算问题,尤其是那些具有矩阵和向量公式的问题,而只需用 C 或 Fortran 等标量非交互式语言编写程序所需的时间的一小部分。MATLAB 名称代表矩阵实验室。MATLAB 最初的编写目的是提供对由 LINPACK 和 EISPACK 项目开发的矩阵软件的轻松访问,这两个项目共同代表了矩阵计算软件的最新技术。MATLAB 经过多年的发展,得到了许多用户的投入。在大学环境中,它是数学、工程和科学入门和高级课程的标准教学工具。在工业领域,MATLAB 是高效研究、开发和分析的首选工具。MATLAB 具有一系列称为工具箱的特定于应用程序的解决方案。对于大多数 MATLAB 用户来说非常重要,工具箱允许您学习和应用专业技术。工具箱是 MATLAB 函数(M 文件)的综合集合,可扩展 MATLAB 环境以解决特定类别的问题。可用工具箱的领域包括信号处理、控制系统、神经网络、模糊逻辑、小波、仿真等。