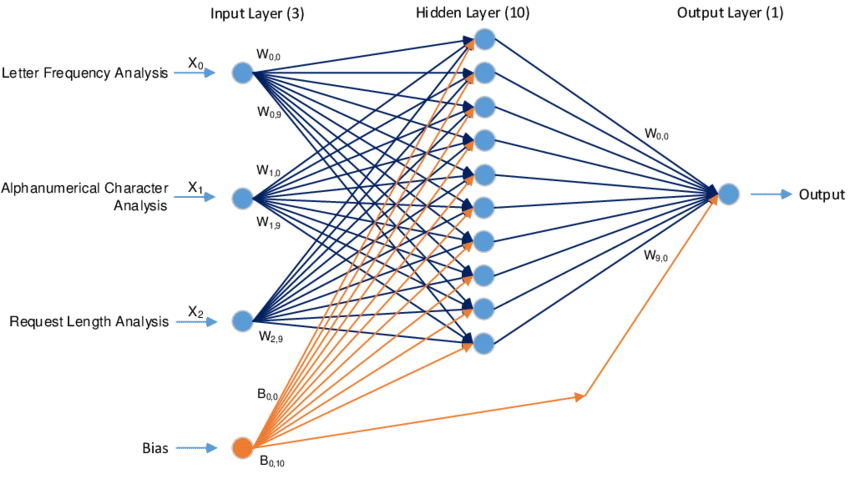

如果你也在 怎样代写神经网络Neural Networks AIML425这个学科遇到相关的难题,请随时右上角联系我们的24/7代写客服。神经网络Neural Networks理论既有助于更好地确定大脑中的神经元如何运作,也为创造人工智能的努力提供了基础。反映了人脑的行为,使计算机程序能够识别模式并解决人工智能、机器学习和深度学习领域的常见问题。

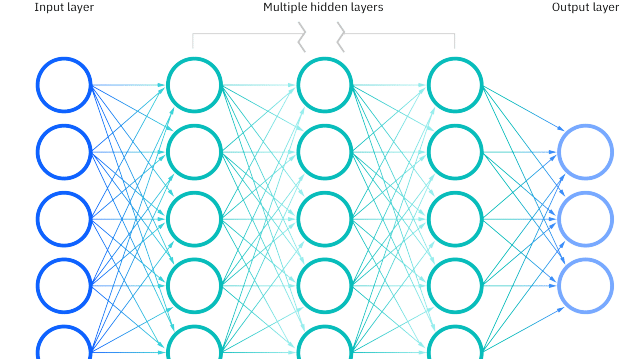

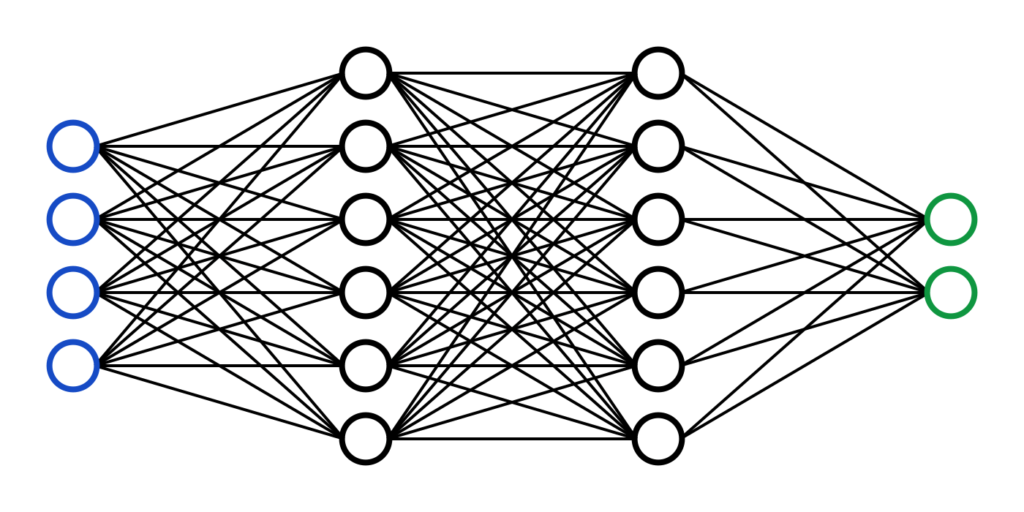

神经网络Neural Networks也被称为人工神经网络(ANN)或模拟神经网络(SNN),是机器学习的一个子集,是深度学习算法的核心。它们的名称和结构受到人脑的启发,模仿了生物神经元相互之间的信号方式。

my-assignmentexpert™ 神经网络Neural Networks作业代写,免费提交作业要求, 满意后付款,成绩80\%以下全额退款,安全省心无顾虑。专业硕 博写手团队,所有订单可靠准时,保证 100% 原创。my-assignmentexpert™, 最高质量的神经网络Neural Networks作业代写,服务覆盖北美、欧洲、澳洲等 国家。 在代写价格方面,考虑到同学们的经济条件,在保障代写质量的前提下,我们为客户提供最合理的价格。 由于统计Statistics作业种类很多,同时其中的大部分作业在字数上都没有具体要求,因此神经网络Neural Networks作业代写的价格不固定。通常在经济学专家查看完作业要求之后会给出报价。作业难度和截止日期对价格也有很大的影响。

想知道您作业确定的价格吗? 免费下单以相关学科的专家能了解具体的要求之后在1-3个小时就提出价格。专家的 报价比上列的价格能便宜好几倍。

my-assignmentexpert™ 为您的留学生涯保驾护航 在机器学习Machine Learning作业代写方面已经树立了自己的口碑, 保证靠谱, 高质且原创的机器学习Machine Learning代写服务。我们的专家在神经网络Neural Networks代写方面经验极为丰富,各种神经网络Neural Networks相关的作业也就用不着 说。

机器学习代写|神经网络代写Neural Networks代考|LMA Training

- Newton’s Method

- Calculating the Hessian

- The Levenberg-Marquardt Algorithm

- Multiple Output Neurons

The Levenberg-Marquardt algorithm (LMA) is a very efficient training method for neural networks. In many cases, LMA will outperform RPROP. Because of this, it is an important training algorithm that should be considered by any neural network programmer.

LMA is a hybrid algorithm that is based both on Newton’s Method (GNA) and on gradient descent (backpropagation). This allows LMA to combine the strengths of both. Gradient descent is guaranteed to converge to a local minimum, but it is quite slow. Newton’s Method is quite fast but often fails to converge. By using a damping factor to interpolate between the two, a hybrid method is created. To understand how this works, we will first examine Newton’s method. Newton’s Method is shown in Equation 7.1.

Equation 7.1: Newton’s Method (GNA)

$$

W_{\min }=W_0-H^{-1} g

$$

You will notice several variables in the equation above. The result of the equation is deltas that can be applied to the weights of the neural network. The variable $\mathbf{H}$ represents the Hessian. This will be covered in the next section. The variable $\mathrm{g}$ represents the gradients of the neural network. You will also notice the -1 “exponent” on the variable $\mathbf{H}$. This specifies that we are doing a matrix decomposition of the variables $\mathbf{H}$ and $\mathbf{g}$.

We could easily spend an entire chapter on matrix decomposition. But instead, in this book, we will simply treat matrix decomposition as a black box atomic operator. Much as if I tell you to take the square root of a number, I do not explain how to calculate a square root – I simply assume that you will use the square root function in your programming language of choice. There is a common piece of code for matrix decomposition included in the JAMA package. This public domain code, which was adapted from a FORTRAN program, has been used in many mathematical computer applications. You can use JAMA or another source to perform matrix decomposition.

机器学习代写|神经网络代写Neural Networks代考|Calculation of the Hessian

The Hessian matrix is a square matrix with rows and columns equal to the number of weights in the neural network. Each cell in this matrix represents the second order derivative of the output of the neural network with respect to a given weight combination. The Hessian is shown in Equation 7.3.

Equation 7.3: The Hessian Matrix

It is important to note that the Hessian is symmetrical about the diagonal. This can be used to enhance performance of the calculation. You can calculate the Hessian by calculating the gradients.

Equation 7.4: Calculating the Gradients

$$

\frac{\partial E}{\partial w_{(i)}}=2(y-t) \frac{\partial y}{\partial w_{(0)}}

$$

The second derivative of the above equation becomes an element of the Hessian matrix. This is calculated using the following formula:

Equation 7.5: Calculating the Exact Hessian

$$

\frac{\partial^2 E}{\partial w_i w_j}=2\left(\frac{\partial y}{\partial w_j} \frac{\partial y}{\partial w_j}+(y-t) \frac{\partial^2 y}{\partial w_j \partial w_j}\right)

$$

神经网络代写

机器学习代写|神经网络代写Neural Networks代考|LMA Training

牛顿法

计算黑森系数

Levenberg-Marquardt算法

多输出神经元

Levenberg-Marquardt算法(LMA)是一种非常有效的神经网络训练方法。在许多情况下,LMA的表现将优于RPROP。正因为如此,它是任何神经网络程序员都应该考虑的重要训练算法。

LMA是一种基于牛顿法(GNA)和梯度下降法(反向传播)的混合算法。这使得LMA能够结合两者的优势。梯度下降法保证收敛到局部最小值,但速度很慢。牛顿法是相当快的,但往往不能收敛。利用阻尼因子在两者之间进行插值,建立了一种混合插值方法。为了理解它是如何工作的,我们将首先检查牛顿的方法。牛顿法如式7.1所示。

式7.1:牛顿法(GNA)

$$

W_{\min }=W_0-H^{-1} g

$$

你会注意到上面等式中的几个变量。方程的结果是可以应用于神经网络权重的delta。变量$\mathbf{H}$表示Hessian。这将在下一节中讨论。变量$\mathrm{g}$表示神经网络的梯度。您还会注意到变量$\mathbf{H}$上的-1“指数”。这说明我们正在对变量$\mathbf{H}$和$\mathbf{g}$进行矩阵分解。

我们可以很容易地用一整章来讨论矩阵分解。但是,在本书中,我们将简单地把矩阵分解当作一个黑盒原子算子。就像我告诉您取一个数字的平方根一样,我没有解释如何计算平方根—我只是假设您将在您选择的编程语言中使用平方根函数。在JAMA包中包含了一段用于矩阵分解的通用代码。这个公共领域代码,改编自FORTRAN程序,已经在许多数学计算机应用中使用。您可以使用JAMA或其他源来执行矩阵分解。

机器学习代写|神经网络代写Neural Networks代考|Calculation of the Hessian

Hessian矩阵是一个方阵,其行和列等于神经网络中的权重数。这个矩阵中的每个单元表示神经网络的输出对给定权重组合的二阶导数。黑森曲线如式7.3所示。

式7.3:Hessian矩阵

重要的是要注意黑森是对称的对角线。这可以用来提高计算的性能。你可以通过计算梯度来计算黑森系数。

式7.4:计算梯度

$$

\frac{\partial E}{\partial w_{(i)}}=2(y-t) \frac{\partial y}{\partial w_{(0)}}

$$

上述方程的二阶导数成为黑森矩阵的一个元素。计算公式如下:

公式7.5:精确黑森的计算

$$

\frac{\partial^2 E}{\partial w_i w_j}=2\left(\frac{\partial y}{\partial w_j} \frac{\partial y}{\partial w_j}+(y-t) \frac{\partial^2 y}{\partial w_j \partial w_j}\right)

$$

机器学习代写|神经网络代写Neural Networks代考 请认准UprivateTA™. UprivateTA™为您的留学生涯保驾护航。

微观经济学代写

微观经济学是主流经济学的一个分支,研究个人和企业在做出有关稀缺资源分配的决策时的行为以及这些个人和企业之间的相互作用。my-assignmentexpert™ 为您的留学生涯保驾护航 在数学Mathematics作业代写方面已经树立了自己的口碑, 保证靠谱, 高质且原创的数学Mathematics代写服务。我们的专家在图论代写Graph Theory代写方面经验极为丰富,各种图论代写Graph Theory相关的作业也就用不着 说。

线性代数代写

线性代数是数学的一个分支,涉及线性方程,如:线性图,如:以及它们在向量空间和通过矩阵的表示。线性代数是几乎所有数学领域的核心。

博弈论代写

现代博弈论始于约翰-冯-诺伊曼(John von Neumann)提出的两人零和博弈中的混合策略均衡的观点及其证明。冯-诺依曼的原始证明使用了关于连续映射到紧凑凸集的布劳威尔定点定理,这成为博弈论和数学经济学的标准方法。在他的论文之后,1944年,他与奥斯卡-莫根斯特恩(Oskar Morgenstern)共同撰写了《游戏和经济行为理论》一书,该书考虑了几个参与者的合作游戏。这本书的第二版提供了预期效用的公理理论,使数理统计学家和经济学家能够处理不确定性下的决策。

微积分代写

微积分,最初被称为无穷小微积分或 “无穷小的微积分”,是对连续变化的数学研究,就像几何学是对形状的研究,而代数是对算术运算的概括研究一样。

它有两个主要分支,微分和积分;微分涉及瞬时变化率和曲线的斜率,而积分涉及数量的累积,以及曲线下或曲线之间的面积。这两个分支通过微积分的基本定理相互联系,它们利用了无限序列和无限级数收敛到一个明确定义的极限的基本概念 。

计量经济学代写

什么是计量经济学?

计量经济学是统计学和数学模型的定量应用,使用数据来发展理论或测试经济学中的现有假设,并根据历史数据预测未来趋势。它对现实世界的数据进行统计试验,然后将结果与被测试的理论进行比较和对比。

根据你是对测试现有理论感兴趣,还是对利用现有数据在这些观察的基础上提出新的假设感兴趣,计量经济学可以细分为两大类:理论和应用。那些经常从事这种实践的人通常被称为计量经济学家。

MATLAB代写

MATLAB 是一种用于技术计算的高性能语言。它将计算、可视化和编程集成在一个易于使用的环境中,其中问题和解决方案以熟悉的数学符号表示。典型用途包括:数学和计算算法开发建模、仿真和原型制作数据分析、探索和可视化科学和工程图形应用程序开发,包括图形用户界面构建MATLAB 是一个交互式系统,其基本数据元素是一个不需要维度的数组。这使您可以解决许多技术计算问题,尤其是那些具有矩阵和向量公式的问题,而只需用 C 或 Fortran 等标量非交互式语言编写程序所需的时间的一小部分。MATLAB 名称代表矩阵实验室。MATLAB 最初的编写目的是提供对由 LINPACK 和 EISPACK 项目开发的矩阵软件的轻松访问,这两个项目共同代表了矩阵计算软件的最新技术。MATLAB 经过多年的发展,得到了许多用户的投入。在大学环境中,它是数学、工程和科学入门和高级课程的标准教学工具。在工业领域,MATLAB 是高效研究、开发和分析的首选工具。MATLAB 具有一系列称为工具箱的特定于应用程序的解决方案。对于大多数 MATLAB 用户来说非常重要,工具箱允许您学习和应用专业技术。工具箱是 MATLAB 函数(M 文件)的综合集合,可扩展 MATLAB 环境以解决特定类别的问题。可用工具箱的领域包括信号处理、控制系统、神经网络、模糊逻辑、小波、仿真等。