如果你也在 怎样代写优化方法Optimization这个学科遇到相关的难题,请随时右上角联系我们的24/7代写客服。优化方法Optimization又称优化)或数学编程是指从一组可用的备选方案中选择一个最佳元素。从计算机科学和工程到运筹学和经济学的所有定量学科中都会出现各种优化问题,几个世纪以来,数学界一直在关注解决方法的发展。

优化方法Optimization在最简单的情况下,优化问题包括通过系统地从一个允许的集合中选择输入值并计算出函数的值来最大化或最小化一个实际函数。将优化理论和技术推广到其他形式,构成了应用数学的一个大领域。更一般地说,优化包括在给定的域(或输入)中寻找一些目标函数的 “最佳可用 “值,包括各种不同类型的目标函数和不同类型的域。非凸全局优化的一般问题是NP-完备的,可接受的深层局部最小值是用遗传算法(GA)、粒子群优化(PSO)和模拟退火(SA)等启发式方法来寻找的。

my-assignmentexpert™ 优化方法Optimization作业代写,免费提交作业要求, 满意后付款,成绩80\%以下全额退款,安全省心无顾虑。专业硕 博写手团队,所有订单可靠准时,保证 100% 原创。my-assignmentexpert™, 最高质量的优化方法Optimization作业代写,服务覆盖北美、欧洲、澳洲等 国家。 在代写价格方面,考虑到同学们的经济条件,在保障代写质量的前提下,我们为客户提供最合理的价格。 由于统计Statistics作业种类很多,同时其中的大部分作业在字数上都没有具体要求,因此优化方法Optimization作业代写的价格不固定。通常在经济学专家查看完作业要求之后会给出报价。作业难度和截止日期对价格也有很大的影响。

想知道您作业确定的价格吗? 免费下单以相关学科的专家能了解具体的要求之后在1-3个小时就提出价格。专家的 报价比上列的价格能便宜好几倍。

my-assignmentexpert™ 为您的留学生涯保驾护航 在数学Mathematics作业代写方面已经树立了自己的口碑, 保证靠谱, 高质且原创的优化方法Optimization代写服务。我们的专家在数学Mathematics代写方面经验极为丰富,各种优化方法Optimization相关的作业也就用不着 说。

我们提供的优化方法Optimization及其相关学科的代写,服务范围广, 其中包括但不限于:

调和函数 harmonic function

椭圆方程 elliptic equation

抛物方程 Parabolic equation

双曲方程 Hyperbolic equation

非线性方法 nonlinear method

变分法 Calculus of Variations

几何分析 geometric analysis

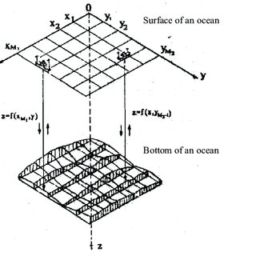

偏微分方程数值解 Numerical solution of partial differential equations

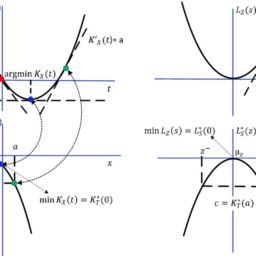

数学代写|优化方法作业代写Optimization代考|Minimum or Bounded Expected Costs

Consider the vector of (conditional) expected losses or costs

$$

\mathbf{F}(x)=\left(\begin{array}{c}

F_{0}(x) \

F_{1}(x) \

\vdots \

F_{m}(x)

\end{array}\right):=\left(\begin{array}{c}

E \gamma_{0}(e(a(\omega), x)) \

E \gamma_{1}(e(a(\omega), x)) \

\vdots \

E \gamma_{m}(e(a(\omega), x))

\end{array}\right), x \in \mathbb{R}^{r}

$$

where the (conditional) expectation “E” is taken with respect to the time history $\mathcal{A}=\mathcal{A}{t},\left(\mathcal{A}{j}\right) \subset \mathcal{A}_{0}$ up to a certain time point $t$ or stage $j$. A short definition of expectations is given in Section 2.1, for more details, see e.g. $[7,38,113]$.

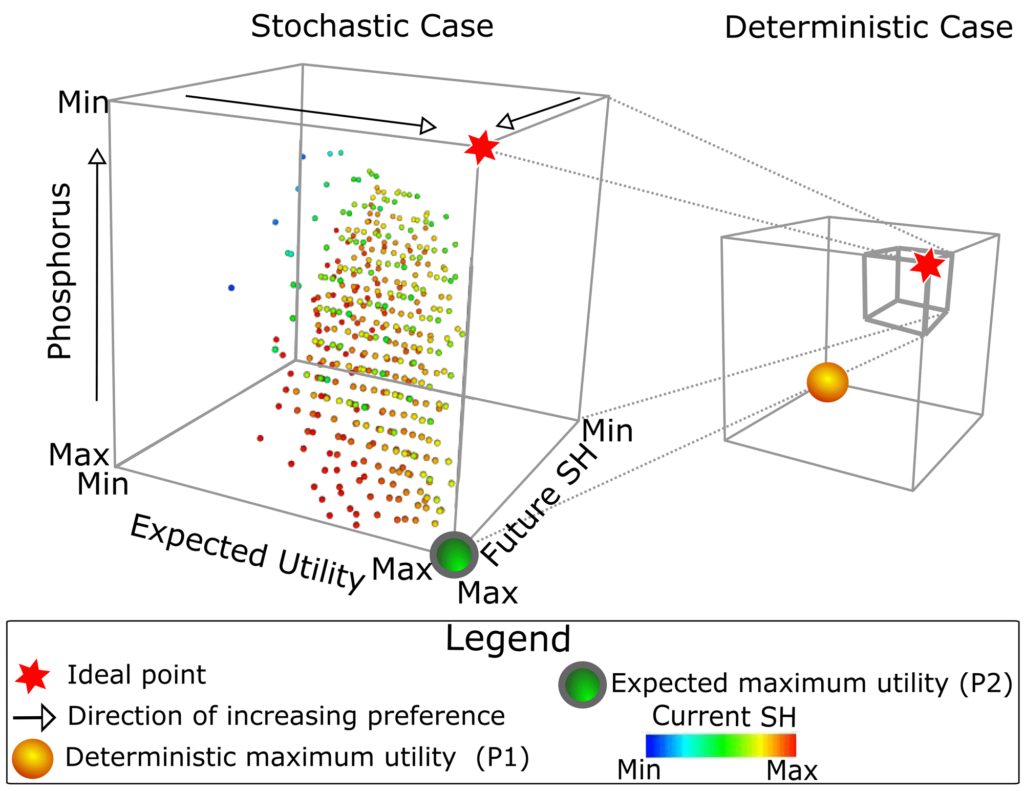

Having different expected cost or performance functions $F_{0}, F_{1}, \ldots, F_{m}$ to be minimized or bounded, as a basic deterministic substitute problem for (1.1a-d) with a random parameter vector $a=a(\omega)$ we may consider the multi-objective expected cost minimization problem

$$

” \min ” \mathbf{F}(x)

$$

s.t.

$x \in D_{0} .$

Obviously, a good compromise solution $x^{*}$ of this vector optimization problem should have at least one of the following properties [23,121]:

Definition $1.1$ a) $A$ vector $x^{0} \in D_{0}$ is called a functional-efficient or Pareto optimal solution of the vector optimization problem (1.6a,b) if there is no $x \in D_{0}$ such that

$$

F_{i}(x) \leq F_{i}\left(x^{0}\right), i=0,1, \ldots, m

$$

and

$$

F_{i_{0}}(x)<F_{i_{0}}\left(x^{0}\right) \text { for at least one } i_{0}, 0 \leq i_{0} \leq m .

$$

数学代写|优化方法作业代写Optimization代考|Minimum or Bounded Maximum Costs (Worst Case)

Instead of taking expectations, we may consider the worst case with respect to the cost variations caused by the random parameter vector $a=a(\omega)$. Hence, the random cost function

$$

\omega \rightarrow \gamma_{i}(e(a(\omega), x))

$$

is evaluated by means of

$$

F_{i}^{\text {sup }}(x):=\operatorname{ess} \sup \gamma_{i}(e(a(\omega), x)), i=0,1, \ldots, m .

$$

Here, ess sup (…) denotes the (conditional) essential supremum with respect to the random vector $a=a(\omega)$, given information $\mathcal{A}$, i.e. the infimum of the supremum of $(1.14 \mathrm{a})$ on sets $A \in \mathcal{A}{0}$ of (conditional) probability one, see e.g. [113]. Consequently, the vector function $\mathbf{F}=\mathbf{F}^{\text {sup }}(x)$ is then defined by $$ \mathbf{F}^{\sup }(x)=\left(\begin{array}{c} F{0}(x) \

F_{1}(x) \

\vdots \

F_{m}(x)

\end{array}\right):=\left(\begin{array}{c}

\operatorname{ess} \sup \gamma_{0}(e(a(\omega), x)) \

\operatorname{ess} \sup \gamma_{1}(e(a(\omega), x)) \

\vdots \

\operatorname{ess} \sup \gamma_{m}(e(a(\omega), x))

\end{array}\right)

$$

Working with the vector function $\mathbf{F}=\mathbf{F}^{\sup }(x)$, we have then the vector minimization problem

$$

\begin{array}{lc}

& ” \min ” \mathbf{F}^{\text {sup }}(x) \

\text { s.t. } & x \in D_{0} .

\end{array}

$$

By scalarization of $(1.16 \mathrm{a}, \mathrm{b})$ we obtain then again deterministic substitute problems for (1.1a-d) related to the substitute problem (1.6a,b) introduced in Section 1.2.1.

More details for the selection and solution of appropriate deterministic substitute problems for (1.1a-d) are given in the next sections.

优化方法代写

数学代写|优化方法作业代写OPTIMIZATION代考|MINIMUM OR BOUNDED EXPECTED COSTS

考虑向量C这nd一世吨一世这n一种l预期损失或成本

$$

\mathbf{F}(x)=\left(\begin{array}{c}

F_{0}(x) \

F_{1}(x) \

\vdots \

F_{m}(x)

\end{array}\right):=\left(\begin{array}{c}

E \gamma_{0}(e(a(\omega), x)) \

E \gamma_{1}(e(a(\omega), x)) \

\vdots \

E \gamma_{m}(e(a(\omega), x))

\end{array}\right), x \in \mathbb{R}^{r}

$$

具有不同的预期成本或性能功能F0,F1,…,F米被最小化或有界,作为一个基本的确定性替代问题1.1一种−d带有随机参数向量一种=一种(ω)我们可以考虑多目标期望成本最小化问题

”分钟”F(X)

英石

X∈D0.

显然,一个好的折衷方案X∗这个向量优化问题的至少应该具有以下性质之一23,121:

定义1.1一种)一种向量X0∈D0称为向量优化问题的功能有效或帕累托最优解1.6一种,b如果没有X∈D0这样

F一世(X)≤F一世(X0),一世=0,1,…,米

和

F一世0(X)<F一世0(X0) 对于至少一个 一世0,0≤一世0≤米.

数学代写|优化方法作业代写OPTIMIZATION代考|MINIMUM OR BOUNDED MAXIMUM COSTS 在这rs吨C一种s和

我们可以不考虑预期,而是考虑随机参数向量引起的成本变化的最坏情况一种=一种(ω). 因此,随机成本函数

ω→C一世(和(一种(ω),X))

是通过评估

$$

\omega \rightarrow \gamma_{i}(e(a(\omega), x))

$$

is evaluated by means of

$$

F_{i}^{\text {sup }}(x):=\operatorname{ess} \sup \gamma_{i}(e(a(\omega), x)), i=0,1, \ldots, m .

$$

Here, ess sup (…) denotes the (conditional) essential supremum with respect to the random vector $a=a(\omega)$, given information $\mathcal{A}$, i.e. the infimum of the supremum of $(1.14 \mathrm{a})$ on sets $A \in \mathcal{A}{0}$ of (conditional) probability one, see e.g. [113]. Consequently, the vector function $\mathbf{F}=\mathbf{F}^{\text {sup }}(x)$ is then defined by $$ \mathbf{F}^{\sup }(x)=\left(\begin{array}{c} F{0}(x) \

F_{1}(x) \

\vdots \

F_{m}(x)

\end{array}\right):=\left(\begin{array}{c}

\operatorname{ess} \sup \gamma_{0}(e(a(\omega), x)) \

\operatorname{ess} \sup \gamma_{1}(e(a(\omega), x)) \

\vdots \

\operatorname{ess} \sup \gamma_{m}(e(a(\omega), x))

\end{array}\right)

$$

Working with the vector function $\mathbf{F}=\mathbf{F}^{\sup }(x)$, we have then the vector minimization problem

$$

\begin{array}{lc}

& ” \min ” \mathbf{F}^{\text {sup }}(x) \

\text { s.t. } & x \in D_{0} .

\end{array}

$$

通过标量化(1.16一种,b)然后我们再次获得确定性替代问题1.1一种−d与替代问题有关1.6一种,b1.2.1 节介绍。

有关选择和解决适当确定性替代问题的更多详细信息1.1一种−d在下一节中给出。

数学代写|优化方法作业代写Optimization代考 请认准UprivateTA™. UprivateTA™为您的留学生涯保驾护航。