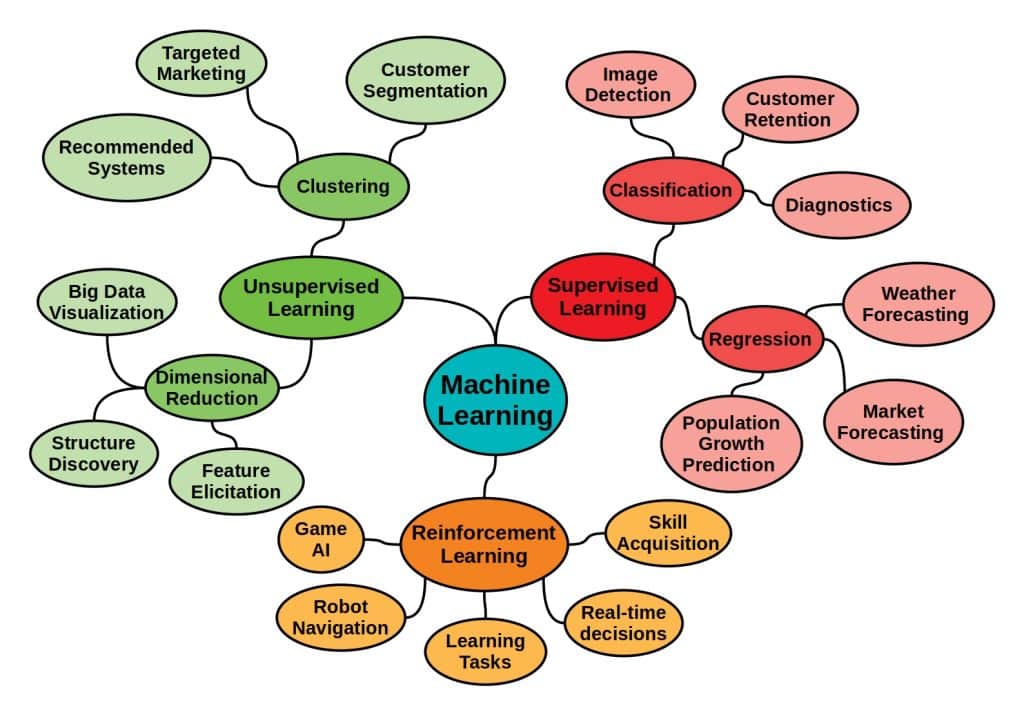

如果你也在 怎样代写机器学习Machine Learning COMP4702这个学科遇到相关的难题,请随时右上角联系我们的24/7代写客服。机器学习Machine Learning是一个致力于理解和建立 “学习 “方法的研究领域,也就是说,利用数据来提高某些任务的性能的方法。机器学习算法基于样本数据(称为训练数据)建立模型,以便在没有明确编程的情况下做出预测或决定。机器学习算法被广泛用于各种应用,如医学、电子邮件过滤、语音识别和计算机视觉,在这些应用中,开发传统算法来执行所需任务是困难的或不可行的。

机器学习Machine Learning程序可以在没有明确编程的情况下执行任务。它涉及到计算机从提供的数据中学习,从而执行某些任务。对于分配给计算机的简单任务,有可能通过编程算法告诉机器如何执行解决手头问题所需的所有步骤;就计算机而言,不需要学习。对于更高级的任务,由人类手动创建所需的算法可能是一个挑战。在实践中,帮助机器开发自己的算法,而不是让人类程序员指定每一个需要的步骤,可能会变得更加有效 。

机器学习Machine Learning代写,免费提交作业要求, 满意后付款,成绩80\%以下全额退款,安全省心无顾虑。专业硕 博写手团队,所有订单可靠准时,保证 100% 原创。 最高质量的机器学习Machine Learning作业代写,服务覆盖北美、欧洲、澳洲等 国家。 在代写价格方面,考虑到同学们的经济条件,在保障代写质量的前提下,我们为客户提供最合理的价格。 由于作业种类很多,同时其中的大部分作业在字数上都没有具体要求,因此机器学习Machine Learning作业代写的价格不固定。通常在专家查看完作业要求之后会给出报价。作业难度和截止日期对价格也有很大的影响。

同学们在留学期间,都对各式各样的作业考试很是头疼,如果你无从下手,不如考虑my-assignmentexpert™!

my-assignmentexpert™提供最专业的一站式服务:Essay代写,Dissertation代写,Assignment代写,Paper代写,Proposal代写,Proposal代写,Literature Review代写,Online Course,Exam代考等等。my-assignmentexpert™专注为留学生提供Essay代写服务,拥有各个专业的博硕教师团队帮您代写,免费修改及辅导,保证成果完成的效率和质量。同时有多家检测平台帐号,包括Turnitin高级账户,检测论文不会留痕,写好后检测修改,放心可靠,经得起任何考验!

想知道您作业确定的价格吗? 免费下单以相关学科的专家能了解具体的要求之后在1-3个小时就提出价格。专家的 报价比上列的价格能便宜好几倍。

我们在计算机Quantum computer代写方面已经树立了自己的口碑, 保证靠谱, 高质且原创的计算机Quantum computer代写服务。我们的专家在机器学习Machine Learning代写方面经验极为丰富,各种机器学习Machine Learning相关的作业也就用不着 说。

CS代写|机器学习代写Machine Learning代考|Brief History

We now proceed with a short overview of the development of machine learning. Machine learning is an inevitable product during the progress of artificial intelligence studies. Between the 1950s and early 1970s, artificial intelligence research was in the “reasoning age” when people thought a machine could get intelligence if it can do logical reasoning. Seminal works in that period include the Logic Theorist program developed by A. Newell and H. Simon and later on the General Problem Solving program. All of these works produced highly inspiring results at that time. For example, in 1952, the Logic Theorist program successfully proved 38 theorems in the famous book Principia Mathematica written by A. F. Whitehead and B. Russell. Later on, in 1963, it proved all of the 52 theorems, and people found the Proof of the Theorem $2.85$ was even more elegant than Whitehead and Russell’s. The research community recognized the importance of this line of work, and hence

A. Newell and H. Simon received the Turing Award in 1975.

However, as the research was advancing, people started to realize that having the ability of logical reasoning is still far away from enabling artificial intelligence. A group of researchers represented by E. A. Feigenbaum argued that machines must acquire knowledge in order to be intelligent. A new phase of development started in the mid of $1970 \mathrm{~s}$, where artificial intelligence research entered the so-called “knowledge age”. In this period, researchers developed a large number of expert systems with numerous successful applications in a wide range of domains. E. A. Feigenbaum, who is often regarded as the father of knowledge engineering, received the Turing Award in 1994. Nevertheless, researchers have soon reached the “Feigenbaum’s knowledge acquisition bottleneck”, that is, it is difficult to extract and summarize knowledge into a form that computers can learn. Therefore, some researchers decided to explore the possibility of letting machines learn knowledge by themselves!

CS代写|机器学习代写Machine Learning代考|Application Status

The past two decades have witnessed fast and significant advances in the collection, storage, transmission, and processing of data. Given that we have accumulated massive data covering all aspects of human life, effective and efficient methods for utilizing the data are urgently needed. Hence, it is not a surprise that machine learning has gained much attention since it provides solutions for unleashing the power of massive data.

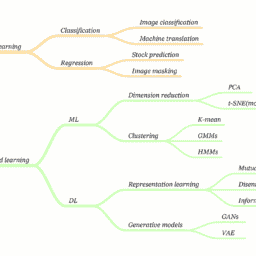

Nowadays, machine learning appears in different branches of computer science, such as multimedia, graphics, network communication, software engineering, and even architecture and chipset design. Machine learning has also become one of the most critical techniques in some “applied” areas, such as computer vision and natural language processing.

Machine learning also provides support for interdisciplinary research. For example, bioinformatics is a research field that aims to employ information technology to understand biological observations and patterns, and people are excited about the human genome project and genomic medicine. In bioinformatics, the whole process, from biological observations to pattern discovery, involves data collection, data management, data analytics, and simulations. Among these tasks, data analytics is where machine learning shines, and researchers have niques to bioinformatics.

In fact, the research methodology of science is shifting from “theory + experiment” to “theory $+$ experiment $+$ computation”, and people even use the term “data science”. The importance of machine learning is increasing since computing with data is the core of both data analytics and data science. If we list the most current and eye-catching computer science technologies, then machine learning must be one of them. In 2001, scientists from NASA-JPL published an article (Mjolsness and DeCoste 2001) in the Science magazine pointed out that machine learning is playing an increasingly important ogy development. In 2003, DARPA started the PAL project, which puts machine learning to the level of national security. We see that the importance of machine learning is recognized by both NASA and DARPA, who often promote the most cutting-edge technologies in the U.S.

机器学习代写

CS代写|机器学习代写Machine Learning代考|简史

现在我们对机器学习的发展进行一个简短的概述。机器学习是人工智能研究的必然产物。20世纪50年代至70年代初,人工智能研究处于“推理时代”,人们认为机器如果能进行逻辑推理,就能获得智能。这一时期的开创性工作包括A. Newell和H. Simon开发的逻辑理论家程序,以及后来的通用问题解决程序。所有这些工作都在当时产生了非常鼓舞人心的结果。例如,1952年,逻辑理论家计划成功证明了A. F. Whitehead和B. Russell所著的著名著作《数学原理》中的38个定理。后来,在1963年,它证明了所有的52个定理,人们发现定理的证明$2.85$甚至比Whitehead和Russell的还要优雅。研究界认识到这一行工作的重要性,因此

A。纽维尔和西蒙于1975年获得了图灵奖。然而,随着研究的深入,人们开始意识到,要使人工智能具备逻辑推理能力,还有很长的路要走。以e·A·费根鲍姆(E. A. Feigenbaum)为代表的一组研究人员认为,机器必须获得知识才能变得智能。$1970 \mathrm{~s}$中期开始了一个新的发展阶段,人工智能研究进入了所谓的“知识时代”。在这一时期,研究人员开发了大量的专家系统,在广泛的领域中有许多成功的应用。e·a·费根鲍姆(E. A. Feigenbaum)常被认为是知识工程之父,他于1994年获得了图灵奖。然而,研究人员很快就到达了“费根鲍姆的知识获取瓶颈”,即很难将知识提取和总结成计算机可以学习的形式。因此,一些研究人员决定探索让机器自己学习知识的可能性!

CS代写|机器学习代写Machine Learning代考|Application Status

.使用实例

在过去的二十年中,数据的收集、存储、传输和处理取得了快速而显著的进展。鉴于我们已经积累了大量的数据,涵盖了人类生活的各个方面,迫切需要有效和高效的方法来利用这些数据。因此,机器学习获得广泛关注并不奇怪,因为它为释放海量数据的力量提供了解决方案。如今,机器学习出现在计算机科学的不同分支中,如多媒体、图形学、网络通信、软件工程,甚至架构和芯片组设计。机器学习也已经成为一些“应用”领域中最关键的技术之一,如计算机视觉和自然语言处理

机器学习也为跨学科研究提供了支持。例如,生物信息学是一个旨在利用信息技术来理解生物观察和模式的研究领域,人们对人类基因组计划和基因组医学感到兴奋。在生物信息学中,从生物观察到模式发现的整个过程包括数据收集、数据管理、数据分析和模拟。在这些任务中,数据分析是机器学习的亮点,研究人员在生物信息学方面有专长

事实上,科学的研究方法论正在从“理论+实验”向“理论$+$实验$+$计算”转变,人们甚至使用“数据科学”一词。机器学习的重要性日益增加,因为数据计算是数据分析和数据科学的核心。如果我们列出当前最引人注目的计算机科学技术,那么机器学习一定是其中之一。2001年,NASA-JPL的科学家在《科学》杂志上发表了一篇文章(Mjolsness and DeCoste 2001),指出机器学习在科学发展中发挥着越来越重要的作用。2003年,DARPA启动了PAL项目,将机器学习提升到国家安全级别。我们看到,机器学习的重要性得到了NASA和DARPA的认可,他们经常推动美国最尖端的技术

CS代写|机器学习代写Machine Learning代考 请认准UprivateTA™. UprivateTA™为您的留学生涯保驾护航。

微观经济学代写

微观经济学是主流经济学的一个分支,研究个人和企业在做出有关稀缺资源分配的决策时的行为以及这些个人和企业之间的相互作用。my-assignmentexpert™ 为您的留学生涯保驾护航 在数学Mathematics作业代写方面已经树立了自己的口碑, 保证靠谱, 高质且原创的数学Mathematics代写服务。我们的专家在图论代写Graph Theory代写方面经验极为丰富,各种图论代写Graph Theory相关的作业也就用不着 说。

线性代数代写

线性代数是数学的一个分支,涉及线性方程,如:线性图,如:以及它们在向量空间和通过矩阵的表示。线性代数是几乎所有数学领域的核心。

博弈论代写

现代博弈论始于约翰-冯-诺伊曼(John von Neumann)提出的两人零和博弈中的混合策略均衡的观点及其证明。冯-诺依曼的原始证明使用了关于连续映射到紧凑凸集的布劳威尔定点定理,这成为博弈论和数学经济学的标准方法。在他的论文之后,1944年,他与奥斯卡-莫根斯特恩(Oskar Morgenstern)共同撰写了《游戏和经济行为理论》一书,该书考虑了几个参与者的合作游戏。这本书的第二版提供了预期效用的公理理论,使数理统计学家和经济学家能够处理不确定性下的决策。

微积分代写

微积分,最初被称为无穷小微积分或 “无穷小的微积分”,是对连续变化的数学研究,就像几何学是对形状的研究,而代数是对算术运算的概括研究一样。

它有两个主要分支,微分和积分;微分涉及瞬时变化率和曲线的斜率,而积分涉及数量的累积,以及曲线下或曲线之间的面积。这两个分支通过微积分的基本定理相互联系,它们利用了无限序列和无限级数收敛到一个明确定义的极限的基本概念 。

计量经济学代写

什么是计量经济学?

计量经济学是统计学和数学模型的定量应用,使用数据来发展理论或测试经济学中的现有假设,并根据历史数据预测未来趋势。它对现实世界的数据进行统计试验,然后将结果与被测试的理论进行比较和对比。

根据你是对测试现有理论感兴趣,还是对利用现有数据在这些观察的基础上提出新的假设感兴趣,计量经济学可以细分为两大类:理论和应用。那些经常从事这种实践的人通常被称为计量经济学家。

Matlab代写

MATLAB 是一种用于技术计算的高性能语言。它将计算、可视化和编程集成在一个易于使用的环境中,其中问题和解决方案以熟悉的数学符号表示。典型用途包括:数学和计算算法开发建模、仿真和原型制作数据分析、探索和可视化科学和工程图形应用程序开发,包括图形用户界面构建MATLAB 是一个交互式系统,其基本数据元素是一个不需要维度的数组。这使您可以解决许多技术计算问题,尤其是那些具有矩阵和向量公式的问题,而只需用 C 或 Fortran 等标量非交互式语言编写程序所需的时间的一小部分。MATLAB 名称代表矩阵实验室。MATLAB 最初的编写目的是提供对由 LINPACK 和 EISPACK 项目开发的矩阵软件的轻松访问,这两个项目共同代表了矩阵计算软件的最新技术。MATLAB 经过多年的发展,得到了许多用户的投入。在大学环境中,它是数学、工程和科学入门和高级课程的标准教学工具。在工业领域,MATLAB 是高效研究、开发和分析的首选工具。MATLAB 具有一系列称为工具箱的特定于应用程序的解决方案。对于大多数 MATLAB 用户来说非常重要,工具箱允许您学习和应用专业技术。工具箱是 MATLAB 函数(M 文件)的综合集合,可扩展 MATLAB 环境以解决特定类别的问题。可用工具箱的领域包括信号处理、控制系统、神经网络、模糊逻辑、小波、仿真等。