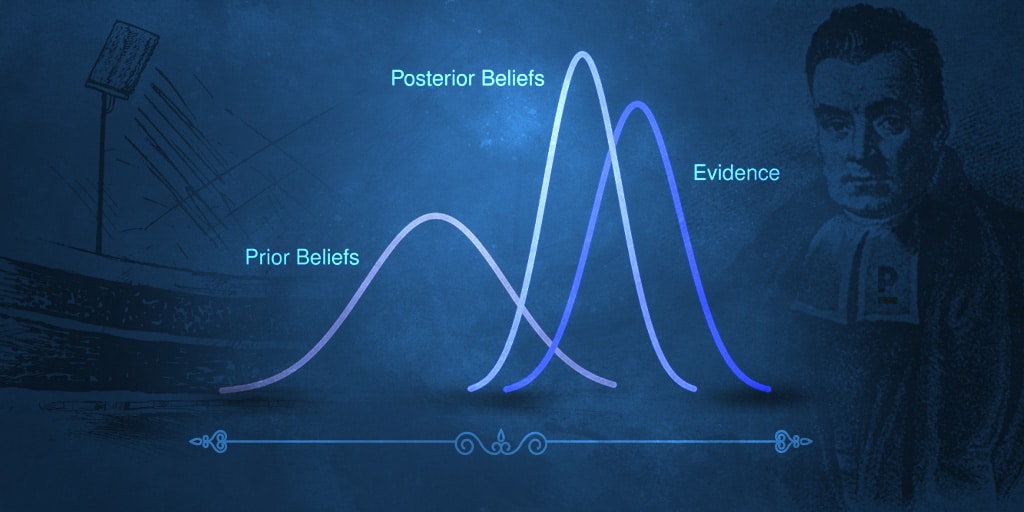

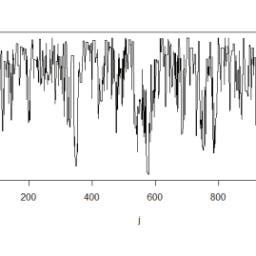

如果你也在 怎样代写贝叶斯分析Bayesian Analysis 这个学科遇到相关的难题,请随时右上角联系我们的24/7代写客服。贝叶斯分析Bayesian Analysis是一种统计范式,它使用概率陈述来回答关于未知参数的研究问题。

贝叶斯分析Bayesian Analysis的独特特征包括能够将先验信息纳入分析,将可信区间直观地解释为固定范围,其中参数已知属于预先指定的概率,以及将实际概率分配给任何感兴趣的假设的能力。贝叶斯推断使用后验分布来形成模型参数的各种总结,包括点估计,如后验均值、中位数、百分位数和称为可信区间的区间估计。此外,所有关于模型参数的统计检验都可以表示为基于估计的后验分布的概率陈述。

同学们在留学期间,都对各式各样的作业考试很是头疼,如果你无从下手,不如考虑my-assignmentexpert™!

my-assignmentexpert™提供最专业的一站式服务:Essay代写,Dissertation代写,Assignment代写,Paper代写,Proposal代写,Proposal代写,Literature Review代写,Online Course,Exam代考等等。my-assignmentexpert™专注为留学生提供Essay代写服务,拥有各个专业的博硕教师团队帮您代写,免费修改及辅导,保证成果完成的效率和质量。同时有多家检测平台帐号,包括Turnitin高级账户,检测论文不会留痕,写好后检测修改,放心可靠,经得起任何考验!

统计代写|贝叶斯分析代考Bayesian Analysis代写|Estimating a normal mean with known variance

The normal distribution is fundamental to most statistical modeling. The central limit theorem helps to justify using the normal likelihood in many statistical problems, as an approximation to a less analytically convenient actual likelihood. Also, as we shall see in later chapters, even when the normal distribution does not itself provide a good model fit, it can be useful as a component of a more complicated model involving $t$ or finite mixture distributions. For now, we simply work through the Bayesian results assuming the normal model is appropriate. We derive results first for a single data point and then for the general case of many data points.

Likelihood of one data point

As the simplest first case, consider a single scalar observation $y$ from a normal distribution parameterized by a mean $\theta$ and variance $\sigma^2$, where for this initial development we assume that $\sigma^2$ is known. The sampling distribution is

$$

p(y \mid \theta)=\frac{1}{\sqrt{2 \pi} \sigma} e^{-\frac{1}{2 \sigma^2}(y-\theta)^2} .

$$

Considered as a function of $\theta$, the likelihood is an exponential of a quadratic form in $\theta$, so the family of conjugate prior densities looks like

$$

p(\theta)=e^{A \theta^2+B \theta+C} .

$$

We parameterize this family as

$$

p(\theta) \propto \exp \left(-\frac{1}{2 \tau_0^2}\left(\theta-\mu_0\right)^2\right) ;

$$

that is, $\theta \sim \mathrm{N}\left(\mu_0, \tau_0^2\right)$, with hyperparameters $\mu_0$ and $\tau_0^2$. As usual in this preliminary development, we assume that the hyperparameters are known.

统计代写|贝叶斯分析代考Bayesian Analysis代写|Posterior predictive distribution

The posterior predictive distribution of a future observation, $\tilde{y}, p(\tilde{y} \mid y)$, can be calculated directly by integration, using (1.4):

$$

\begin{aligned}

p(\tilde{y} \mid y) & =\int p(\tilde{y} \mid \theta) p(\theta \mid y) d \theta \

& \propto \int \exp \left(-\frac{1}{2 \sigma^2}(\tilde{y}-\theta)^2\right) \exp \left(-\frac{1}{2 \tau_1^2}\left(\theta-\mu_1\right)^2\right) d \theta .

\end{aligned}

$$

The first line above holds because the distribution of the future observation, $\tilde{y}$, given $\theta$, does not depend on the past data, $y$. We can determine the distribution of $\tilde{y}$ more easily using the properties of the bivariate normal distribution. The product in the integrand is the exponential of a quadratic function of $(\tilde{y}, \theta)$; hence $\tilde{y}$ and $\theta$ have a joint normal posterior distribution, and so the marginal posterior distribution of $\tilde{y}$ is normal.

We can determine the mean and variance of the posterior predictive distribution using the knowledge from the posterior distribution that $\mathrm{E}(\tilde{y} \mid \theta)=\theta$ and $\operatorname{var}(\tilde{y} \mid \theta)=\sigma^2$, along with identities (2.7) and (2.8):

$$

\mathrm{E}(\tilde{y} \mid y)=\mathrm{E}(\mathrm{E}(\tilde{y} \mid \theta, y) \mid y)=\mathrm{E}(\theta \mid y)=\mu_1,

$$

and

$$

\begin{aligned}

\operatorname{var}(\tilde{y} \mid y) & =\mathrm{E}(\operatorname{var}(\tilde{y} \mid \theta, y) \mid y)+\operatorname{var}(\mathrm{E}(\tilde{y} \mid \theta, y) \mid y) \

& =\mathrm{E}\left(\sigma^2 \mid y\right)+\operatorname{var}(\theta \mid y) \

& =\sigma^2+\tau_1^2 .

\end{aligned}

$$

Thus, the posterior predictive distribution of $\tilde{y}$ has mean equal to the posterior mean of $\theta$ and two components of variance: the predictive variance $\sigma^2$ from the model and the variance $\tau_1^2$ due to posterior uncertainty in $\theta$.

贝叶斯分析代写

统计代写|贝叶斯分析代考Bayesian Analysis代写|Estimating a normal mean with known variance

正态分布是大多数统计建模的基础。中心极限定理有助于证明在许多统计问题中使用正态似然,作为分析上不太方便的实际似然的近似值。此外,正如我们将在后面的章节中看到的,即使正态分布本身不能提供良好的模型拟合,它也可以作为涉及$t$或有限混合分布的更复杂模型的组成部分。现在,我们假设正常模型是合适的,简单地处理贝叶斯结果。我们首先为单个数据点推导结果,然后为许多数据点的一般情况推导结果。

一个数据点的可能性

作为最简单的第一种情况,考虑由平均值$\theta$和方差$\sigma^2$参数化的正态分布中的单个标量观测$y$,对于这个初始开发,我们假设$\sigma^2$是已知的。抽样分布为

$$

p(y \mid \theta)=\frac{1}{\sqrt{2 \pi} \sigma} e^{-\frac{1}{2 \sigma^2}(y-\theta)^2} .

$$

作为$\theta$的函数考虑,可能性是$\theta$中二次形式的指数,因此共轭先验密度族看起来像

$$

p(\theta)=e^{A \theta^2+B \theta+C} .

$$

我们把这个族参数化为

$$

p(\theta) \propto \exp \left(-\frac{1}{2 \tau_0^2}\left(\theta-\mu_0\right)^2\right) ;

$$

即$\theta \sim \mathrm{N}\left(\mu_0, \tau_0^2\right)$,并带有超参数$\mu_0$和$\tau_0^2$。在这个初步开发中,我们通常假设超参数是已知的。

统计代写|贝叶斯分析代考Bayesian Analysis代写|Posterior predictive distribution

未来观测值$\tilde{y}, p(\tilde{y} \mid y)$的后验预测分布可以通过积分直接计算,使用式(1.4):

$$

\begin{aligned}

p(\tilde{y} \mid y) & =\int p(\tilde{y} \mid \theta) p(\theta \mid y) d \theta \

& \propto \int \exp \left(-\frac{1}{2 \sigma^2}(\tilde{y}-\theta)^2\right) \exp \left(-\frac{1}{2 \tau_1^2}\left(\theta-\mu_1\right)^2\right) d \theta .

\end{aligned}

$$

上面的第一行成立,因为在给定$\theta$的情况下,未来观测值$\tilde{y}$的分布不依赖于过去的数据$y$。利用二元正态分布的性质,我们可以更容易地确定$\tilde{y}$的分布。被积函数的乘积是二次函数$(\tilde{y}, \theta)$的指数;因此$\tilde{y}$和$\theta$具有联合正态后验分布,因此$\tilde{y}$的边际后验分布是正态的。

我们可以利用后验分布的知识($\mathrm{E}(\tilde{y} \mid \theta)=\theta$和$\operatorname{var}(\tilde{y} \mid \theta)=\sigma^2$)以及等式(2.7)和(2.8)来确定后验预测分布的均值和方差:

$$

\mathrm{E}(\tilde{y} \mid y)=\mathrm{E}(\mathrm{E}(\tilde{y} \mid \theta, y) \mid y)=\mathrm{E}(\theta \mid y)=\mu_1,

$$

和

$$

\begin{aligned}

\operatorname{var}(\tilde{y} \mid y) & =\mathrm{E}(\operatorname{var}(\tilde{y} \mid \theta, y) \mid y)+\operatorname{var}(\mathrm{E}(\tilde{y} \mid \theta, y) \mid y) \

& =\mathrm{E}\left(\sigma^2 \mid y\right)+\operatorname{var}(\theta \mid y) \

& =\sigma^2+\tau_1^2 .

\end{aligned}

$$

因此,$\tilde{y}$的后验预测分布具有均值等于$\theta$的后验均值和方差的两个组成部分:来自模型的预测方差$\sigma^2$和$\theta$中由于后验不确定性而产生的方差$\tau_1^2$。

统计代写|贝叶斯分析代考Bayesian Analysis代写 请认准exambang™. exambang™为您的留学生涯保驾护航。

微观经济学代写

微观经济学是主流经济学的一个分支,研究个人和企业在做出有关稀缺资源分配的决策时的行为以及这些个人和企业之间的相互作用。my-assignmentexpert™ 为您的留学生涯保驾护航 在数学Mathematics作业代写方面已经树立了自己的口碑, 保证靠谱, 高质且原创的数学Mathematics代写服务。我们的专家在图论代写Graph Theory代写方面经验极为丰富,各种图论代写Graph Theory相关的作业也就用不着 说。

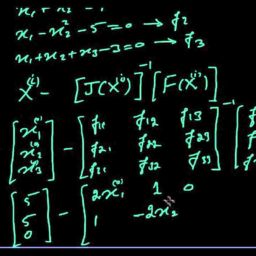

线性代数代写

线性代数是数学的一个分支,涉及线性方程,如:线性图,如:以及它们在向量空间和通过矩阵的表示。线性代数是几乎所有数学领域的核心。

博弈论代写

现代博弈论始于约翰-冯-诺伊曼(John von Neumann)提出的两人零和博弈中的混合策略均衡的观点及其证明。冯-诺依曼的原始证明使用了关于连续映射到紧凑凸集的布劳威尔定点定理,这成为博弈论和数学经济学的标准方法。在他的论文之后,1944年,他与奥斯卡-莫根斯特恩(Oskar Morgenstern)共同撰写了《游戏和经济行为理论》一书,该书考虑了几个参与者的合作游戏。这本书的第二版提供了预期效用的公理理论,使数理统计学家和经济学家能够处理不确定性下的决策。

微积分代写

微积分,最初被称为无穷小微积分或 “无穷小的微积分”,是对连续变化的数学研究,就像几何学是对形状的研究,而代数是对算术运算的概括研究一样。

它有两个主要分支,微分和积分;微分涉及瞬时变化率和曲线的斜率,而积分涉及数量的累积,以及曲线下或曲线之间的面积。这两个分支通过微积分的基本定理相互联系,它们利用了无限序列和无限级数收敛到一个明确定义的极限的基本概念 。

计量经济学代写

什么是计量经济学?

计量经济学是统计学和数学模型的定量应用,使用数据来发展理论或测试经济学中的现有假设,并根据历史数据预测未来趋势。它对现实世界的数据进行统计试验,然后将结果与被测试的理论进行比较和对比。

根据你是对测试现有理论感兴趣,还是对利用现有数据在这些观察的基础上提出新的假设感兴趣,计量经济学可以细分为两大类:理论和应用。那些经常从事这种实践的人通常被称为计量经济学家。

Matlab代写

MATLAB 是一种用于技术计算的高性能语言。它将计算、可视化和编程集成在一个易于使用的环境中,其中问题和解决方案以熟悉的数学符号表示。典型用途包括:数学和计算算法开发建模、仿真和原型制作数据分析、探索和可视化科学和工程图形应用程序开发,包括图形用户界面构建MATLAB 是一个交互式系统,其基本数据元素是一个不需要维度的数组。这使您可以解决许多技术计算问题,尤其是那些具有矩阵和向量公式的问题,而只需用 C 或 Fortran 等标量非交互式语言编写程序所需的时间的一小部分。MATLAB 名称代表矩阵实验室。MATLAB 最初的编写目的是提供对由 LINPACK 和 EISPACK 项目开发的矩阵软件的轻松访问,这两个项目共同代表了矩阵计算软件的最新技术。MATLAB 经过多年的发展,得到了许多用户的投入。在大学环境中,它是数学、工程和科学入门和高级课程的标准教学工具。在工业领域,MATLAB 是高效研究、开发和分析的首选工具。MATLAB 具有一系列称为工具箱的特定于应用程序的解决方案。对于大多数 MATLAB 用户来说非常重要,工具箱允许您学习和应用专业技术。工具箱是 MATLAB 函数(M 文件)的综合集合,可扩展 MATLAB 环境以解决特定类别的问题。可用工具箱的领域包括信号处理、控制系统、神经网络、模糊逻辑、小波、仿真等。