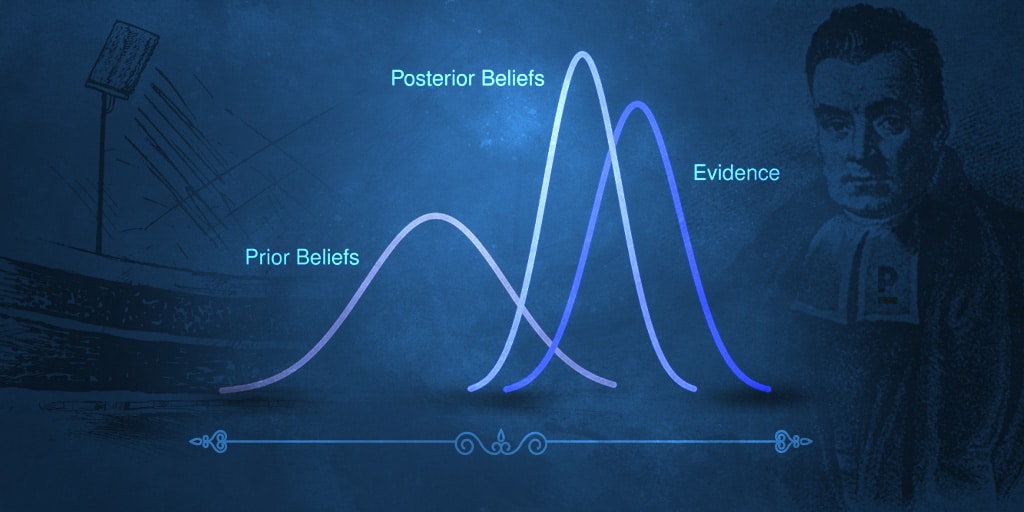

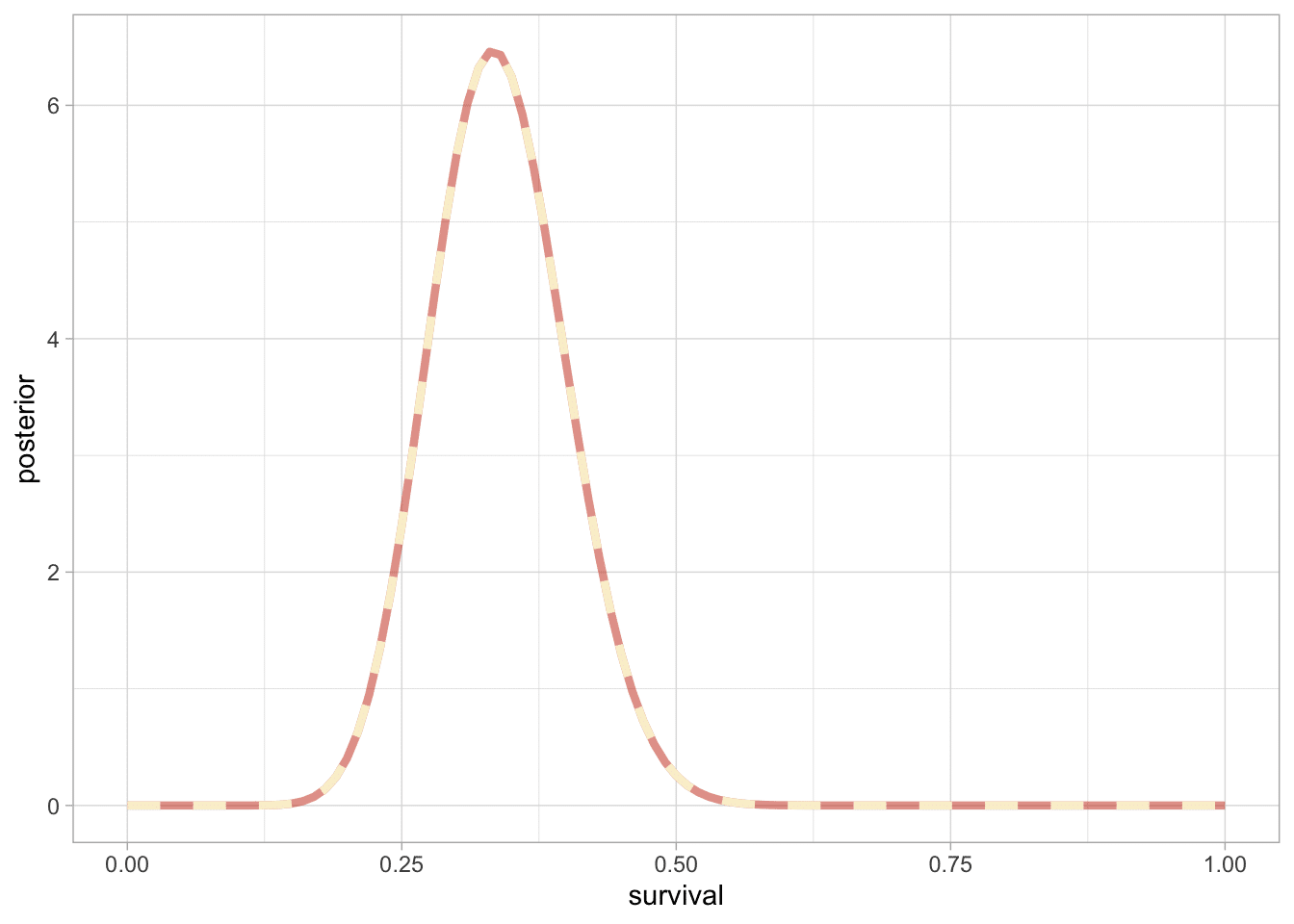

如果你也在 怎样代写贝叶斯分析Bayesian Analysis 这个学科遇到相关的难题,请随时右上角联系我们的24/7代写客服。贝叶斯分析Bayesian Analysis一种统计推断方法(以英国数学家托马斯-贝叶斯命名),它允许人们将关于人口参数的先验信息与样本中包含的信息证据相结合,以指导统计推断过程。首先指定一个感兴趣的参数的先验概率分布。然后通过应用贝叶斯定理获得并结合证据,为参数提供一个后验概率分布。后验分布为有关该参数的统计推断提供了基础。

贝叶斯分析Bayesian Analysis自1763年以来,我们现在所知道的贝叶斯统计学并没有一个明确的运行。尽管贝叶斯的方法被拉普拉斯和当时其他领先的概率论者热情地接受,但在19世纪却陷入了不光彩的境地,因为他们还不知道如何正确处理先验概率。20世纪上半叶,一种完全不同的理论得到了发展,现在称为频繁主义统计学。但贝叶斯思想的火焰被少数思想家保持着,如意大利的布鲁诺-德-菲内蒂和英国的哈罗德-杰弗里斯。现代贝叶斯运动开始于20世纪下半叶,由美国的Jimmy Savage和英国的Dennis Lindley带头,但贝叶斯推断仍然极难实现,直到20世纪80年代末和90年代初,强大的计算机开始广泛使用,新的计算方法被开发出来。随后,人们对贝叶斯统计的兴趣大增,不仅导致了贝叶斯方法论的广泛研究,也导致了使用贝叶斯方法来解决天体物理学、天气预报、医疗保健政策和刑事司法等不同应用领域的迫切问题。

同学们在留学期间,都对各式各样的作业考试很是头疼,如果你无从下手,不如考虑my-assignmentexpert™!

my-assignmentexpert™提供最专业的一站式服务:Essay代写,Dissertation代写,Assignment代写,Paper代写,Proposal代写,Proposal代写,Literature Review代写,Online Course,Exam代考等等。my-assignmentexpert™专注为留学生提供Essay代写服务,拥有各个专业的博硕教师团队帮您代写,免费修改及辅导,保证成果完成的效率和质量。同时有多家检测平台帐号,包括Turnitin高级账户,检测论文不会留痕,写好后检测修改,放心可靠,经得起任何考验!

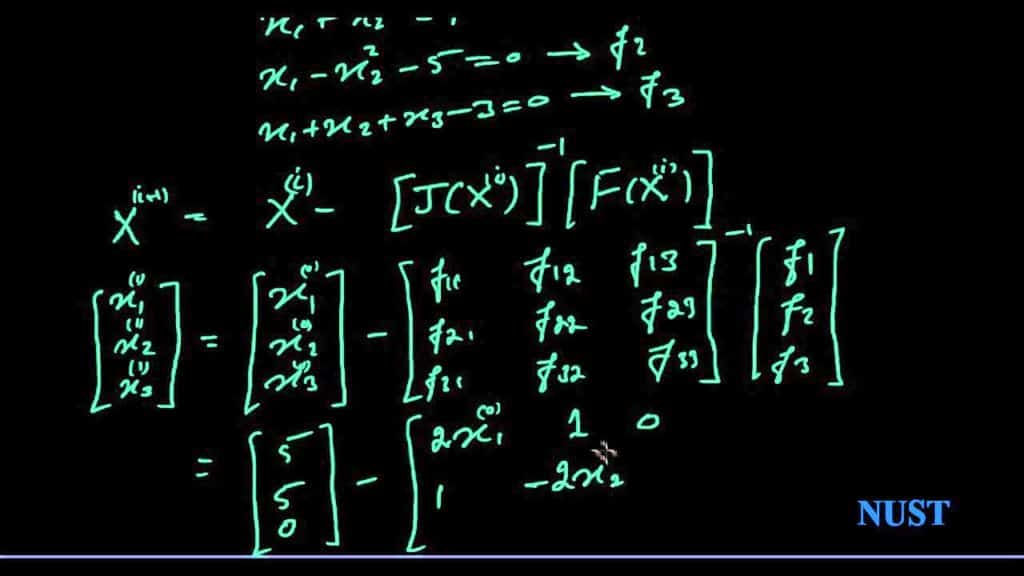

统计代写|贝叶斯分析代考Bayesian Analysis代写|The multivariate Newton-Raphson algorithm

The Newton-Raphson algorithm can also be used to solve several equations simultaneously, say

$$

g_k\left(x_1, \ldots, x_K\right)=0, k=1, \ldots, K \text {. }

$$

Let: $x=\left(\begin{array}{c}x_1 \ \vdots \ x_K\end{array}\right), g(x)=\left(\begin{array}{c}g_1(x) \ \vdots \ g_K(x)\end{array}\right), 0=\left(\begin{array}{c}0 \ \vdots \ 0\end{array}\right)$ (a column vector of length $K$ ).

Then the system of $K$ equations may be expressed as

$$

g(x)=0

$$

and the NR algorithm involves iterating according to

$$

x^{(j+1)}=x^{(j)}-g^{\prime}\left(x^{(j)}\right)^{-1} g\left(x^{(j)}\right),

$$

where: $x^{(j)}=\left(\begin{array}{c}x_1^{(j)} \ \vdots \ x_K^{(j)}\end{array}\right)$ is the value of $x$ at the $j$ th iteration

$$

\begin{aligned}

& x^{(j+1)}=\left(\begin{array}{c}

x_1^{(j+1)} \

\vdots \

x_K^{(j+1)}

\end{array}\right), \quad g\left(x^{(j)}\right)=\left(\begin{array}{c}

g_1\left(x^{(j)}\right) \

\vdots \

g_K\left(x^{(j)}\right)

\end{array}\right)=\left[\left.\begin{array}{c}

g_1(x) \

\vdots \

g_K(x)

\end{array}\right|{x=x^{(j)}}\right] \ & g^{\prime}\left(x^{(j)}\right)=\left[\left.g^{\prime}(x)\right|{x=x^{(j)}}\right] \

& g^{\prime}(x)=\left(\begin{array}{c}

\partial g_1(x) / \partial x^T \

\vdots \

\partial g_K(x) / \partial x^T

\end{array}\right)=\left(\begin{array}{ccc}

\partial g_1(x) / \partial x_1 & \cdots & \partial g_1(x) / \partial x_K \

\vdots & \ddots & \vdots \

\partial g_K(x) / \partial x_1 & \cdots & \partial g_K(x) / \partial x_K

\end{array}\right)

\end{aligned}

$$

统计代写|贝叶斯分析代考Bayesian Analysis代写|The Expectation-Maximisation (EM) algorithm

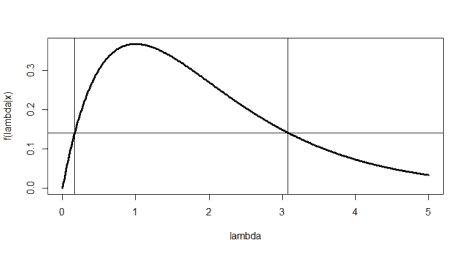

We have shown how the Newton-Raphson algorithm for solving $g(x)=0$ numerically can be useful for finding the posterior median and the HPDR. That algorithm can also be used for finding the posterior mode, when this is the solution of

$$

\frac{\partial f(\theta \mid y)}{\partial \theta}=0

$$

or equivalently

$$

\frac{\partial \log f(\theta \mid y)}{\partial \theta}=0

$$

In some situations, finding the posterior mode either analytically or via the NR algorithm may be problematic because the posterior density $f(\theta \mid y)$ has a very complicated form. In that case, one may consider applying the Expectation-Maximisation (EM) algorithm .

This algorithm first requires the specification (i.e. definition by the user) of some suitable latent data, which we will denote by $z$, and then the application of the following two steps iteratively until convergence.

Note: The choice of the latent data $z$ will depend on the particular application.

Step I. The Expectation Step (E-Step)

Determine the $Q$-function, defined as

$$

\begin{aligned}

Q_j(\theta) & =E_z\left{\log f(\theta \mid y, z) \mid y, \theta_j\right} \

& =\int \log f(\theta \mid y, z) f\left(z \mid y, \theta_j\right) d z,

\end{aligned}

$$

or, in words, as

the expectation of the log-augmented posterior density with respect to the distribution of the latent data given the observed data and current parameter estimates.

Step 2. The Maximisation Step (M-Step)

Find the value of $\theta$ which maximises the Q-function, for example using the Newton-Raphson algorithm.

This value becomes the current parameter estimate in the next iteration.

Note 1: For mathematical convenience, the Q-function may also be defined as at (4.3) but plus and/or multiplied by any constants which do not depend on the parameter $\theta$. This extended definition allows us to ignore terms which have no impact on the final results. If (4.3) is multiplied by a negative constant, the resulting Q-function should be minimised at Step 2 rather than maximised.

Note 2: If there is a choice between using the NR algorithm or the EM algorithm, one should consider the fact that the EM algorithm is slower to converge but far more stable. In fact, under certain regularity conditions, the EM algorithm is guaranteed to move closer to the required solution at each iteration. By contrast, the $\mathrm{NR}$ algorithm may not converge at all if started at a value far away from the required solution. Thus, one plausible strategy is to use the EM algorithm to obtain an approximate solution which is sufficiently close to the correct answer, and then to obtain a very high precision using just a few iterations of the NR algorithm.

贝叶斯分析代写

统计代写|贝叶斯分析代考Bayesian Analysis代写|The multivariate Newton-Raphson algorithm

Newton-Raphson算法也可用于同时求解多个方程,例如

$$

g_k\left(x_1, \ldots, x_K\right)=0, k=1, \ldots, K \text {. }

$$

设:$x=\left(\begin{array}{c}x_1 \ \vdots \ x_K\end{array}\right), g(x)=\left(\begin{array}{c}g_1(x) \ \vdots \ g_K(x)\end{array}\right), 0=\left(\begin{array}{c}0 \ \vdots \ 0\end{array}\right)$(长度为$K$的列向量)。

则$K$方程组可表示为

$$

g(x)=0

$$

, NR算法根据

$$

x^{(j+1)}=x^{(j)}-g^{\prime}\left(x^{(j)}\right)^{-1} g\left(x^{(j)}\right),

$$

进行迭代,其中$x^{(j)}=\left(\begin{array}{c}x_1^{(j)} \ \vdots \ x_K^{(j)}\end{array}\right)$为$j$次迭代时$x$的值

$$

\begin{aligned}

& x^{(j+1)}=\left(\begin{array}{c}

x_1^{(j+1)} \

\vdots \

x_K^{(j+1)}

\end{array}\right), \quad g\left(x^{(j)}\right)=\left(\begin{array}{c}

g_1\left(x^{(j)}\right) \

\vdots \

g_K\left(x^{(j)}\right)

\end{array}\right)=\left[\left.\begin{array}{c}

g_1(x) \

\vdots \

g_K(x)

\end{array}\right|{x=x^{(j)}}\right] \ & g^{\prime}\left(x^{(j)}\right)=\left[\left.g^{\prime}(x)\right|{x=x^{(j)}}\right] \

& g^{\prime}(x)=\left(\begin{array}{c}

\partial g_1(x) / \partial x^T \

\vdots \

\partial g_K(x) / \partial x^T

\end{array}\right)=\left(\begin{array}{ccc}

\partial g_1(x) / \partial x_1 & \cdots & \partial g_1(x) / \partial x_K \

\vdots & \ddots & \vdots \

\partial g_K(x) / \partial x_1 & \cdots & \partial g_K(x) / \partial x_K

\end{array}\right)

\end{aligned}

$$

统计代写|贝叶斯分析代考Bayesian Analysis代写|The Expectation-Maximisation (EM) algorithm

我们已经展示了如何用Newton-Raphson算法在数值上求解$g(x)=0$对于找到后中位数和HPDR是有用的。该算法也可以用于寻找后验模式,当这是

$$

\frac{\partial f(\theta \mid y)}{\partial \theta}=0

$$

或等价的

$$

\frac{\partial \log f(\theta \mid y)}{\partial \theta}=0

$$

在某些情况下,通过解析或通过NR算法寻找后验模式可能会有问题,因为后验密度$f(\theta \mid y)$具有非常复杂的形式。在这种情况下,可以考虑应用期望最大化(EM)算法。

该算法首先需要规范(即由用户定义)一些合适的潜在数据,我们将用$z$表示,然后迭代地应用以下两个步骤,直到收敛。

注意:隐数据$z$的选择将取决于特定的应用程序。

步骤1 .期望步骤(E-Step)

确定$Q$ -函数,定义为

$$

\begin{aligned}

Q_j(\theta) & =E_z\left{\log f(\theta \mid y, z) \mid y, \theta_j\right} \

& =\int \log f(\theta \mid y, z) f\left(z \mid y, \theta_j\right) d z,

\end{aligned}

$$

,或者,换句话说,为

在给定观测数据和当前参数估计的情况下,对数增强后验密度相对于潜在数据分布的期望。

步骤2。最大化步骤(M-Step)

找到使q函数最大化的$\theta$值,例如使用Newton-Raphson算法。

该值将成为下一次迭代中的当前参数估计。

注1:为了数学上的方便,q函数也可以定义为(4.3),但加上和/或乘以任何不依赖于参数$\theta$的常数。这个扩展的定义允许我们忽略对最终结果没有影响的项。如果(4.3)乘以一个负常数,得到的q函数应该在步骤2中最小化,而不是最大化。

注2:如果在使用NR算法或EM算法之间进行选择,则应考虑EM算法收敛速度较慢但更稳定的事实。实际上,在一定的正则性条件下,EM算法在每次迭代中都保证向所需解靠拢。相比之下,如果从远离所需解的值开始,$\mathrm{NR}$算法可能根本不会收敛。因此,一个合理的策略是使用EM算法获得一个足够接近正确答案的近似解,然后使用NR算法的几次迭代获得非常高的精度。

统计代写|贝叶斯分析代考Bayesian Analysis代写 请认准exambang™. exambang™为您的留学生涯保驾护航。

微观经济学代写

微观经济学是主流经济学的一个分支,研究个人和企业在做出有关稀缺资源分配的决策时的行为以及这些个人和企业之间的相互作用。my-assignmentexpert™ 为您的留学生涯保驾护航 在数学Mathematics作业代写方面已经树立了自己的口碑, 保证靠谱, 高质且原创的数学Mathematics代写服务。我们的专家在图论代写Graph Theory代写方面经验极为丰富,各种图论代写Graph Theory相关的作业也就用不着 说。

线性代数代写

线性代数是数学的一个分支,涉及线性方程,如:线性图,如:以及它们在向量空间和通过矩阵的表示。线性代数是几乎所有数学领域的核心。

博弈论代写

现代博弈论始于约翰-冯-诺伊曼(John von Neumann)提出的两人零和博弈中的混合策略均衡的观点及其证明。冯-诺依曼的原始证明使用了关于连续映射到紧凑凸集的布劳威尔定点定理,这成为博弈论和数学经济学的标准方法。在他的论文之后,1944年,他与奥斯卡-莫根斯特恩(Oskar Morgenstern)共同撰写了《游戏和经济行为理论》一书,该书考虑了几个参与者的合作游戏。这本书的第二版提供了预期效用的公理理论,使数理统计学家和经济学家能够处理不确定性下的决策。

微积分代写

微积分,最初被称为无穷小微积分或 “无穷小的微积分”,是对连续变化的数学研究,就像几何学是对形状的研究,而代数是对算术运算的概括研究一样。

它有两个主要分支,微分和积分;微分涉及瞬时变化率和曲线的斜率,而积分涉及数量的累积,以及曲线下或曲线之间的面积。这两个分支通过微积分的基本定理相互联系,它们利用了无限序列和无限级数收敛到一个明确定义的极限的基本概念 。

计量经济学代写

什么是计量经济学?

计量经济学是统计学和数学模型的定量应用,使用数据来发展理论或测试经济学中的现有假设,并根据历史数据预测未来趋势。它对现实世界的数据进行统计试验,然后将结果与被测试的理论进行比较和对比。

根据你是对测试现有理论感兴趣,还是对利用现有数据在这些观察的基础上提出新的假设感兴趣,计量经济学可以细分为两大类:理论和应用。那些经常从事这种实践的人通常被称为计量经济学家。

Matlab代写

MATLAB 是一种用于技术计算的高性能语言。它将计算、可视化和编程集成在一个易于使用的环境中,其中问题和解决方案以熟悉的数学符号表示。典型用途包括:数学和计算算法开发建模、仿真和原型制作数据分析、探索和可视化科学和工程图形应用程序开发,包括图形用户界面构建MATLAB 是一个交互式系统,其基本数据元素是一个不需要维度的数组。这使您可以解决许多技术计算问题,尤其是那些具有矩阵和向量公式的问题,而只需用 C 或 Fortran 等标量非交互式语言编写程序所需的时间的一小部分。MATLAB 名称代表矩阵实验室。MATLAB 最初的编写目的是提供对由 LINPACK 和 EISPACK 项目开发的矩阵软件的轻松访问,这两个项目共同代表了矩阵计算软件的最新技术。MATLAB 经过多年的发展,得到了许多用户的投入。在大学环境中,它是数学、工程和科学入门和高级课程的标准教学工具。在工业领域,MATLAB 是高效研究、开发和分析的首选工具。MATLAB 具有一系列称为工具箱的特定于应用程序的解决方案。对于大多数 MATLAB 用户来说非常重要,工具箱允许您学习和应用专业技术。工具箱是 MATLAB 函数(M 文件)的综合集合,可扩展 MATLAB 环境以解决特定类别的问题。可用工具箱的领域包括信号处理、控制系统、神经网络、模糊逻辑、小波、仿真等。