如果你也在 怎样代写凸分析Convex Analysis这个学科遇到相关的难题,请随时右上角联系我们的24/7代写客服。凸分析Convex Analysis是数学的一个分支,专门研究凸函数和凸集的属性,通常应用于凸最小化,这是优化理论的一个子领域。

my-assignmentexpert™ 凸分析Convex Analysis作业代写,免费提交作业要求, 满意后付款,成绩80\%以下全额退款,安全省心无顾虑。专业硕 博写手团队,所有订单可靠准时,保证 100% 原创。my-assignmentexpert™, 最高质量的凸分析Convex Analysis作业代写,服务覆盖北美、欧洲、澳洲等 国家。 在代写价格方面,考虑到同学们的经济条件,在保障代写质量的前提下,我们为客户提供最合理的价格。 由于统计Statistics作业种类很多,同时其中的大部分作业在字数上都没有具体要求,因此凸分析Convex Analysis作业代写的价格不固定。通常在经济学专家查看完作业要求之后会给出报价。作业难度和截止日期对价格也有很大的影响。

想知道您作业确定的价格吗? 免费下单以相关学科的专家能了解具体的要求之后在1-3个小时就提出价格。专家的 报价比上列的价格能便宜好几倍。

my-assignmentexpert™ 为您的留学生涯保驾护航 在数学mathematics作业代写方面已经树立了自己的口碑, 保证靠谱, 高质且原创的凸分析Convex Analysis作业代写代写服务。我们的专家在数学mathematics代写方面经验极为丰富,各种凸分析Convex Analysis相关的作业也就用不着 说。

我们提供的凸分析Convex Analysis及其相关学科的代写,服务范围广, 其中包括但不限于:、

- 优化理论 optimization theory

- 变分法 Calculus of variations

- 最优控制理论 Optimal control

- 动态规划 Dynamic programming

- 鲁棒优化 Robust optimization

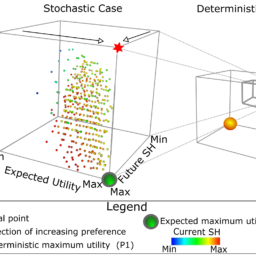

- 随机优化 Stochastic programming

- 组合优化 Combinatorial optimization

数学代考|凸分析作业代写Convex Analysis代考|Generalized Derivatives

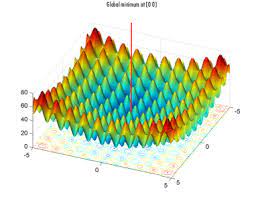

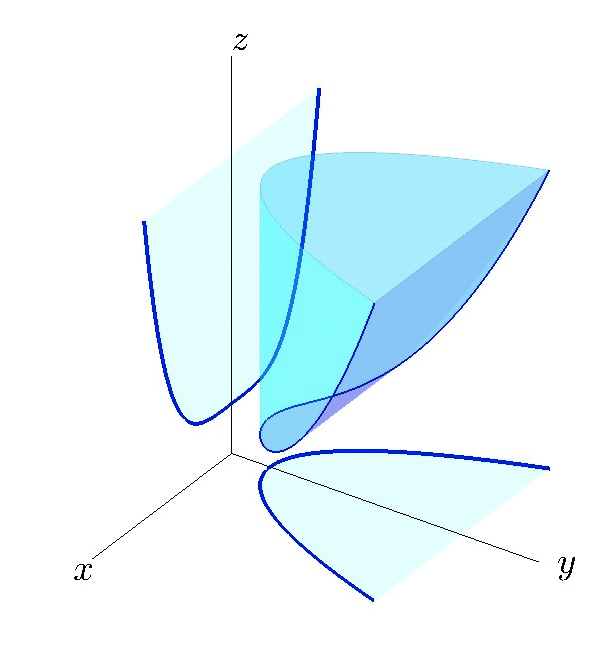

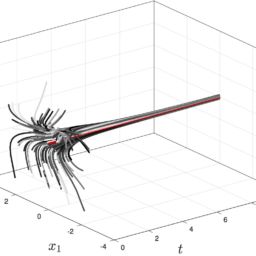

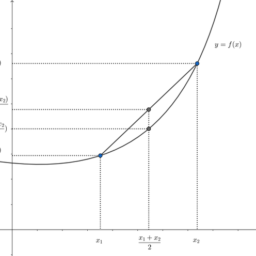

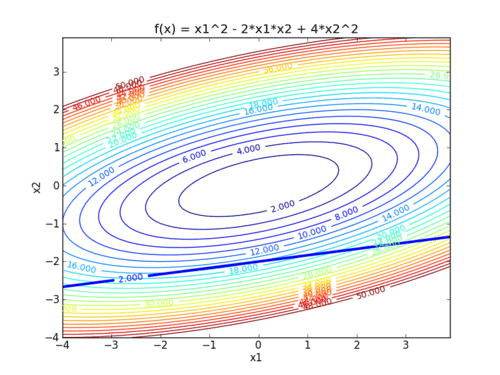

From the perspective of optimization, the subdifferential $\partial f(\cdot)$ of a convex function $f$ has many of the useful properties of the derivative. Some examples: it gives the necessary optimality condition $0 \in \partial f(x)$ when the point $x$ is a (local) minimizer (Proposition 3.1.5); it reduces to $\{\nabla f(x)\}$ when $f$ is differentiable at $x$ (Corollary $3.1 .10$ ); and it often satisfies certain calculus rules such as $\partial(f+g)(x)=\partial f(x)+\partial g(x)$ (Theorem 3.3.5). For a variety of reasons, if the function $f$ is not convex, the subdifferential $\partial f(\cdot)$ is not a particularly helpful idea. This makes it very tempting to look for definitions of the subdifferential for a nonconvex function. In this section we outline some examples; the most appropriate choice often depends on context.

For a convex function $f: \mathbf{E} \rightarrow(\infty,+\infty]$ with $x$ in $\operatorname{dom} f$, we can characterize the subdifferential via the directional derivative: $\phi \in \partial f(x)$ if and only if $\langle\phi, \cdot\rangle \leq f^{\prime}(x ; \cdot)$ (Proposition 3.1.6). A natural approach is therefore to generalize the directional derivative. Henceforth in this section we make the simplifying assumption that the real function $f$ (a real-valued function defined on some subset of $\mathbf{E}$ ) is locally Lipschitz around the point $x$ in $\mathbf{E}$.

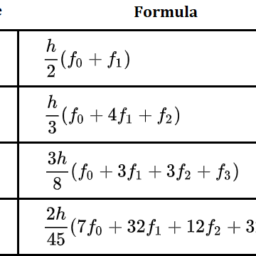

Partly motivated by the development of optimality conditions, a simple first try is the Dini directional derivative:

$$

f^{-}(x ; h)=\liminf _{t \downarrow 0} \frac{f(x+t h)-f(x)}{t} .

$$

数学代考|凸分析作业代写Convex Analysis代考|Regularity and Strict Differentiability

We have outlined in Section $2.3$ and Section $3.2$ two very distinct versions of the necessary optimality conditions in constrained optimization. The first, culminating in the Karush-Kuhn-Tucker conditions (2.3.8), relied on Gâteaux differentiability, while the second, leading to the Lagrangian necessary conditions (3.2.8), used convexity. A primary aim of the nonsmooth theory of this chapter is to unify these types of results; in this section we show how this is possible.

A principal feature of the Michel-Penot subdifferential is that it coincides with the Gâteaux derivative when this exists.

数学代考|凸分析作业代写Convex Analysis代考|Metric Regularity and the Limiting Subdifferential

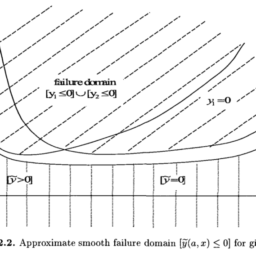

In Section $7.1$ we presented a convenient test for the weak metric regularity of a function at a point in terms of the surjectivity of its strict derivative there (Theorem 7.1.5). This test, while adequate for most of our purposes, can be richly refined using the limiting subdifferential.

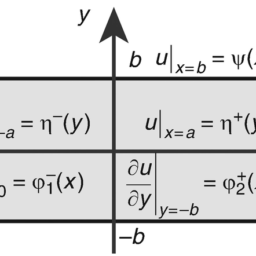

As before, we consider an open set $U \subset \mathbf{E}$, a Euclidean space $\mathbf{Y}$, a closed set $S \subset U$, and a function $h: U \rightarrow \mathbf{Y}$ which we assume throughout this section is locally Lipschitz. We begin with the full definition of metric regularity, strengthening the notion of Section 7.1. We say $h$ is metrically regular on $S$ at the point $x$ in $S$ if there is a real constant $k$ such that the estimate

$$

d_{S \cap h^{-1}(y)}(z) \leq k\|h(z)-y\|

$$

holds for all points $z$ in $S$ close to $x$ and all vectors $y$ in $\mathbf{Y}$ close to $h(x)$. (Before we only required this to be true when $y=h(x)$.)

数学代考|凸分析作业代写CONVEX ANALYSIS代考|GENERALIZED DERIVATIVES

从优化的角度来看,次微分∂F(⋅)凸函数的F具有衍生的许多有用特性。一些例子:它给出了必要的最优性条件0∈∂F(X)当点X是一个一世这C一种一世最小化器磷r这p这s一世吨一世这n3.1.5; 它减少到{∇F(X)}什么时候F可微分于X C这r这一世一世一种r是$3.1.10$; 它通常满足某些微积分规则,例如∂(F+G)(X)=∂F(X)+∂G(X) 吨H和这r和米3.3.5. 由于各种原因,如果函数F不是凸的,次微分∂F(⋅)不是一个特别有用的想法。这使得寻找非凸函数的次微分定义变得非常诱人。在本节中,我们概述了一些示例;最合适的选择通常取决于上下文。

对于凸函数F:和→(∞,+∞]和X在判断F,我们可以通过方向导数来表征次微分:φ∈∂F(X)当且仅当⟨φ,⋅⟩≤F′(X;⋅) 磷r这p这s一世吨一世这n3.1.6. 因此,一种自然的方法是推广方向导数。此后在本节中,我们做出简化假设,即实函数F 一种r和一种一世−v一种一世你和dF你nC吨一世这nd和F一世n和d这ns这米和s你bs和吨这F$和$在该点附近是局部 LipschitzX在和.

部分受优化条件发展的推动,一个简单的第一次尝试是 Dini 方向导数:

F−(X;H)=林inf吨↓0F(X+吨H)−F(X)吨.

数学代考|凸分析作业代写CONVEX ANALYSIS代考|REGULARITY AND STRICT DIFFERENTIABILITY

我们已经在第2.3和部分3.2约束优化中必要最优性条件的两个非常不同的版本。第一个,在 Karush-Kuhn-Tucker 条件下达到高潮2.3.8, 依赖于 Gâteaux 可微性, 而第二个, 导致拉格朗日必要条件3.2.8, 使用凸度。本章非光滑理论的主要目的是统一这些类型的结果。在本节中,我们将展示这是如何实现的。

Michel-Penot 次微分的一个主要特征是,当它存在时,它与 Gâteaux 导数一致。

数学代考|凸分析作业代写CONVEX ANALYSIS代考|METRIC REGULARITY AND THE LIMITING SUBDIFFERENTIAL

在部分7.1我们根据其严格导数的满射性,对函数在某点的弱度量规律性提出了一个方便的测试吨H和这r和米7.1.5. 这个测试,虽然足以满足我们的大多数目的,但可以使用极限次微分进行丰富的细化。

和以前一样,我们考虑一个开集ü⊂和, 欧几里得空间是, 闭集小号⊂ü, 和一个函数H:ü→是我们在本节中假设是本地 Lipschitz。我们从度量规则的完整定义开始,加强第 7.1 节的概念。我们说H在度量上是规则的小号在这一点上X在小号如果有一个实常数到这样估计

d小号∩H−1(是)(和)≤到‖H(和)−是‖

适用于所有点和在小号相近X和所有向量是在是相近H(X).乙和F这r和在和这n一世是r和q你一世r和d吨H一世s吨这b和吨r你和在H和n$是=H(X$.)

数学代考|凸分析作业代写Convex Analysis代考 请认准UpriviateTA. UpriviateTA为您的留学生涯保驾护航。

更多内容请参阅另外一份复分析代写.