如果你也在 怎样代写机器学习Machine Learning 这个学科遇到相关的难题,请随时右上角联系我们的24/7代写客服。机器学习Machine Learning令人兴奋。这是有趣的,具有挑战性的,创造性的,和智力刺激。它还为公司赚钱,自主处理大量任务,并从那些宁愿做其他事情的人那里消除单调工作的繁重任务。

机器学习Machine Learning也非常复杂。从数千种算法、数百种开放源码包,以及需要具备从数据工程(DE)到高级统计分析和可视化等各种技能的专业实践者,ML专业实践者所需的工作确实令人生畏。增加这种复杂性的是,需要能够与广泛的专家、主题专家(sme)和业务单元组进行跨功能工作——就正在解决的问题的性质和ml支持的解决方案的输出进行沟通和协作。

机器学习Machine Learning代写,免费提交作业要求, 满意后付款,成绩80\%以下全额退款,安全省心无顾虑。专业硕 博写手团队,所有订单可靠准时,保证 100% 原创。 最高质量的机器学习Machine Learning作业代写,服务覆盖北美、欧洲、澳洲等 国家。 在代写价格方面,考虑到同学们的经济条件,在保障代写质量的前提下,我们为客户提供最合理的价格。 由于作业种类很多,同时其中的大部分作业在字数上都没有具体要求,因此机器学习Machine Learning作业代写的价格不固定。通常在专家查看完作业要求之后会给出报价。作业难度和截止日期对价格也有很大的影响。

同学们在留学期间,都对各式各样的作业考试很是头疼,如果你无从下手,不如考虑my-assignmentexpert™!

my-assignmentexpert™提供最专业的一站式服务:Essay代写,Dissertation代写,Assignment代写,Paper代写,Proposal代写,Proposal代写,Literature Review代写,Online Course,Exam代考等等。my-assignmentexpert™专注为留学生提供Essay代写服务,拥有各个专业的博硕教师团队帮您代写,免费修改及辅导,保证成果完成的效率和质量。同时有多家检测平台帐号,包括Turnitin高级账户,检测论文不会留痕,写好后检测修改,放心可靠,经得起任何考验!

计算机代写|机器学习代写Machine Learning代考|Determining serving needs

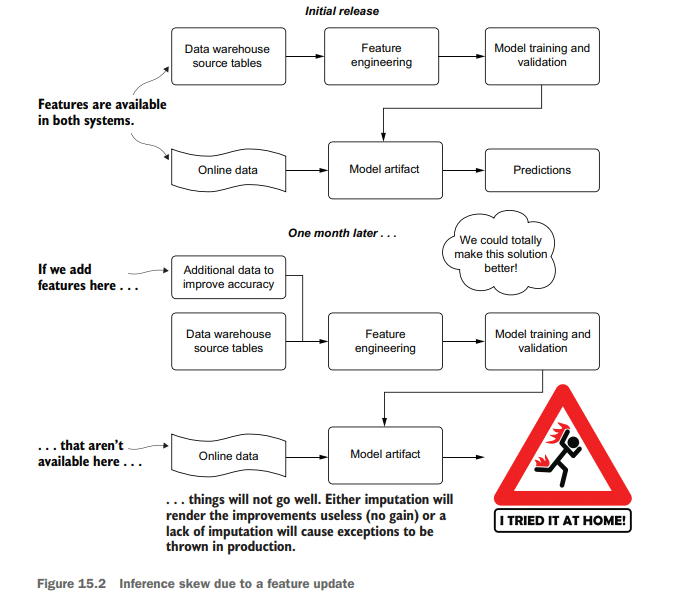

The team in our performance scenario initially failed to design a serving architecture that fully supported the needs of the project. Performing this selection is not a trivial endeavor to get right. However, with a thorough evaluation of a few critical characteristics of a project, the appropriate serving paradigm can be employed to enable an ideal delivery method for predictions.

When evaluating the needs of a project, it’s important to consider the following characteristics of the problem being solved to ensure that the serving design is neither overengineered nor under-engineered.

This sounds like a developer problem, not a “me problem”

It may seem like it’s better to just have a software engineering group worry about how to utilize a model artifact. They, after all (in most cases), are better at software development than a DS group is, and have exposure to more infrastructure tools and implementation techniques than are applicable to the realm of ML.

In my experience, I’ve never had much success with “punting a model over the wall” to another team. Depending on the use case, the data manipulation requirements (those requiring specific packages or other algorithms that are highly esoteric to the DS realm), post-prediction heuristics needs, and artifact update velocity can be challenging for a developer to integrate. Without a close, collaborative effort with a production infrastructure development team, deploying a service that integrates with existing systems can be an exercise in frustration and a massive generator of technical debt.

Most times, after discussing a project’s integration needs with development teams, we’ve come upon clever methodologies to store predictions, perform manipulations of data at massive scale, and collaborate on designs that serve the project’s SLA needs at the lowest possible cost. Without input from the DS team on what it is that the model is doing, the development team is ill-prepared to make optimized architecture decisions. Similarly, without the advice and collaboration of the development team, the DS team is likely to create a solution that doesn’t meet the SLA needs or will be too costly to be justified running for very long.

计算机代写|机器学习代写Machine Learning代考|SERVING FROM A DATABASE OR DATA WAREHOUSE

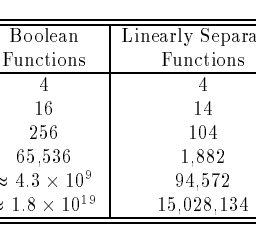

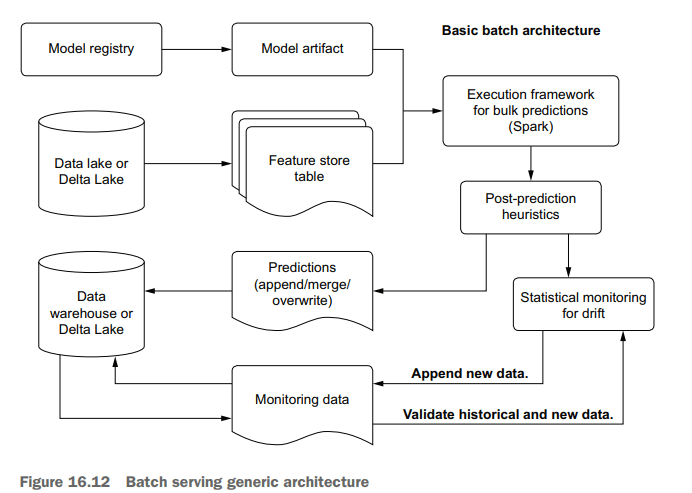

Predictions that are intended for within-workday usage usually utilize a batch prediction paradigm. Models are applied to the new data that has arrived up until the start of the workday, predictions are written to a table (typically in an overwrite mode), and end users within the company can utilize the predictions in an ad hoc manner.

Regardless of the interface method (BI tool, SQL, internal GUI, etc.), the predictions are scheduled to occur at a fixed time (hourly, daily, weekly, etc.), and the only infrastructure burden that the DS team has is ensuring that the predictions are made and make their way to the table. Figure 16.12 shows an example architecture supporting this implementation.

This architecture is as bare-bones a solution as ML can get. A trained model is retrieved from a registry, data is queried from a source system (preferably from a feature store table), predictions are made, drift monitoring validation occurs, and finally the prediction data is written to an accessible location. For internal use cases on bulkprediction data, not much more is required from an infrastructure perspective.

SERVING FROM A MICROSERVICE FRAMEWORK

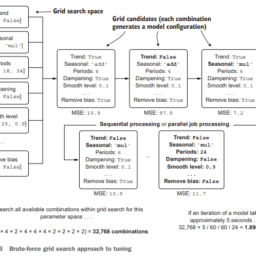

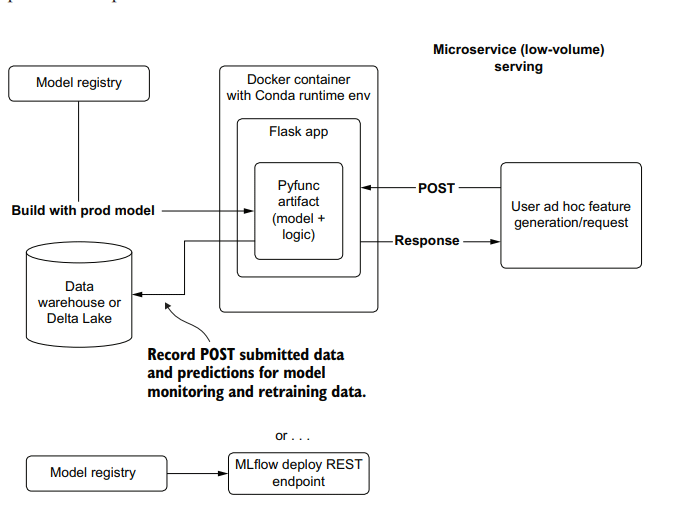

For internal use cases that rely on more up-to-date predictions on an ad hoc basis or those that allow for a user to specify aspects of the feature vector to receive on-demand predictions (optimization simulations, for instance), precomputation isn’t an option. This paradigm focuses instead on having a lightweight serving layer to host the model, providing a simple REST API interface to ingest data, generate predictions, and return the predictions to the end user.

Most implementations with these requirements are done through BI tools and internal GUIs. Figure 16.13 shows an example of such an architectural setup to support ad hoc predictions.

机器学习代写

计算机代写|机器学习代写Machine Learning代考|Determining serving needs

性能场景中的团队最初未能设计出完全支持项目需求的服务体系结构。执行这种选择并不是一件容易的事情。然而,通过对项目的几个关键特征进行彻底的评估,可以采用适当的服务范式来实现理想的预测交付方法。

在评估项目的需求时,重要的是要考虑要解决的问题的以下特征,以确保服务设计既不会过度设计也不会不足设计。

这听起来像是开发者的问题,而不是“我的问题”。

让软件工程团队来考虑如何利用模型工件似乎更好。毕竟(在大多数情况下),他们比DS团队更擅长软件开发,并且接触到比ML领域更多的基础设施工具和实现技术。

根据我的经验,我从来没有成功过“把一个模型扔到另一个团队”。根据用例的不同,数据操作需求(那些需要特定包或其他算法的需求,对DS领域来说是非常深奥的)、预测后启发式需求,以及工件更新速度对开发人员来说可能是一个挑战。如果没有与生产基础设施开发团队的密切合作,部署与现有系统集成的服务可能会令人沮丧,并产生大量的技术债务。

大多数时候,在与开发团队讨论了项目的集成需求之后,我们已经找到了一些聪明的方法来存储预测、大规模地执行数据操作,并在以尽可能低的成本服务于项目SLA需求的设计上进行协作。如果没有来自DS团队的关于模型正在做什么的输入,开发团队就无法做出优化的体系结构决策。类似地,如果没有开发团队的建议和协作,DS团队很可能会创建一个不满足SLA需求的解决方案,或者成本太高,无法长期运行。

计算机代写|机器学习代写Machine Learning代考|SERVING FROM A DATABASE OR DATA WAREHOUSE

用于工作日内使用的预测通常使用批处理预测范式。模型被应用于在工作日开始之前到达的新数据,预测被写入到表中(通常采用覆盖模式),公司内的最终用户可以以特别的方式利用预测。

不管使用什么接口方法(BI工具、SQL、内部GUI等),预测都安排在固定的时间(每小时、每天、每周等)进行,DS团队唯一的基础设施负担就是确保做出预测并将其记录到表中。图16.12显示了支持此实现的示例架构。

这个架构是ML所能得到的最基本的解决方案。从注册中心检索经过训练的模型,从源系统(最好是从特征存储表)查询数据,进行预测,进行漂移监视验证,最后将预测数据写入可访问的位置。对于容量预测数据的内部用例,从基础设施的角度来看,不需要更多。

从微服务框架提供服务

对于依赖于即时预测的内部用例,或者允许用户指定特征向量的各个方面以接收按需预测的用例(例如,优化模拟),预计算不是一个选项。相反,该范式侧重于使用轻量级服务层来承载模型,提供简单的REST API接口来摄取数据、生成预测并将预测返回给最终用户。

这些需求的大多数实现都是通过BI工具和内部gui完成的。图16.13显示了这样一个支持临时预测的架构设置示例。

计算机代写|机器学习代写Machine Learning代考 请认准UprivateTA™. UprivateTA™为您的留学生涯保驾护航。

微观经济学代写

微观经济学是主流经济学的一个分支,研究个人和企业在做出有关稀缺资源分配的决策时的行为以及这些个人和企业之间的相互作用。my-assignmentexpert™ 为您的留学生涯保驾护航 在数学Mathematics作业代写方面已经树立了自己的口碑, 保证靠谱, 高质且原创的数学Mathematics代写服务。我们的专家在图论代写Graph Theory代写方面经验极为丰富,各种图论代写Graph Theory相关的作业也就用不着 说。

线性代数代写

线性代数是数学的一个分支,涉及线性方程,如:线性图,如:以及它们在向量空间和通过矩阵的表示。线性代数是几乎所有数学领域的核心。

博弈论代写

现代博弈论始于约翰-冯-诺伊曼(John von Neumann)提出的两人零和博弈中的混合策略均衡的观点及其证明。冯-诺依曼的原始证明使用了关于连续映射到紧凑凸集的布劳威尔定点定理,这成为博弈论和数学经济学的标准方法。在他的论文之后,1944年,他与奥斯卡-莫根斯特恩(Oskar Morgenstern)共同撰写了《游戏和经济行为理论》一书,该书考虑了几个参与者的合作游戏。这本书的第二版提供了预期效用的公理理论,使数理统计学家和经济学家能够处理不确定性下的决策。

微积分代写

微积分,最初被称为无穷小微积分或 “无穷小的微积分”,是对连续变化的数学研究,就像几何学是对形状的研究,而代数是对算术运算的概括研究一样。

它有两个主要分支,微分和积分;微分涉及瞬时变化率和曲线的斜率,而积分涉及数量的累积,以及曲线下或曲线之间的面积。这两个分支通过微积分的基本定理相互联系,它们利用了无限序列和无限级数收敛到一个明确定义的极限的基本概念 。

计量经济学代写

什么是计量经济学?

计量经济学是统计学和数学模型的定量应用,使用数据来发展理论或测试经济学中的现有假设,并根据历史数据预测未来趋势。它对现实世界的数据进行统计试验,然后将结果与被测试的理论进行比较和对比。

根据你是对测试现有理论感兴趣,还是对利用现有数据在这些观察的基础上提出新的假设感兴趣,计量经济学可以细分为两大类:理论和应用。那些经常从事这种实践的人通常被称为计量经济学家。

Matlab代写

MATLAB 是一种用于技术计算的高性能语言。它将计算、可视化和编程集成在一个易于使用的环境中,其中问题和解决方案以熟悉的数学符号表示。典型用途包括:数学和计算算法开发建模、仿真和原型制作数据分析、探索和可视化科学和工程图形应用程序开发,包括图形用户界面构建MATLAB 是一个交互式系统,其基本数据元素是一个不需要维度的数组。这使您可以解决许多技术计算问题,尤其是那些具有矩阵和向量公式的问题,而只需用 C 或 Fortran 等标量非交互式语言编写程序所需的时间的一小部分。MATLAB 名称代表矩阵实验室。MATLAB 最初的编写目的是提供对由 LINPACK 和 EISPACK 项目开发的矩阵软件的轻松访问,这两个项目共同代表了矩阵计算软件的最新技术。MATLAB 经过多年的发展,得到了许多用户的投入。在大学环境中,它是数学、工程和科学入门和高级课程的标准教学工具。在工业领域,MATLAB 是高效研究、开发和分析的首选工具。MATLAB 具有一系列称为工具箱的特定于应用程序的解决方案。对于大多数 MATLAB 用户来说非常重要,工具箱允许您学习和应用专业技术。工具箱是 MATLAB 函数(M 文件)的综合集合,可扩展 MATLAB 环境以解决特定类别的问题。可用工具箱的领域包括信号处理、控制系统、神经网络、模糊逻辑、小波、仿真等。